Von Ethik zu Recht

Der AI Act und seine Bedeutung für die Gestaltung von algorithmischen Systemen

Die Debatte über ethische Aspekte bei der Anwendung und Entwicklung von algorithmischen Systemen beschäftigt schon seit einigen Jahren die Öffentlichkeit, die Politik und auch die Softwarehersteller. Zumindest die letztgenannten haben die Initiative ergriffen und selbstauferlegte ethische Richtlinien für die Entwicklung von KI-basierten Produkten publiziert, um wohl auch einer Regulierung durch den Gesetzgeber zuvorzukommen. Anknüpfend an die Veröffentlichung der ALTAI-Kriterien und der dazugehörigen Checkliste hat die Europäische Kommission jedoch am 21.04.2021 einen Gesetzesvorschlag zur Regulierung von KI-basierten Technologien zur Diskussion zwischen den Mitgliederstaaten vorgestellt. Was diese Entwicklung für die Gestaltung und Anwendung von betrieblichen Informationssystemen heißen kann, soll im Folgenden diskutiert werden.

Ein kurzer Überblick der Entstehung der Regulierung

Der erste Entwurf der künftigen Richtlinien für eine vertrauenswürdige (trustworthy) KI kam im Dezember 2018 von der Europäischen Kommission, gemeinsam mit der Ankündigung eines "Europäischen Weges der KI", der sog. "AI made in Europe". Die Kriterien für eine vertrauensvolle KI wurden von der AI HLEG (High-Level Expert Group on Artificial Intelligence) erstellt und in einem umfangreichen Feedbackprozess mit Akteuren aus der Praxis diskutiert [1]. Dabei ist anzumerken, dass der von der Europäischen Kommission verwendete Begriff der "KI" die Technologien des Maschinellen Lernens beschreibt, die auch unter dem Begriff der Algorithmischen Systeme zusammengefasst werden [2]. Die weitere zeitliche Entwicklung, die mit dem erwarteten Inkrafttreten des AI Acts endet, wird in Abb. 1 dargestellt. Der AI Act ist somit aus der Berücksichtigung der ethischen Bedenken aus der Gesellschaft angesichts der bereits eingesetzten Systeme in der betrieblichen und verwaltungstechnischen Praxis entstanden und ist auch im weiteren Kontext der Gesetzesvorschläge der EU zu digitalen Technologien wie dem Digital Markets Act zu betrachten [3].

Damit stellt diese Entwicklung ein Beispiel für den Prozess der ethische Anforderungen einer Gesellschaft in verbindliche Verhaltensnormen (Gesetze) umwandelt, dar. Die europäische KI-Verordnung – der AI Act (AIA) [4]– liegt also seit April 2021 als Gesetzesvorschlag den Mitgliedsstaaten der EU zur Diskussion vor. Er zielt auf die Regulierung von Algorithmischen Systemen ab und stellt aktuell global die erste rechtliche Regulierung dieses Maßstabs dar. Zahlreiche Diskussion werden bereits darüber geführt, die eine Verschärfung der darin vorgeschlagenen Regulierung fordern [5].

Was steht in dem Regulierungsvorschlag?

Basierend auf den bereits bestehenden Rechtsvorschriften, die die Anwendung und Entwicklung von Informationssystemen betreffen und einen gewissen Schutz bieten, geht AIA speziell auf die Eigenschaften von Algorithmischen Systemen ein. So sollen die vorgeschlagenen Regeln u. a. konkret mögliche Risiken adressieren, die speziell durch KI-Anwendungen entstehen oder entstehen können. Aber auch Anwendungen mit hohem Risiko identifizieren, Anforderungen für den Umgang mit ihnen festlegen und Verpflichtungen für das Anwenden und Anbieten von Hochrisiko-Anwendungen definieren sowie eine Governance-Struktur für algorithmische Systeme auf europäischer und nationaler Ebene vorschlagen.

Damit wird sichtbar, dass AIA ebenfalls den Risiko-Ansatz zur Einteilung und Regulierung von Algorithmischen Systemen aufgreift, den auch die deutsche Datenethikkommission vorgeschlagen hat [2]. So sollen Algorithmische Systeme, die als unakzeptabel eingestuft werden, in der EU nicht angeboten und entwickelt werden können (s. Abb. 2). Als unakzeptabel werden Systeme eingestuft, die gefährlich für Leib, Leben und Grundrechte sind oder für schädliche Manipulation, Ausnutzung von Schwachstellen, wahllose Massenüberwachung zur Strafverfolgung und Social Scoring eingesetzt werden oder werden können [4].

Wie Abb. 2 verdeutlicht, geht die Europäische Kommission davon aus, dass die Mehrheit der entwickelten und eingesetzten Algorithmischen Systeme als Systeme mit minimalem Risiko eingeschätzt werden.

KI-Systeme mit hohem Risiko sollen strengen Auflagen und Audits unterworfen werden, bevor sie auf den Markt gebracht werden können. Dazu gehören Systeme, die beim Betrieb von kritischer Infrastruktur, in der Verwaltung, bei der Bestimmung und Umsetzung von Sicherheitsaspekten von Produkten und Infrastrukturen sowie im Bereich der Rechtsprechung eingesetzt werden sollen.

Algorithmische Systeme, die als Systeme mit einem begrenzten Risiko eingestuft werden, werden bestimmten Transparenzpflichten unterliegen: So sollte es bei der Nutzung von KI-Systemen wie z. B. Chatbots dem Nutzenden verdeutlicht werden, dass er oder sie mit einer Maschine interagiert, damit eine informierte Entscheidung über das Fortfahren oder Zurücktreten aus dem Prozess getroffen werden kann [6].

Algorithmische Systeme, die als Systeme mit minimalen Risiko eingestuft werden, sollen keinen Überprüfungsanforderungen unterworfen werden. Der Vorschlag sieht eine freie Nutzung von Anwendungen wie z. B. KI-fähigen Videospielen oder Spamfiltern vor.

Der Regulierungsvorschlag zielt also darauf ab, Personen und Institutionen, die Algorithmische Systeme entwickeln, betreiben und anwenden sowie über ihre konkrete Anwendung entscheiden, klare Anforderungen und Verpflichtungen in Bezug auf bestimmte KI-Anwendungen zur Verfügung zu stellen. Gleichzeitig verfolgt der Vorschlag auch das Ziel, den administrativen und finanziellen Aufwand für Unternehmen, insbesondere für kleine und mittlere Unternehmen, zu verringern, um so sichere und innovative algorithmische Systeme gestalten und betreiben zu können [4].

Was bedeutet es für Einsatz und Entwicklung von algorithmischen Systemen?

Anzumerken ist, dass Algorithmische Systeme auch vor dem Regulierungsvorschlag nicht in einem gesetzesfreien Raum entwickelt wurden. Sie unterliegen wie auch andere Softwareprodukte den entsprechenden gesetzlichen Bestimmungen. Wurden die betrieblichen Informationssysteme jedoch für die Anwendung innerhalb eines Geschäftsprozesses konzipiert, betreffen die Ergebnisse der Anwendung von algorithmischen Systemen nun potentiell auch Beteiligte außerhalb des betrieblichen Kontextes. Dazu kommt, dass bei der Entwicklung von betrieblicher Software die Ressourcen- und Funktionsvorgaben die wichtigste Rolle bei der Auswahl der Gestaltungsalternativen gespielt haben. Der AIA bringt weitere Aspekte wie Folgenabschätzung des Technologieeinsatzes und den Fokus auf die nutzenden und betroffenen Akteure mit, die nicht nur auf die Gestaltung von Algorithmischen Systemen übertragen werden können. Der Ansatz, der dem AIA zu Grunde liegt, ist somit in dem Prinzip verwurzelt, dass es die Pflicht eines jeden Ingenieurs bzw. jeder Ingenieurin ist, sich mit den Folgen der getroffenen Entscheidungen in Bezug auf die Gestaltung des finalen Konstrukts auseinanderzusetzen [7].

Die Frage, die für viele Unternehmen nun wesentlich geworden ist, ist natürlich, ob durch das Inkrafttreten des AIA die europäischen Unternehmen im Nachteil auf dem globalen Markt sein werden. Doch das AIA soll einen fairen Wettbewerb ermöglichen. Laut Paul Nemitz, dem Hauptberater für Justizpolitik der Europäischen Kommission, werden EU-Firmen "nicht benachteiligt, weil diese Regeln für jede KI gelten, die auf unseren Markt kommt [...] es wird gleiche Wettbewerbsbedingungen geben. Es spielt keine Rolle, ob die KI von außerhalb oder innerhalb der [EU] kommt" [8].

Wie sollen nun die Algorithmischen Systemen aussehen, die den AIA-Kriterien entsprechen?

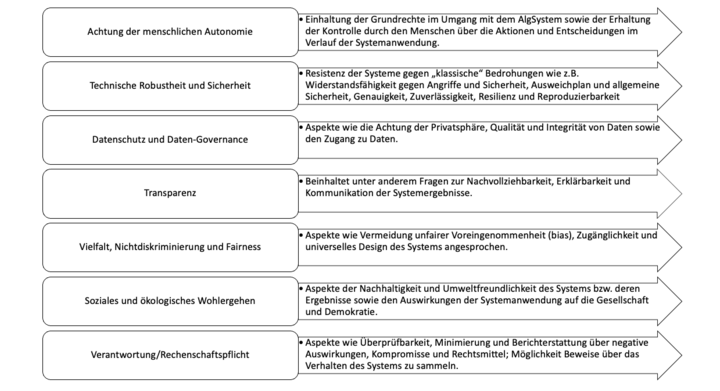

Der AIA basiert auf den ethischen Richtlinien für eine vertrauensvolle KI, die von der HLEG 2019 vorgeschlagen und 2020 in einer operativen Checkliste, (Assessment List for Trustworthy AI (ALTAI), konkretisiert wurden. Dabei spielen die sieben ethischen Hauptprinzipien für die Beurteilung und Einstufung von algorithmischen Systemen eine wesentliche Rolle. Diese sind in Abb. 3 zusammengefasst.

Diese Prinzipien dienten als Grundlage für die Risikobewertung von algorithmischen Systemen. Ausschlaggebend für ihren Einsatz sind u. a. das Anwendungsgebiet der Systeme sowie die zu Grunde liegenden Daten. Allerdings wurde das 5. Prinzip – Vielfalt, Nichtdiskriminierung und Fairness – nicht explizit im AIA-Vorschlag berücksichtigt [9].

Wie lassen sich diese Kriterien konkret(er) in der Systementwicklung umsetzen?

Die obengenannten Prinzipien und Anforderungen fassen zwar die erwarteten Eigenschaften eines algorithmischen Systems zusammen, beinhalten jedoch wenig Ansatzpunkte darüber, wie diese im Laufe der Entwicklung eines solchen Systems umgesetzt werden können. Eine Möglichkeit, ihre Umsetzung zu konkretisieren, ist es, den Datenverarbeitungsprozess explizit in der Anforderungsanalyse zu berücksichtigen und seine einzelnen Phasen auf potentielle ethische Fragestellungen zu überprüfen. Wird die Phase der "Anwendung", die ursprünglich nicht explizit zur Datenverarbeitung gehört, mit in die Betrachtung einbezogen, kann auch der Aspekt der Auswirkungen der Anwendung auf die externe Umwelt des algorithmischen Systems berücksichtigt werden. Hilfreich ist dabei die Betrachtung des algorithmischen Systems im Kontext des betroffenen Geschäftsprozesses.

Ein weiteres Hilfsinstrument zur Ermittlung von potentiellen ethischen Aspekten während der Auswahl, Anwendung oder Entwicklung von Informationssystemen stellen Leitfragen oder Checklisten dar. So stellt die Europäische Kommission die ALTAI- Leitfragen auch als ein Online-Tool zu Verfügung. Dieses kann bei der Beschaffung einer Software, ihrer Auditierung oder während der Testphase der Softwareentwicklung zu Rate gezogen werden [10].

Dieses Vorgehen unterstützt den Ansatz, die Softwareentwicklung sozialverträglich und nachhaltig zu gestalten, indem es die potentiellen gesellschaftlichen Fragen, die bei der Anwendung entstehen können, bereits entlang des Entwicklungsprozesses strukturiert, um sie operativ in die Software integrieren zu können [11].

Als mögliches Beispiel stellt Abb. 4 den Datenverarbeitungsprozess und einen Ausschnitt der möglichen ethischen Aspekte, die in jeder Phase berücksichtigt werden müssen, im Kontext von medizinischen algorithmischen Systemen dar. Während es sich hier um eine verkürzte Darstellung handelt, zeigt sich aber bereits, dass Daten, ihr Ursprung, Quantität und Qualität, etc. für Fragestellungen innerhalb der angesprochenen ethischen Aspekte eine Rolle spielen können. Im Bereich der personengebundenen Daten bietet die DSGVO bereits einen rechtlichen Rahmen. Bei Maschinendaten hingegen liegt es bislang im Ermessen der Systemgestaltenden und -anwendenden, diese in die Trainingsdaten bzw. als Modellgrundlage einzubeziehen sowie den Ursprung und die Zusammensetzung der Daten für die Stakeholder zugänglich zu machen.

Die Darstellung der Informationen bezüglich der Herkunft der Daten, ihrer Zusammensetzung und Kategorisierung, der verwendeten Modelle des maschinellen Lernens sowie bezüglich der Optimierungsvariablen und -grenzen stellen ein Grundniveau an Transparenz dar, das den Anwendenden des Systems eine gewisse Sicherheit über die betriebswirtschaftliche Eignung des Systems gibt und die Entwickelnden bereits während des Prozesses der Softwaregestaltung in Bezug auf diese Aspekte sensibilisiert.

Als Ergebnis entsteht eine Produktbeschreibung, die häufig als "Beipackzettel" für die Software bezeichnet wird, jedoch das Potential hat, das finale Produkt mehr an das anvisierte betriebliche Problem sowie an die Nutzenden anzupassen [13]. Eine geschäftsprozessfokussierte Gestaltung des algorithmischen Systems erlaubt es, die Informationen, die hier für eine Entscheidungsfindung wesentlich sind, zur Verfügung zu stellen und zu berücksichtigen. Wichtige Leitfragen können dabei sein:

- Welche Prozessschritte soll das algorithmische System ersetzen bzw. vervollständigen?

- Wer wendet es in der Organisationseinheit an?

- An welchen Prozessschritt/Organisationseinheit/Stakeholder wird das Ergebnis des algorithmischen Systems weitergeleitet?

- Ist das Ergebnis für den Empfänger verständlich und operationalisierbar formuliert?

- Welche Form der Mensch-Maschine-Interaktion ist hier vorgesehen? Ist diese aus der Sicht der anwendenden und der betroffenen Stakeholder ausreichend?

Die prozessorientierte Betrachtung der Integration von algorithmischen Systemen macht deutlich, dass ihr Erfolg stark von dem jeweiligen Einsatzkontext und den einsetzenden Personen bzw. Stakeholdern bestimmt wird. Die sich hieraus ergebenden Anforderungen sind für die Gestaltung von betrieblichen Softwaresystemen nicht neu. Im Kontext der algorithmischen Systeme treten diese jedoch verstärkt in den Vordergrund. Diese Erkenntnis liegt auch dem AIA zu Grunde und soll also die Unternehmen, die Algorithmischen Systeme entwickeln und anwenden, dazu bewegen, sich neben den klassischen Anforderungen auf die wirtschaftlich-sozialen Aspekte der IT-Produkte zu fokussieren.

- Europäische Kommission: Pilot the Assessment List of the Ethics Guidelines for Trustworthy AI

- Datenethikkommission, 2018: Gutachten der Datenethikkommission

- Europäische Kommission: Digital Markets Act

- Europäische Kommission: Regulatory framework proposal on Artificial Intelligence

- Algorithmwatch: Entwurf der EU-Kommission für eine KI-Verordnung: Die EU muss ihren eigenen Ansprüchen in Bezug auf Governance und Durchsetzung gerecht werden

- Informatik Aktuell – Dr. Saskia Dörr: Wertekodex für Chatbots

- Wade L. Robison: Ethics Within Engineering: An Introduction

- aitrends: Executive Interview: Paul Nemitz, Principal Adviser on Justice Policy for the European Commission, Brussels

- ALLAI: EU’s AI Regulation: Europe puts Fundamental Rights and Values Front and Center

- Altai: The Assessment List for Trustworthy Artificial Intelligence

- G. Baxter and I. Sommerville: Socio-technical systems: From design methods to systems engineering, Interact. Comput., vol. 23, no. 1, pp. 4–17, 2011, doi: 10.1016/j.intcom.2010.07.003

- O. Levina: KI und Ethik in der Medizinforschung. KI-basierte Forschung in der Medizin und ihre ethischen Herausforderungen, gesundhyte.de, pp. 8–10, 2020.

- A. Coravos, I. Chen, A. Gordhandas, and A. D. Stern: We should treat algorithms like prescription drugs, Quartz, pp. 1–8, Apr. 2019, Accessed: Jan. 08, 2020

![Abb. 4: Datenverarbeitungsprozess (links) und ethische Fragen in der Datenverarbeitung (rechts) Quelle: Levina 2020 [12] Abb. 4: Datenverarbeitungsprozess (links) und ethische Fragen in der Datenverarbeitung (rechts) Quelle: Levina 2020 [12]](/fileadmin/_processed_/6/5/csm_abb4_levina_ai_8f98a881f4.png)