Wie Unternehmen KI-Datenmanagementprojekte erfolgreich durchführen

Künstliche Intelligenz gilt immer noch als eine der zukunftsweisenden Technologien, die viele Bereiche wie etwa Medizin, Handel, Verkehr und öffentliche Verwaltung revolutioniert. So scheint es nicht verwunderlich, dass bereits knapp jedes fünfte Unternehmen in Deutschland zurzeit KI-Systeme implementiert oder zumindest ihren Einsatz plant. Besonders hoch im Kurs stehen KI-Projekte, um Daten zu analysieren. Ganze 70 Prozent der Unternehmen sehen hier das größte Potenzial, so die Ergebnisse einer Umfrage von PWC [1]. Dennoch lauern einige Stolpersteine, wollen Unternehmen intelligente Datenprojekte umsetzen. Welche Hürden auftauchen können und wie sich diese meistern lassen, erläutert dieser Artikel anhand eines KI-Projektes zur Analyse von Geschäftspartnerdaten [2].

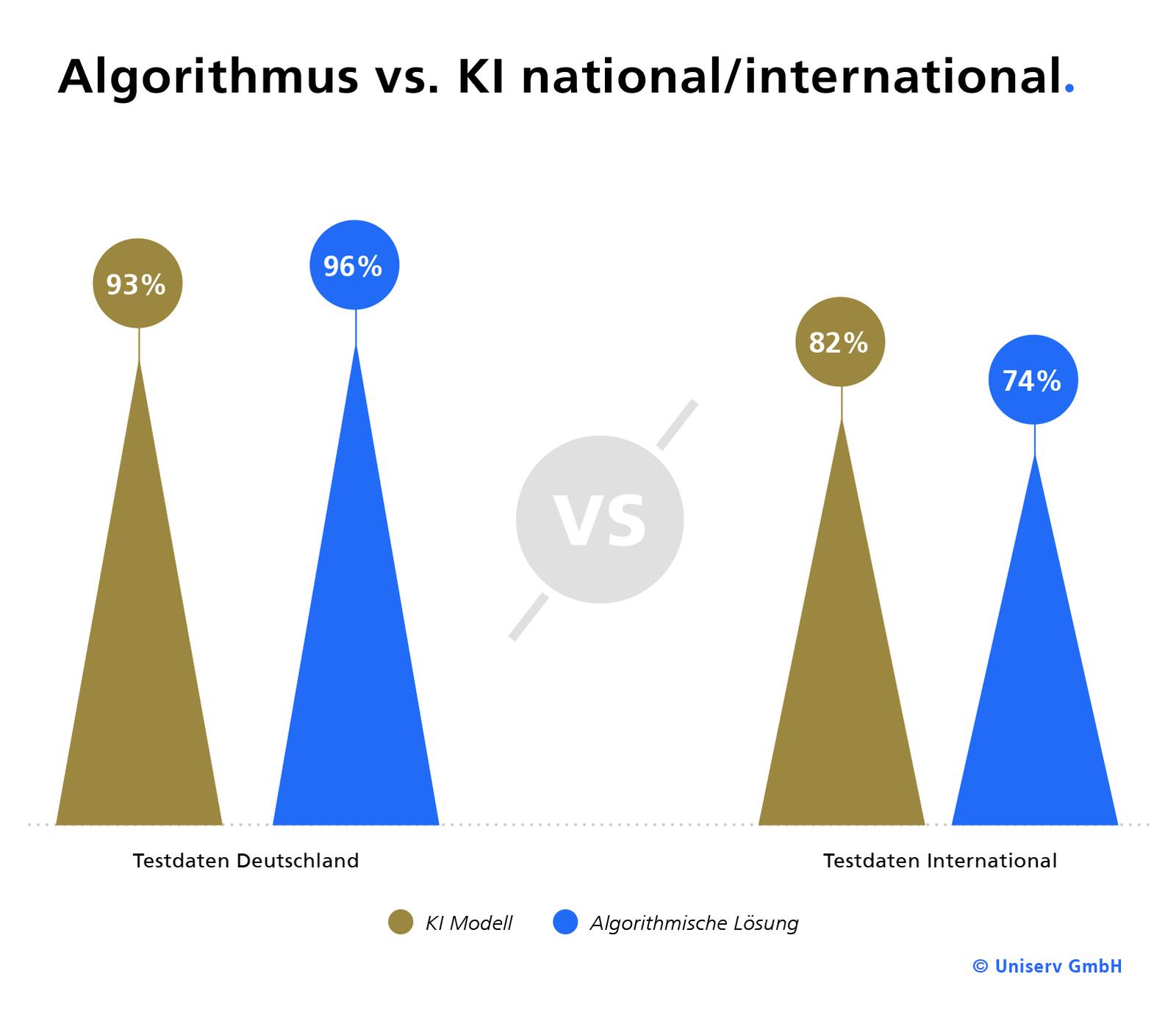

Im Rahmen eines gemeinsamen Projektes sollte die eingesetzte KI lernen, aus einem großen Pool von Geschäftspartnerdaten (Kunden, Lieferanten, Dienstleister etc.) die jeweiligen Unternehmensdaten selbsttätig von personenbezogenen Daten zu unterscheiden. Diese Aufgabenstellung kann alternativ auch über einen Softwarealgorithmus gelöst werden, der die Geschäftspartnerdaten analysiert und unter anderem gegen Vornamenlisten abgleicht, um so die personenbezogenen Informationen zu filtern. Jedoch kann dieses Vorgehen konfigurationsintensiv und zeitaufwändig sein, weil beispielsweise die nötigen Regeln manuell erstellt werden müssen – ein Prozess, der viel Spezialwissen erfordert. Zudem muss der Algorithmus jeweils angepasst werden, um etwa auch Geschäftspartnerdaten aus anderen Ländern abgleichen und unterscheiden zu können. Das lohnt sich häufig nur bei einem signifikanten Datenvolumen.

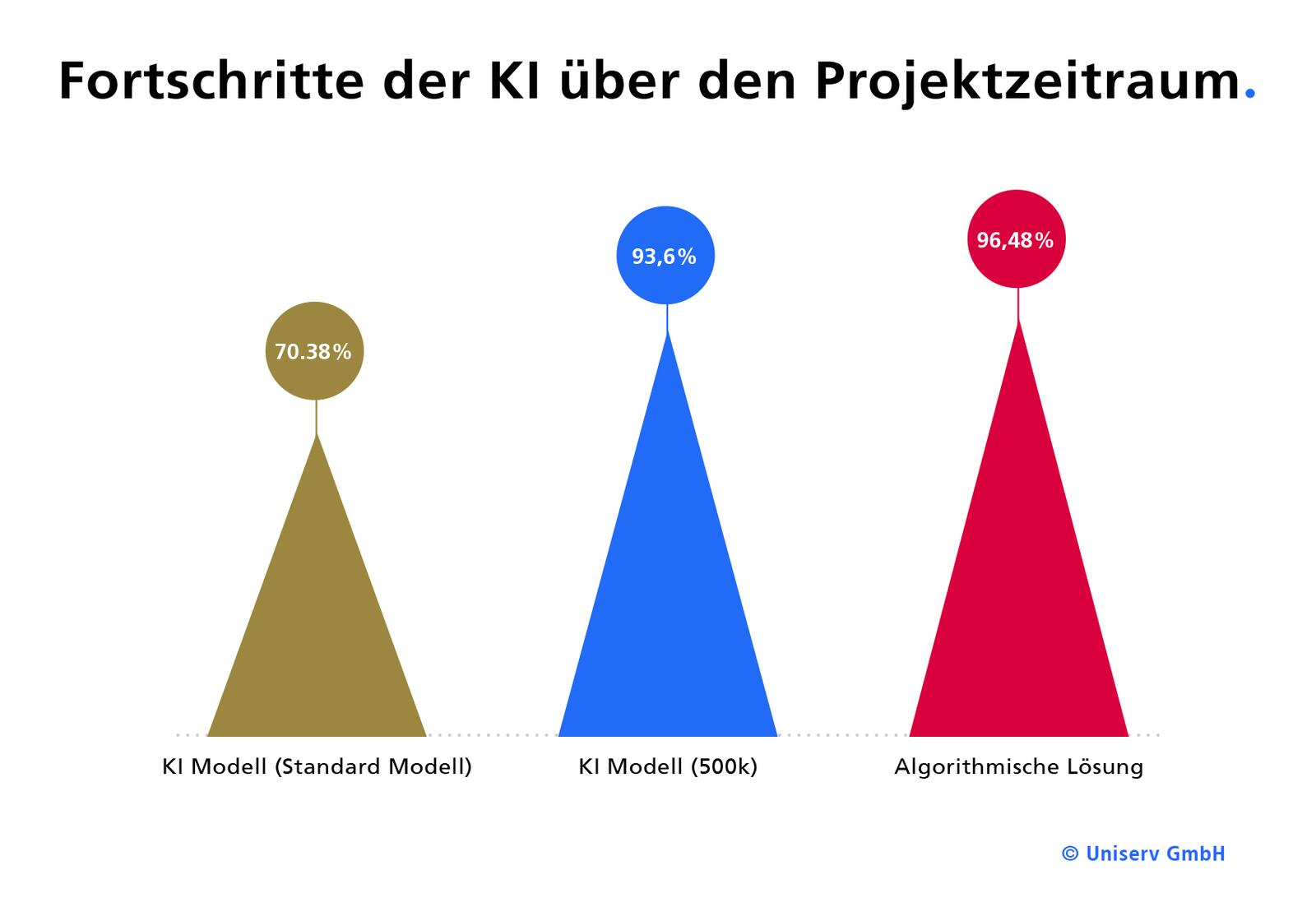

Im Projekt selbst sollte nun explorativ herausgefunden werden, ob die Einordnung der Geschäftspartnerdaten, also die Klassifikation von Geschäfts- versus Privatperson, über eine KI effizienter gelöst werden kann. Der Projektrahmen wurde daher zunächst auf den deutschsprachigen Raum eingeschränkt, um dann auf Grundlage der Ergebnisse Funktionsweisen für weitere Länder ableiten zu können. Die Ergebnisse wurden gegen die algorithmische Lösung verglichen, um genau zu erfahren, ob und wieviel effizienter eine KI arbeitet.

Man trainierte und testete während der vergangenen zwölf Monate über 50 verschiedene Machine-Learning-Modelle und verglich die jeweiligen Ergebnisse und Zuverlässigkeitswerte miteinander. Die Schwierigkeit für die KI lag in der Projektphase vor allem darin, dass sie lernen musste, dass Unternehmensnamen teilweise ebenso aus Namen von Privatpersonen bestehen können, wie dies etwa oft bei einer GbR oder einem Einzelunternehmen – zum Beispiel bei "Malermeisterin Eva Meier" – der Fall ist.

Im Rahmen des Projekts kamen unter anderem das Tool biome.webspace und das Open-Source-Tool biome.text zum Einsatz [3]. Beide Tools helfen dabei, unstrukturierte Daten zu verwalten sowie KI-Modelle zu erstellen, zu trainieren und zu testen.

Die untersuchte Fragestellung, wie zuverlässig eine KI in der Lage ist, Unternehmensdaten von personenbezogenen Daten selbständig zu unterscheiden, ist vor allem für Organisationen mit umfangreichen Datenbeständen relevant. So ist es zum Beispiel für Unternehmen aus den Branchen E-Commerce, Handel, Banken und Versicherungen, Energie und Messen wichtig, Geschäftspartnerdaten automatisiert verwalten und richtig kategorisieren zu können, etwa um personenbezogene Daten gemäß der DSGVO entsprechend zu schützen oder Compliance-Richtlinien einzuhalten. Ein weiterer Einsatzbereich ist die automatisierte, individuelle Ansprache im Marketing und um Marketing-Automation-Prozesse zu verbessern.

Aus den gesammelten Projekterfahrungen sind hinsichtlich des Einsatzes von KI und entsprechender Projektplanung und -architektur Lerneffekte entstanden, wie sich größere Hürden überwinden lassen, bevor sie entstehen. Ihre Betrachtung und Berücksichtigung kann Verantwortlichen in den Unternehmen helfen, Projekte mit KI-Bezug zielführend aufzusetzen, um schneller und damit auch kostengünstiger zum Erfolg zu kommen. Daten und ihrer Beschaffenheit kommt dabei eine besondere Rolle zu.

Das richtige Modell abhängig von der Problemstellung finden

Zu Beginn eines KI-Projekts sollten die Projektverantwortlichen zunächst die genaue Zielsetzung klären. In Abhängigkeit davon, was ein Unternehmen durch den Einsatz der KI erreichen will, wird dann nach dem passenden Modelltyp gesucht. Innerhalb des Modelltyps ist es dann in der Regel nötig, mit verschiedenen Modellen – auch Modellinstanzen genannt – zu experimentieren. Auf diese Weise soll herausgefunden werden, welches Modell die Problemstellung am besten lösen kann. Das Modell lässt sich trainieren und damit verfeinern und bildet somit den technischen Kern eines jeden KI-Systems.

Grundsätzlich können Unternehmen KI-Modelle selbst erstellen oder bereits bestehende Systeme nutzen. Abhängig von der Problemstellung kann es auch empfehlenswert sein, so wie in unserem Fall mit verschiedenen Modellen zu experimentieren, um zu testen, wie sich Vorhersage und Genauigkeit eines jeweiligen Systems verhalten. Gleichzeitig gibt es verschiedene Einflussfaktoren – wie etwa die jeweilige Konfiguration, die Menge und Verteilung der Trainings- und Testdaten oder wie oft ein Modell trainiert wird (Epochen) – die zu beachten sind. Projektverantwortliche sollten daher schon in dieser Phase entsprechend Zeit und Ausdauer einplanen, um Effekte und Ergebnisse zu beobachten. Daraus lassen sich anschließend wiederum Rückschlüsse ziehen, welche Instanz eines Modelltyps am besten zur vorab definierten Fragestellung passt.

Daten bilden die Grundlage eines jeden KI-Projekts

Um ein KI-Projekt erfolgreich umzusetzen, kommt es neben der Modellauswahl vor allem auf die zugrunde liegenden Daten an. Sie bilden das Fundament des Projekts, denn anhand der Daten lernt eine KI, was sie später tun soll. Dieser Relevanz sind sich Unternehmen laut der eingangs erwähnten PWC-Umfrage auch durchaus bewusst. Doch genau das stellt sie vor große Herausforderungen. Laut einer IBM-Umfrage haben Unternehmen in KI-Projekten mit zunehmender Datenkomplexität und mit Datensilos (30 Prozent) zu kämpfen [4]. Neben der fehlenden Expertise (33 Prozent) und Unsicherheit, welche Tools einzusetzen sind (24 Prozent), bildet die Datenproblematik oft die größte Hürde für KI-Projekte.

1. Quellen – Woher bekommen wir die Daten für die KI?

Um das KI-System anzulernen und zu testen, sind Daten also erfolgskritisch. Daher sollten sich Projektverantwortliche bei der Auswahl der Test- und Trainingsdaten grundsätzlich zwei Fragen stellen: Auf welche Daten(-Quellen) kann ich bereits zurückgreifen, um meine Problemstellung zu beantworten, und welche Daten benötige ich eventuell noch zusätzlich?

Ist es nicht möglich, auf bereits im Unternehmen vorhandene Daten zurückzugreifen, gilt es, die benötigten Daten neu zu sammeln, einen entsprechenden Zeitrahmen dafür einzuplanen oder Daten – soweit möglich – über externe Quellen zu beziehen. Arbeiten Unternehmen zum Beispiel für das KI-Projekt mit Kooperationspartnern zusammen, gibt es eventuell auch die Möglichkeit, dass diese die benötigten Daten zur Verfügung stellen. Andernfalls können auch Open-Source-Quellen in Frage kommen oder Daten, die Unternehmen über sogenannte Datenmarktplätze erwerben können. Bei alledem sind natürlich datenschutzrechtliche Aspekte zu berücksichtigen.

Kommen die genannten Quellen nicht in Frage, gibt es noch andere Möglichkeiten. Eine Option: solche Modelle auswählen, die auch mit wenig Daten trainiert werden können und die dennoch gute Ergebnisse liefern. In diesem Fall kann es aber durchaus sinnvoll sein, Spezialisten wie Data Scientists hinzuzuziehen, die über entsprechendes Wissen zu Modellen, Einflussfaktoren und Trainingsparametern verfügen. Eine weitere Option ist das Nutzen synthetischer, sprich generierter Daten.

2. Reale vs. generierte Daten: rechtliche Aspekte beachten

Ist es für das Projekt erforderlich, dass das KI-System mit echten, personenbezogenen Daten trainiert und getestet wird, müssen die Test- und Trainingsdaten anonymisiert und pseudonymisiert werden. In diesem Fall sollten Projektverantwortliche aber genau prüfen, ob solche veränderten Test- und Trainingsdaten zum Anlernen der KI noch ausreichend und aussagekräftig genug sind. Planen Projektverantwortliche ein KI-Projekt, bei dem eine Anonymisierung und Pseudonymisierung nicht möglich ist, können Daten auch neu gesammelt und im gleichen Zuge gemäß der EU-DSGVO die Erlaubnis der jeweiligen Person eingeholt werden. Dies gilt vor allem, wenn Unternehmen mit externen Projektpartnern zusammenarbeiten oder Daten in die Cloud verschoben werden sollen.

Oft kann es für das Anlernen und Testen einer KI auch ausreichen, wenn Unternehmen auf generierte, also synthetische Daten zurückgreifen. Dabei sollten sie jedoch sicherstellen, dass die Daten entsprechend der Fragestellung korrekt verteilt sind und somit einen repräsentativen Querschnitt der im Realbetrieb zu erwartenden Daten abbilden. Prinzipiell macht es schon einen Unterschied für die KI, ob sie mit echten oder generierten Daten trainiert wird. Wenn die KI etwa mit generierten Daten trainiert wurde, ist bei der späteren Anwendung mit Echtdaten eine genaue Überprüfung und Überwachung nötig. Es besteht das Risiko, dass ein intelligentes System auch aus den Mustern lernt, nach welchen die unechten Daten generiert wurden. Im Zweifelsfall sollten Projektverantwortliche deshalb genau prüfen, auf welche Weise die synthetischen Trainings- und Testdaten erstellt wurden, um negative Lerneffekte bei der KI zu vermeiden.

3. Hochqualitative Test- und Trainingsdaten sicherstellen

Ganz unabhängig davon, ob synthetische oder reale Daten – die Daten, die der KI zum Lernen zur Verfügung gestellt werden, müssen immer von hoher Qualität sein. Ansonsten lernt das intelligente System gemäß des Prinzips "Garbage-In/Garbage-Out" falsch und liefert am Ende unzuverlässige oder nicht nachvollziehbare Ergebnisse. Je korrekter eine Datenbasis ist, umso besser wird eine KI daraus später ihre Schlüsse ziehen können.

Hohe Datenqualität bedeutet in diesem Fall: korrekt, vollständig und widerspruchsfrei. Setzen Unternehmen eigene Datensätze im KI-Projekt ein, sollten sie diese vorab prüfen, aufbereiten und qualitätssichern. Handelt es sich um Geschäftspartnerdaten, muss unter anderem festgestellt werden, ob die Datensätze hinreichend ausgefüllt sind. Weitere potenzielle Fehlerquellen können in diesem Fall etwa sein:

- Nullwerte

- Ausreißer

- Dubletten

- Falsche Schreibweisen

- Mehrere Sprachen

- Falsche Bezeichner

- Semantische Probleme

Eine Untersuchung von data iku hat ergeben, dass über 40 Prozent der befragten Unternehmen die Bereinigung von Datenbeständen für den schwierigsten und zeitaufwändigsten Teil in einem KI-Projekt halten [5]. Um Daten entsprechend zu prüfen oder ihre Qualität zu verbessern, lassen sich jedoch am Markt verfügbare Datenqualitäts-Tools einsetzen. Ein weiterer wichtiger Aspekt der Qualitätssicherung, der von Projektverantwortlichen nicht unterschätzt werden sollte: Unternehmen müssen der KI beziehungsweise ihrem Ergebnis ab einem bestimmten Zeitpunkt im Projekt vertrauen. Dies fällt leichter, wenn sie sich sicher sind, dass die KI Entscheidungen auf Grundlage der richtigen Datenbasis und einer angemessenen Qualität trifft.

4. Labeling: Daten müssen korrekt gekennzeichnet sein

Eine Frage, die im Rahmen der Planung von KI-Projekten ebenfalls geklärt werden muss, ist die nach dem "Labeling" der Datensätze. Darunter versteht man die Kennzeichnung, was der Datensatz überhaupt darstellt oder beinhaltet, damit die KI lernen kann. Nicht jedes KI-Modell benötigt zwingend ein Labeling, so etwa solche im "Unsupervised-Learning-Verfahren", die für Clustering- und Segmentierungsaufgaben zum Einsatz kommen. Bei vielen anderen Modellen wiederum ist ein korrektes Labeling unabdingbar. So auch das "Supervised-Learning-Verfahren" zur Klassifizierung von Daten, das bei unserem Projekt zum Einsatz kam.

Dabei musste sichergestellt sein, dass im Projekt jeder Datensatz auch die Information enthielt, ob es sich um eine Person oder um ein Unternehmen handelte. Die ideale Ausgangssituation wären vollständige und korrekt gelabelte Test- und Trainingsdaten. Ein nachträgliches, manuelles Labeling kann abhängig von der Datenmenge und Korrektheit der Kennzeichnung zu aufwändig sein.

Einsatz synthetischer Daten prüfen

Stehen Unternehmen vor der Herausforderung, dass sie entweder auf keine korrekt gelabelten oder nicht auf ausreichende Mengen von Trainings- und Testdaten zurückgreifen können, kann auch ein Datengenerator Abhilfe schaffen. Im Beispielprojekt hat Uniserv ein selbstgeschriebenes Softwaretool eingesetzt, das Datensätze in verschiedenen Kombinationen aus Vornamen, Nachnamen und Firmennamen generierte. In diesem Fall ist jedoch zu beachten, dass die Verteilung und Struktur der generierten, also synthetischen, Datensätze immer gemäß der Fragestellung repräsentativ sein sollte.

Overfitting vermeiden: Die richtige Menge und Verteilung der Trainingsdaten

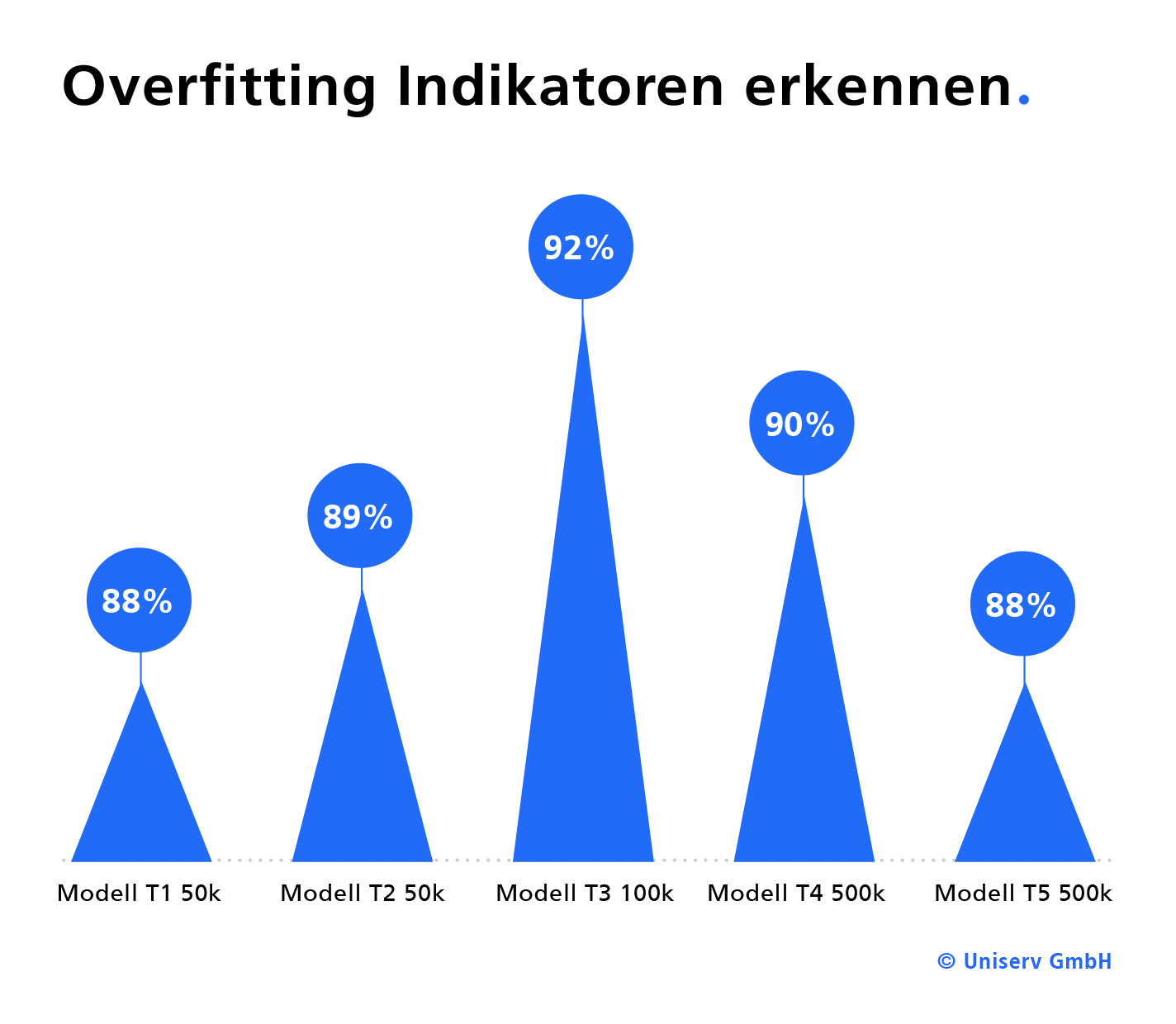

Um eine KI richtig anzulernen, muss neben der Qualität auch die Menge der Trainings- und Testdaten ausreichend sein. In unserem Projekt erkannte die KI zum Beispiel die Datensätze mit der Bezeichnung "GmbH" nicht als Unternehmensdatensätze. Die Fehlersuche ergab, dass trotz der großen Trainingsdatenmenge zu wenige Datensätze mit der Unternehmensbezeichnung "GmbH" enthalten waren. Es wäre jedoch ein Trugschluss zu glauben, dass das System umso besser lernt, je mehr Daten es zur Verfügung gestellt bekommt. Gerade bei sehr großen Datenmengen kann das Problem der Überanpassung – des sogenannten Overfittings – auftreten. In diesem Sinne kann eine KI einmal Gelerntes wieder "verlernen". Beim Overfitting kann es zum Beispiel sein, dass eine KI keine Lerninformationen aus den Trainingsdaten ziehen kann oder sie "falsches" Wissen aufbaut. Overfitting kann auch vorkommen, wenn das System zu oft mit vorhandenen Daten trainiert wurde (Anzahl der Epochen). Projektverantwortliche erkennen eine Überanpassung oft, wenn die KI zwar zuverlässig Trainingsdaten (kleinerer Datensatz) beurteilt, beim Testdatendurchlauf (größerer Datensatz) jedoch keine zuverlässigen Ergebnisse mehr liefert.

Unternehmen sollten also unbedingt darauf achten, dass die Menge an Referenzen in den Trainings- und Testdaten ausreicht, damit die KI korrekt lernt. Die Verteilung – der repräsentative Querschnitt der Daten – muss somit stimmen und die Realität der jeweiligen Fragestellung abbilden. Besteht das Problem weiterhin, kann es zum einem helfen, die Menge der Trainingsdaten und ihre Verteilung zu variieren – oder die Anzahl der Epochen zu prüfen, um auszuschließen, dass die KI nicht zu oft nachtrainiert wurde. Grundsätzlich kann auch das Modell nachjustiert werden, was aber meist einen höheren Aufwand bedeutet. Zwar gibt es auch Modelle, die vergleichsweise wenig Daten zum Lernen benötigen, dafür aber rechenintensiv sind, also mehr Rechenkapazität und Zeit brauchen, um Ergebnisse zu liefern.

Test- und Trainingsumgebung: Public vs. Private Cloud

In den meisten Fällen gestalten sich KI-Projekte sehr rechenintensiv, sodass die Frage auftaucht, ob das KI-Projekt im eigenen Rechenzentrum oder in der Cloud gehostet werden soll. Die Vorteile einer Public Cloud liegen unter anderem darin, dass Projektverantwortliche externe Experten mitunter schneller hinzuziehen können. Dennoch ist in Deutschland die öffentliche Wahrnehmung von Public Clouds oft noch negativ behaftet. Handelt es sich um Maschinen- oder Sensordaten, wird der Einsatz einer Public Cloud als weniger kritisch empfunden. Wird im KI-Projekt aber mit personenbezogenen Daten gearbeitet, entscheiden sich viele Unternehmen lieber für eine Private Cloud. Laut einer Studie von IDC bevorzugen 43 Prozent der befragten Firmen in Deutschland die Private Cloud im hauseigenen Rechenzentrum, um ihre KI-Plattform zu betreiben – unter anderem aufgrund der Datensicherheit [6]. Projektverantwortliche sollten sich daher nicht nur mit den organisatorischen und rechtlichen Vor- und Nachteilen verschiedener Cloud-Modelle auseinandersetzen, sondern auch mit deren jeweiligem Image. So liegt der Vorteil der Public Cloud in der schnelleren Skalierung der Rechenleistung, wohingegen die Sicherheit der Daten durchaus bei beiden Varianten gewährleistet sein muss.

Interpretation der Ergebnisse und Zuverlässigkeit definieren

Während der verschiedenen Trainings- und Testphasen gilt es, die Ergebnisse der KI zu interpretieren und zu bewerten – vor allem, ob die KI auf der richtigen Basis gelernt hat. Zur besseren Veranschaulichung sei hier das Beispiel bei der Erkennung von Wildtierbildern angeführt. Wenn eine KI darauf trainiert wird, Tiere auf Bildern zu erkennen, lernt sie natürlich anhand diverser Beispielbilder. Da diese Tiere oft vor einem grünen Hintergrund, also Wald und Wiesen, abgebildet werden, kann es sein, dass die KI irrtümlich lernt, den grünen Hintergrund zu erkennen und zwingend mit Tieren zu verknüpfen. Sie hat gelernt, dass die Tiere immer vor dem Grünen stehen und speichert das – den Hintergrund beziehungsweise die Farbe – als starkes Merkmal ab. Die KI identifiziert somit gar nicht das eigentliche Tier und kann es nicht als solches erkennen, wenn es nicht vor einem grünen Hintergrund steht. Auf diese Weise wurde die KI falsch trainiert, denn das Gelernte ist nicht das Richtige.

Gleichzeitig sollten Projektverantwortliche prüfen, ob Indizien für das angesprochene Overfitting vorliegen. Dieser Prozess kann sich mitunter schwieriger und zeitintensiver gestalten, vor allem, wenn es um die Suche nach Fehlern und mögliche Anpassung geht. Daher sollte immer genug Zeit eingeplant werden, um zu überprüfen und nachzuvollziehen, ob das Ergebnis auf der Grundlage der richtigen Entscheidung entstanden ist. In dieser Phase kann es zudem passieren, dass weitere Experimente und neue Modelle aufgesetzt oder angepasst werden müssen, sollten die Ergebnisse der KI nicht zufriedenstellend sein. Daher ist es wichtig, auch immer einen internen Verantwortlichen zu benennen, der die Interpretationsphase und Entscheidungen hinsichtlich der nächsten Schritte vorantreibt.

Je nach eingangs definierter Fragestellung sollte bereits so früh wie möglich festgelegt werden, ab wann die Zuverlässigkeit der KI ausreichend ist. Dabei muss zwischen Zuverlässigkeit und Treffsicherheit unterschieden und abgewogen werden. Es kann Anwendungsfälle geben, bei denen eine Zuverlässigkeit von 80 Prozent ausreicht, in anderen braucht es eine 99-prozentige Treffsicherheit. Dies ist sehr individuell und kommt auf das gewünschte Einsatzszenario an.

Kreativität ist gefragt

Reicht die Zuverlässigkeit einer KI nicht aus, muss natürlich nachjustiert werden. Dennoch sollten Projektbeteiligte dies nicht unbedingt als Fehlschlag interpretieren. Hier kann oft auch ein kreativer Prozess entstehen, weil Projektbeteiligte überlegen müssen, wie sie weiter vorgehen wollen. So kann es sein, dass sie auf ganz neue Einsatzszenarien oder spannende Teilaspekte stoßen, aus denen mitunter neue Projekte entstehen.

Aus diesem Grund ist auch der Einsatz agiler, iterativer Projektmethoden und ein kreatives Vorgehen wichtig. Alle Projektbeteiligten sollten sich darauf einstellen, dass bei einem KI-Projekt, auch in Abhängigkeit vom jeweiligen Test- und Trainingsergebnis, oft schrittweise vorgegangen werden muss. Dies mag auf den ersten Blick ungewohnt erscheinen, doch KI-Projekte sind in der Regel immer noch Innovationsprojekte. Ein KI-Projekt verläuft deshalb oft explorativ und sollte daher auch als wichtiger kreativer Prozess mit dem Aufbau entsprechender Lernkurven begriffen werden. Eine standardisierte Vorgehensweise ist etwa der Cross-Industry Standard Process for Data Mining CRISP, ein von der EU gefördertes, branchenübergreifendes Standardmodell für Data Mining, mit dem Datenbestände nach Mustern, Trends und Zusammenhängen in sechs Phasen iterativ durchsucht werden.

Die richtige Expertise: intern aufbauen oder extern suchen?

Vor und auch während des Projekts sollten sich Verantwortliche immer wieder die Frage stellen: "Wie viel Wissen ist bereits im Unternehmen vorhanden und wie viel Wissen wird für das (weitere) KI-Projekt benötigt?" So beklagt in der IDC-Umfrage deutlich mehr als die Hälfte der Befragten, dass fehlendes Fachpersonal ursächlich für das Scheitern ihrer KI-Projekte sei. Beispielsweise mangele es ihnen an Entwicklern für KI-Systeme oder an Data Scientists. Zwar können Unternehmen auch mit wenig Wissen oft bereits eigene KI-Projekte durchführen, aber das nötige Know-how zu Modellen, KI-Systemen oder Tools sollten sich Unternehmen dann über externe Technologie-Partner sowie Hochschulen oder Start-ups holen. Dabei sollten Projektverantwortliche zumindest verstehen, was Trainingsdaten sind und was Labeling und Treffsicherheit bedeuten. Gerade das Troubleshooting kann mit Partnern oft effizienter gestaltet werden. Dennoch braucht es immer eine treibende interne Kraft, um das Projekt auch bei längeren Testphasen oder bei der Fehlersuche im Unternehmen voranzutreiben.

Typische Herausforderungen und Fragestellungen in KI-Projekten sind:

- Wie finden wir den richtigen Use Case und grenzen das Problem, das die KI lösen soll, klar ab?

- Haben wir Zugang zu hochqualitativen und gelabelten Test- und Trainingsdaten?

- Wie können wir bekannte Probleme wie Overfitting erkennen und meistern?

- Sind ausreichend internes Wissen und Ressourcen vorhanden oder benötigen wir einen geeigneten externen Projektpartner?

- Sind wir in der Lage, agile Projektmethoden zu nutzen und uns auf einen kreativen Prozess einzulassen? KI sind meist Innovationsprojekte und noch nicht entsprechend standardisiert.

Unternehmen sind mit KI-Projekten zufrieden

Trotz aller Hürden fällt die Bilanz zu KI-Projekten oft positiv aus: 80 Prozent der Unternehmen geben an, dass sie einen direkten Nutzen aus Projekten mit KI ziehen. Bei Firmen, die sich noch in einem frühen Stadium der KI-Nutzung befinden, liegt dieser Wert bei immerhin noch 71 Prozent, so eine Umfrage von Microsoft aus diesem Jahr [7]. Grundsätzlich sollten Unternehmen KI-Projekte als kreativen Prozess verstehen, der zwar Zeit und Ressourcen benötigt, aber auch Innovationen vorantreiben und gewinnbringend für Team und Unternehmen sein kann.

- Umfrage von PWC: Künstliche Intelligenz in Unternehmen

- Projektpartner: Datenexperte Uniserv und das spanische KI-Start-up recogn.ai

- biome.text

- IBM-Umfrage: From Roadblock to Scale: The Global Sprint to AI

- Untersuchung von data iku: AI Maturity Survey

- IDC: Künstliche Intelligenz in Deutschland

- Microsoft-Studie zu künstlicher Intelligenz: Erfolgreiche Unternehmen gewichten Technologie und Qualifizierung gleich