Business Intelligence (BI): Strategische Steuerung von Leistungen und Innovationen

Verlieren Business Intelligence Competence Center (BICC) ihre Kompetenz in den Unternehmen?

Unter dem Begriff Big Data werden verschiedene Begriffe subsumiert, wie Digitalisierung, Industrie 4.0, Internet der Dinge, Data Science Lab oder datengetriebene Unternehmungen. Big Data als globaler Megatrend hat verschiedene Aspekte: Riesige heterogene und polystrukturierte Daten stehen in beinahe grenzenloser Beziehung. Firmeneigene Kundendaten können beispielsweise mit externen demografischen Informationen aus Open Data, geoanalytischen Systemen und sozialen Plattformen kombiniert werden, was neue analytische Erkenntnisse ermöglicht. Allerdings nehmen hier die Business Intelligence Competence Center (BICC) keine führende Rolle ein, wie es zu erwarten wäre.

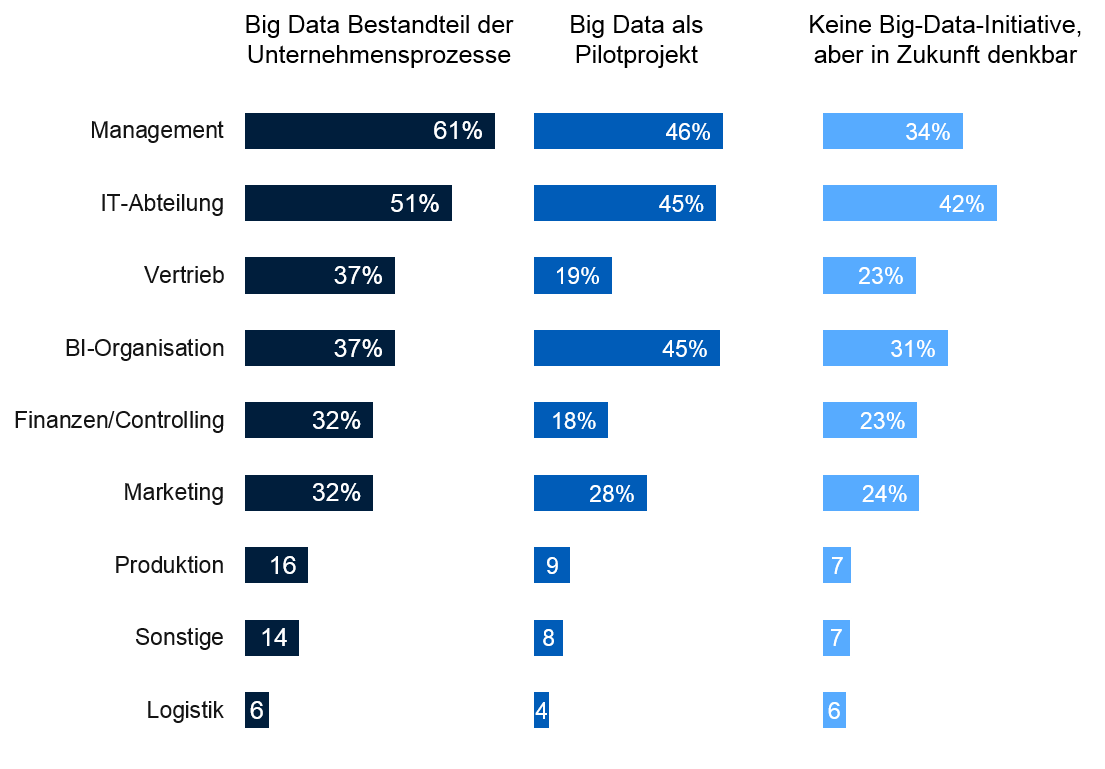

In Unternehmen mit einer etablierten Big Data-Strategie übernimmt das Management üblicherweise die Führung, was so auch sinnvoll ist (Abb.1). Hingegen sind BICCs nur gering involviert. Gemäß der BARC-Studie "Big Data Use Cases 2015" [1] starten die meisten Unternehmen mit einem Pilotprojekt, um erste Erfahrungen zu sammeln und später eine Big Data-Strategie zu etablieren. Des Weiteren zeigt die Studie, dass bei Pilotprojekten noch etwas häufiger auf das Wissen von BI-Organisationen zugegriffen wird. Allerdings ist bei etablierten Big Data-Strategien die BI-Organisation der einzige Unternehmensbereich, der weniger involviert ist als in Pilotprojekten.

Das Dilemma der BI-Organisationen

Dieser Vertrauensverlust gegenüber den BI-Organisationen erstaunt nur auf den ersten Blick. Heutige Business Intelligence Competence Center kämpfen mit verschiedenen Problemen, wobei sich drei besonders auswirken:

- Umgang mit Daten.

Aufgrund mangelhafter Datenqualität ist das Vertrauen in vorhandene Analysen recht gering. Hierfür wird allerdings das BICC zu Unrecht verantwortlich gemacht, da die Daten im Business erfasst werden. Viele BICCs haben es jedoch verpasst, geeignete Instrumente zur Messung und zur Verbesserung der Datenqualität zur Verfügung zu stellen. - Hohe Ressourcenbindung durch operative Aufgaben.

Die über die Jahre gewachsene Infrastruktur benötigt fast die gesamte Manpower eines BICCs, nur um den Status Quo sicherzustellen. Darunter fallen vielfältige Aufgaben, wie nur halbautomatisierte Ladeprozesse, Anpassung der Datenmodelle, Einspielen von Patches, User-Support. Für Innovationen bleibt keine Zeit mehr. - Kundenerwartungen und Leistungsangebot sind nicht abgestimmt.

Die zu erbringenden Leistungen des BICCs sind nur unscharf geregelt. Dadurch entstehen häufig Erwartungen in den Bereichen des Power User-Supports, der Datenbereinigung und der Umsetzung von Änderungen, die nicht erfüllt werden können.

Service-Portfolio

Ein Ausweg aus diesem Dilemma ist ein klar definiertes und verwaltetes Service-Portfolio, gemäß der ITIL-Methodologie (Abb.2) [2]. Ein definierter Service-Katalog beinhaltet eine klare Beschreibung der angebotenen BI-Leistungen, gegliedert in Core und Enhancement Services (Optionen, die das Grundangebot erweitern), kombiniert mit schriftlichen Service Level Agreements (SLAs) und einem effektiven Kostenverrechnungssystem. Das Preisschild ist häufig das einzige Instrument, übersteigerte Kundenwünsche wieder auf den Boden der Realität zu holen.

Innerhalb des Service-Katalogs erhalten Services ein "Ablaufdatum". Verschiedene Faktoren bestimmen dabei den Lifecycle eines Services, wie rückläufige Nutzerzahlen, veränderte Kosten-Nutzen-Rechnungen oder nicht mehr unterstützte Produkte durch den Hersteller (Software Lifecycle Management). Durch auslaufende Angebote freiwerdende Kapazitäten sollen durch neue Angebote ersetzt werden, die Service-Pipeline. Der Anstoß für neue Angebote kann von verschiedenen Seiten kommen, seien es Kundenwünsche, eine geänderte Unternehmensstrategie, Marktveränderungen oder -beobachtungen.

Service-Baukasten und Kostentransparenz

Es empfiehlt sich, die angebotenen Leistungen innerhalb eines Services in ein Grundangebot und ergänzende Optionen zu strukturieren. Das Grundangebot – Core Service genannt – enthält alle Basisleistungen. Für ein Business Intelligence-System sind dies Softwarelizenzen, Datenzugriff und Storage, Störungsbehebung, Hotline, etc.

Service-Optionen (Addition oder Enhancement Services) umfassen weitere Leistungen wie eine erhöhte Auskunftsbereitschaft oder "User Guidance". Mit User Guidance werden alle Hilfestellungen für Endanwender bezeichnet, wie beispielsweise die Unterstützung bei der Reporterstellung, die manchmal einen erheblichen Zeitbedarf einnimmt. Da diese Leistung als Option angeboten wird, hat der (interne) Kunde die Möglichkeit, diese Zusatzleistungen kostenpflichtig zu beziehen oder darauf zu verzichten. Ist ihm diese Option zu teuer, hat er immer noch die Möglichkeit, seine Anwender mittels Ausbildung, Self Help-Portalen, etc. zu befähigen.

Aufgrund der Kritikalität und der erwarteten Verfügbarkeit wird jeder Service einem Service-Level zugeordnet. Dieser definiert die erwartete Verfügbarkeit, Reaktionszeit bei Incidents, akzeptierte Ausfallzeiten und -häufigkeit, Wartungsfenster, etc. Meistens werden dafür Begriffe wie Gold-, Silber- und Bronze-Level verwendet. Gold-Level wird üblicherweise für hochverfügbare Systeme angewandt, was bedeutet, dass die technische Infrastruktur redundant ausgelegt ist und über ein Failover-Konzept verfügt. Allerdings ist die einheitliche Regelung eines Service-Levels nicht ganz einfach. Benötigt ein Management-Reporting-System Gold-Level, muss ebenfalls das zentrale Data Warehouse hochverfügbar sein, welches die Daten bereitstellt. Dies hat höhere Betriebskosten zur Folge. Was wiederum zu Diskussionen führt, wer diese zusätzlichen Kosten tragen muss, wenn die meisten Nutzer mit einem Bronze-Level zufrieden wären.

Um gleich bei den Kosten zu bleiben: Alle fixen oder sprungfixen Kosten werden den Core Services zugeordnet. Variable Kosten können sowohl einem Core Service als auch einem Additional Service zugeordnet werden. Unregelmäßig anfallende Kosten werden nach Aufwand verrechnet.

Die Erarbeitung eines zweckmäßigen Service-Models benötigt Erfahrung und erheblichen Abstimmungsaufwand. Dazu eignet sich ein Vorgehen in folgenden fünf Schritten (Abb.3):

- Definition einer geeigneten Service-Struktur und der einzelnen Services

- Zuordnung der Services zu den entsprechenden Service Levels

- Gliederung der Leistungen in Core und Additional Services, sowie das Definieren der nicht enthaltenen Leistungen (variable Verrechnung)

- Ermitteln der Kostenstruktur, gegliedert in fixe, sprungfixe, volumenbasierte und variable Kosten.

- Bestimmen der Leistungsverrechnung, wobei eine direkte Leistungsverrechnung an den Kunden zu bevorzugen ist. Pauschalbudgets verhindern Kostentransparenz und bieten wenig Anreiz zum Sparen, respektive eine Differenzierung in Core und Enhancement Services. Das hat zur Folge, dass die gesamten IT-Kosten steigen – ohne eine wahrnehmbare Effizienzsteigerung.

Es stehen sechs verschiedene Modelle zur direkten oder indirekten Kostenverrechnung zur Verfügung. Eine direkte Kostenverrechnung ist dabei zu bevorzugen. In der Praxis werden gerne mehrere Modelle in Kombinationen verwendet (s. Abb.4). Angebotene Business Intelligence-Leistungen müssen dabei bereits existieren und übergeordnete Modelle zur Kostenverrechnung von IT-Leistungen innerhalb der Unternehmen berücksichtigen.

3K des Innovationsmanagements

Um eine effektive Innovation innerhalb des Service-Portfolios anstoßen und steuern zu können, müssen weitere Voraussetzungen erfüllt sein: Die 3K des Innovationsmanagements:

- Kapazität

Eine mit dem Tagesgeschäft dauernd überlastete Organisation wird wenig Enthusiasmus aufbringen, noch weitere Leistungen anzubieten. Daher muss zuerst eine leichte Überkapazität erreicht werden. Dazu gibt es verschiedene Möglichkeiten, wie Einstellen von nicht mehr oder nur selten benötigten Services mit geringem Businessnutzen, Effizienzsteigerung durch das neue Gestalten von Prozessen oder schlicht durch das Einstellen von weiterem Personal. - Kreativität

Neue Ideen entstehen nicht durch Zufälle, sondern durch harte Arbeit. Verschiedene Kreativitätstechniken können den einzelnen Mitarbeiter, Bereiche oder eine gesamte Organisation unterstützen. - Kultur

Die Unternehmenskultur kann Innovation behindern oder fördern. Eine Unternehmung, die nur auf Bewährtes setzt und eine Nullfehlerkultur hat, wird nicht besonders innovativ sein. Werden bei einem Fehler sofort Schuldige gesucht und bestraft, werden Fehler gerne vertuscht. Anders sieht es aus, wenn Fehler offen diskutiert, Ursachen analysiert und Verbesserungen angestoßen werden. Weiter spielt die Regelung zum Umgang mit der persönlichen Arbeitszeit ebenfalls eine wichtige Rolle. Muss jede erfasste Stunde einem Projekt oder einer angeordneten Aufgabe zugeordnet werden können? Oder sind auch Stundenbuchungen ohne direkten Auftrag möglich?

Herausforderung: Zweckmäßiger Einsatz von Standards und Normen

Um das Vertrauen des Managements zu gewinnen und zu einem kompetenten Partner für Big Data-Initiativen zu werden, genügen ein Service-Portfolio und eine Service-Pipeline noch nicht. Dazu sind eine transparente Kommunikation und eine vollständige BI Governance – beispielsweise mit Elementen aus ITIL, COBIT oder CMMI – notwendig [2]. Im Bereich der Datenqualität und der Information Governance können Frameworks wie DAMA oder GARP [2] unterstützen.

Leider gibt es keine Governance-Modelle für Business Intelligence und Data Warehousing. Dadurch müssen Frameworks wie ITIL oder COBIT entsprechend adaptiert werden, was grundsätzlich möglich ist. Allerdings ist es wichtig, die Grenzen der Modelle zu kennen. Kompromisse sind dabei in einzelnen Bereichen und Prozessen notwendig.

Eine weitere Herausforderung sind die oft fehlenden Skills bezüglich Big Data-Technologien und -Methoden.

Fazit

Damit zu den Schlussfolgerungen:

- Ohne zweckmäßigen Innovationsprozess riskieren BI-Organisationen, auf veralteten Services sitzenzubleiben und mit diesen unterzugehen.

- Ein strukturiertes Leistungsangebot (Service-Katalog) – gegliedert in Core und Addition Services – kombiniert mit einer direkten Leistungsverrechnung, ermöglicht eine zweckmäßige Steuerung von Prozessen, Aufgaben und Ressourcen.

- Ein gut strukturiertes Service-Portfolio-Management und die 3K des Innovationsmanagements sind die Voraussetzung für eine kontinuierliche Weiterentwicklung von Angeboten und Dienstleistungen.

- Eine zukunftsfähige Service-Pipeline berücksichtigt Anforderungen der traditionellen und der explorativen Analytik. Traditionelle Analytik verwendet strukturiere, gesicherte und meist unternehmenseigene Daten, während eine explorative Analytik auch unstrukturierte und polystrukturierte Daten aus teils ungesicherten externen Quellen nutzt.

- Eine vollständige und abgestimmte BI-Governance und BI-Strategie berücksichtigt Elemente aus bestehenden Frameworks wie ITIL, COBIT, CMMI, TOGAF, usw.

Quellen

- BARC-Studie: Big Data Use Cases 2015

- ITIL (IT Infrastructure Library), COBIT (Control Objectives for Information and Related Technology), CMMI (Capability Maturity Model Integration), GARP (Generally Accepted Recordkeeping Principles)