Intelligente Testdaten für moderne Softwarequalität

- Teil 1

Synthetische Testdaten richtig erzeugen – Grundlagen & Use Cases

In modernen Softwareprojekten entscheidet die Qualität der Testdaten zunehmend über die Qualität der gesamten Anwendung. Klassische Demo- oder Produktionsdaten stoßen dabei schnell an technische, organisatorische und rechtliche Grenzen. Gefragt sind stattdessen realitätsnahe, skalierbare und zugleich datenschutzkonforme Testdatensätze, die sich automatisiert bereitstellen lassen. Genau hier setzt modernes Test Data Management an. Diese Artikelserie zeigt, wie synthetische Testdaten erzeugt, sensible Informationen geschützt und Testumgebungen effizient betrieben werden können.

Moderne Anwendungssysteme greifen heute auf hochgradig heterogene und verteilte Datenlandschaften zu – von relationalen Datenbanken über NoSQL-Speicher und Streaming-Plattformen bis hin zu Mainframe- und Cloud-Datenquellen. Entwickler- und Testteams stehen damit vor der Herausforderung, realistische Testdaten in der erforderlichen Menge, Vielfalt und strukturellen Konsistenz bereitzustellen. Gleichzeitig dürfen keine sensiblen Produktionsdaten in Testumgebungen gelangen, da dies erhebliche Datenschutz- und Sicherheitsrisiken nach sich ziehen würde. Darüber hinaus müssen Testdaten stark skalieren und unterschiedlichste Datentypen sowie -formate abbilden. Klassische Ansätze auf Basis realer, lediglich maskierter Daten stoßen hierbei zunehmend an Grenzen: Restrisiken bleiben bestehen, und seltene Randfälle lassen sich nur unzureichend simulieren [1].

An das Generieren von Testdaten werden daher vielfältige Anforderungen gestellt. Die verwendeten Tools müssen in der Lage sein, enorme Datenmengen zu erzeugen, um Performance- und Stresstests mit Hunderten Millionen bis hin zu Milliarden Datensätzen realistisch durchführen zu können. Zugleich ist eine hohe Vielfalt und Realitätsnähe erforderlich. Testdaten sollen unterschiedliche Datenquellen und -formate, etwa relationale Datenbanken, JSON-Strukturen, Streams oder sogar Bilddaten, repräsentieren und dabei authentische Werteverteilungen, plausible Wertebereiche sowie konsistente Datenmuster aufweisen. Ebenso zentral ist der Aspekt von Datenschutz und Compliance: Testdaten dürfen keine echten personenbezogenen Informationen enthalten und müssen regulatorischen Vorgaben, insbesondere der DSGVO, vollständig entsprechen.

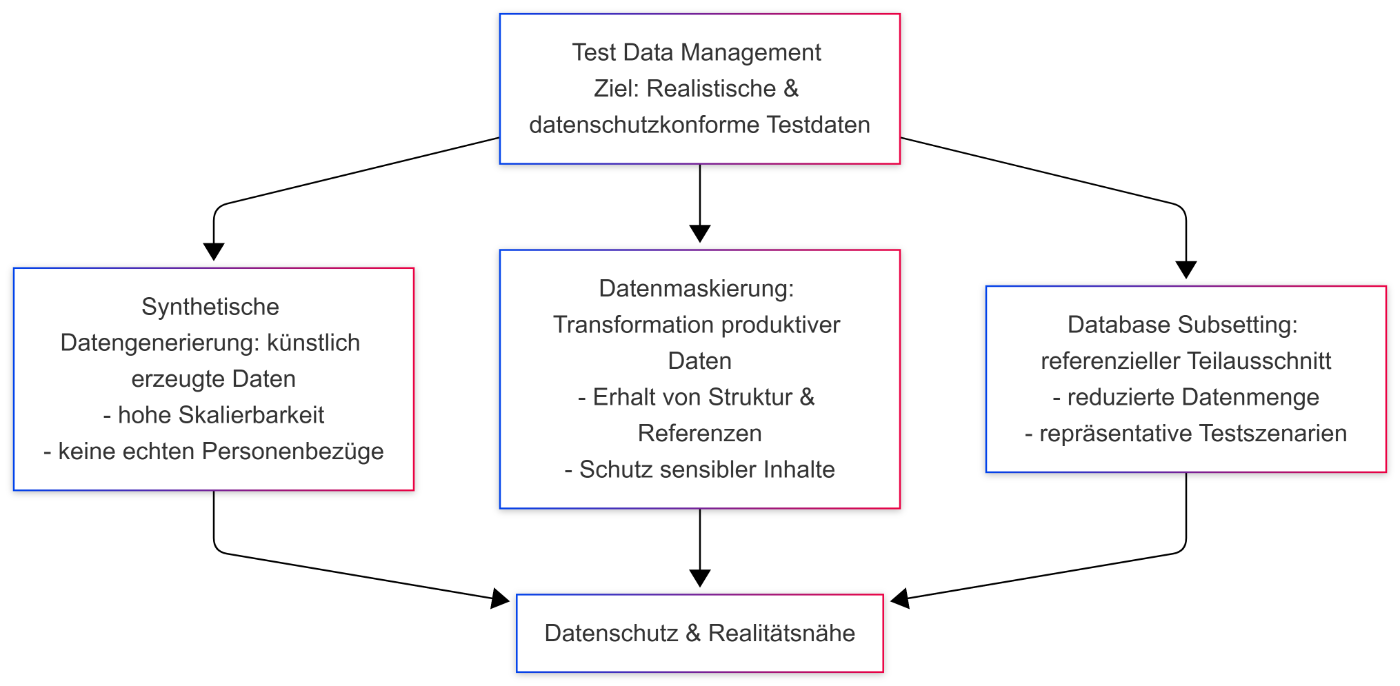

Zur Erfüllung dieser Anforderungen haben sich im Test Data Management drei grundlegende Strategien etabliert (Bild 1):

- synthetische Testdaten

- Datenmaskierung

- Database Subsetting.

Alle Strategien verfolgen dasselbe Ziel, d.h. den Schutz produktiver Daten bei gleichzeitiger Bereitstellung realistischer Testbedingungen. Sie unterscheiden sich jedoch deutlich in Ansatz und Einsatzgebiet. Bei der synthetischen Testdatengenerierung werden Daten künstlich auf Basis von Datenmodellen "from scratch“ erzeugt. Dadurch lassen sich realistische Strukturen und statistische Verteilungen nachbilden, ohne dass ein Bezug zu realen Personen entsteht. Datenmaskierung hingegen anonymisiert vorhandene Produktionsdaten, indem sensible Inhalte durch plausible Ersatzwerte ausgetauscht werden, während Struktur und referenzielle Integrität erhalten bleiben. Database Subsetting schließlich extrahiert einen referenziell konsistenten, verkleinerten Ausschnitt der Produktionsdatenbank, um repräsentative, aber deutlich reduzierte Testdatensätze bereitzustellen. Die drei Ansätze unterscheiden sich damit insbesondere hinsichtlich Datenquelle, Skalierbarkeit und typischer Anwendungsfälle, bilden jedoch gemeinsam das methodische Fundament eines modernen, datenschutzkonformen Testdatenmanagements.

Überblick über die Artikelserie

Teil 1: Synthetische Testdaten richtig erzeugen – Grundlagen & Use Cases

Teil 2: Datenschutz & Maskierung in Testumgebungen

Teil 3: Database Subsetting & vollautomatisiertes Test Data Management

Grundlagen synthetischer Testdaten

Synthetische Testdaten sind künstlich generierte Daten, die die statistischen Eigenschaften realer Daten imitieren, jedoch keine echten personenbezogenen Informationen enthalten. Sie werden nicht durch Maskierung vorhandener Datensätze gewonnen, sondern vollständig neu anhand von Datenmodellen oder Metadaten erzeugt. Damit bieten sie mehrere Vorteile gegenüber anonymisierten Produktionsdaten:

- Datenschutz: Weil keine realen Kundendaten verwendet werden, ist das Risiko von Datenpannen oder Rückidentifikation praktisch ausgeschlossen. Tester können bedenkenlos mit großen Datensätzen arbeiten.

- Kontrollierbarkeit: Entwickler können Verteilungen, Wertebereiche oder Datenlogik exakt vorgeben und dadurch seltene Szenarien oder Randfälle gezielt abdecken, etwa bei KI-Trainingsdaten.

- Reproduzierbarkeit: Generatoren erzeugen deterministisch oder nach definierten Wahrscheinlichkeiten wiederholbare Datensätze, was Regressionstests vereinfacht.

- Verfügbarkeit: Es entfällt das mühsame Aufbereiten oder Pflegen großer Produktionsdatenbestände für Testzwecke.

Einsatzgebiete synthetischer Testdaten sind vielfältig, von automatisierten Funktionstests über Performance- und Belastungstests bis hin zu Demo- oder Schulungsumgebungen und dem Training von Machine-Learning-Modellen. In KI- und Analytics-Projekten können synthetische Datensätze sogar helfen, unterrepräsentierte Fälle abzubilden und Modell-Bias zu reduzieren.

In der praktischen Anwendung zeigt sich der Nutzen synthetischer Datengenerierung vor allem in Entwicklungs- und QA-Tests, Performance- und Lastszenarien, Benchmark-Umgebungen oder beim Prototyping von Datenplattformen und ETL-Strecken. Gegenüber klassischen Maskierungsverfahren bietet die vollständige Neugenerierung den Vorteil, dass keinerlei Rückschluss auf reale Personen oder Geschäftsvorfälle möglich ist, während Struktur, Verteilung und Systemverhalten dennoch realitätsnah bleiben.

Überblick über IRI RowGen & Voracity TDM

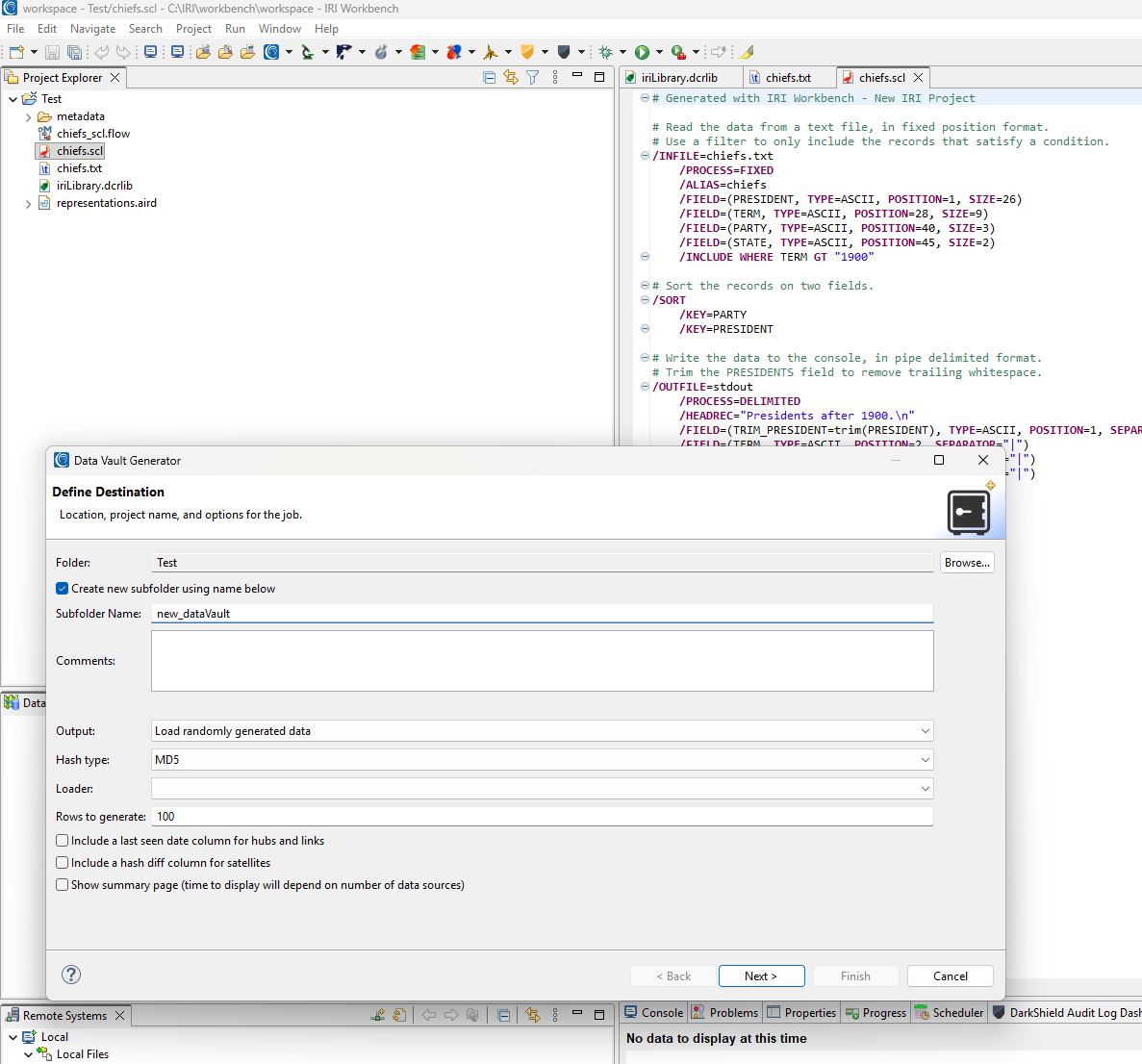

Voracity ist eine integrierte Data-Management-Plattform der Firma JET-Software GmbH. Sie stellt umfassende Werkzeuge, darunter RowGen (Bild 2) für das Test Data Management, FieldShield für die Datenmaskierung und DarkShield zum Aufdecken von verborgenen Daten, unstrukturierten Text- und Bilddateien, Dokumenten und NoSQL-DBs oder anderen sogenannten Dark Data Repositories, bereit [2].

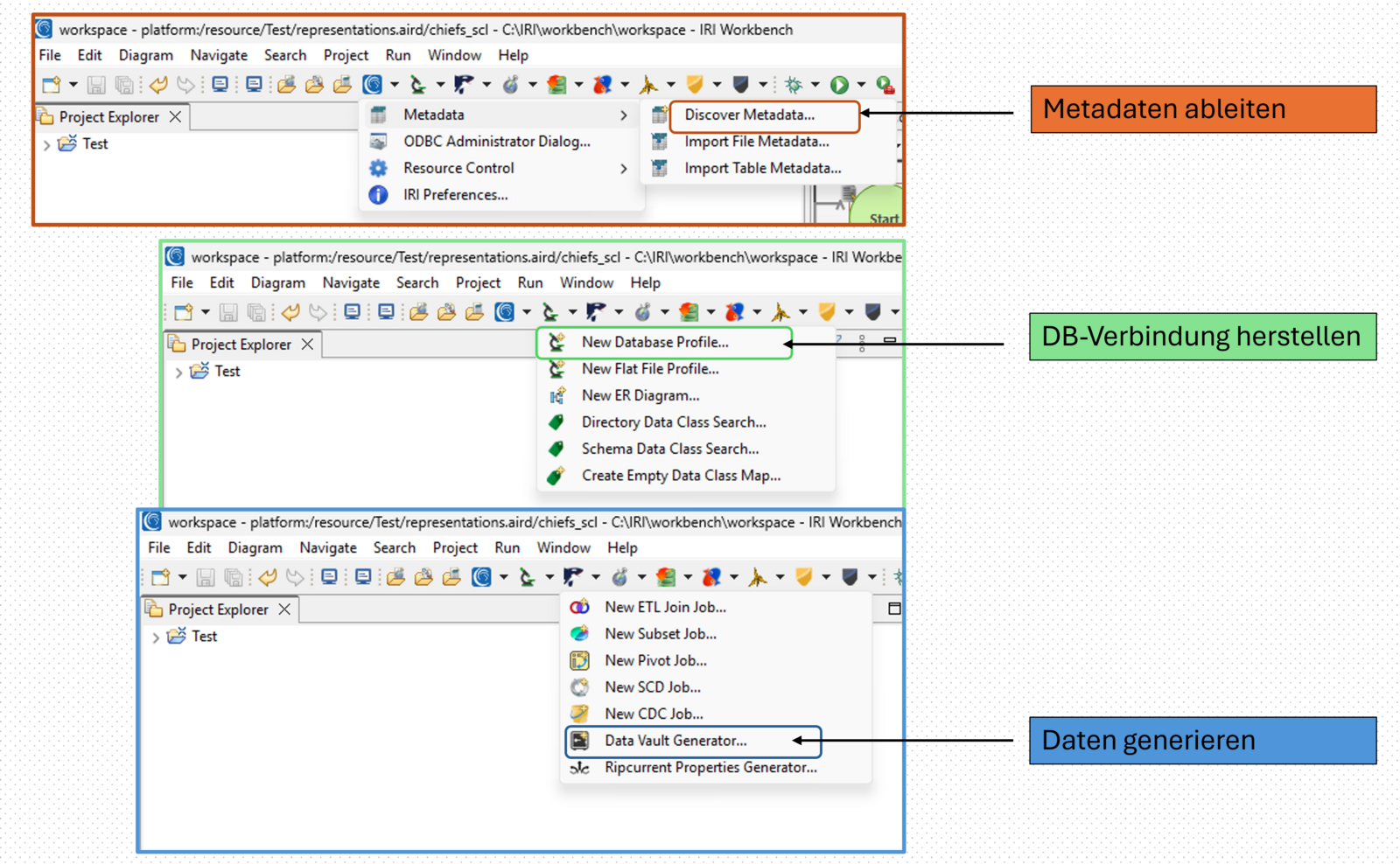

Alle Werkzeuge werden in einer Eclipse-basierten Entwicklungsumgebung, der IRI Workbench, zusammengeführt (Bild 3).

Durch diese Bündelung entsteht eine konsistente Arbeitsumgebung, in der Datenanalyse, Transformation, Schutzmechanismen und Testdatengenerierung nicht isoliert, sondern als zusammenhängender Prozess betrachtet und umgesetzt werden können.

Architektonisch basiert die Plattform auf der leistungsfähigen SortCL Engine, die als gemeinsamer Verarbeitungskern für alle Datenoperationen dient. Dadurch lassen sich selbst große Datenmengen performant transformieren, profilieren, maskieren oder synthetisch erzeugen. Für Entwicklungs- und Testteams bedeutet dies vor allem Konsistenz: Einmal definierte Metadaten, Regeln oder Transformationslogiken können über verschiedene Anwendungsfälle hinweg wiederverwendet werden, beispielsweise von der Datenaufbereitung über die Maskierung bis hin zur Generierung vollständiger Testdatensätze. Gleichzeitig ermöglicht die IRI Workbench sowohl eine grafische Modellierung als auch skriptbasierte Automatisierung, wodurch sich unterschiedliche Arbeitsstile innerhalb von DevOps- und Data-Engineering-Teams flexibel unterstützen lassen.

Ein zentrales Einsatzfeld innerhalb von Voracity ist das Test Data Management. Mit RowGen können synthetische, referenziell konsistente Testdaten auf Basis bestehender Datenmodelle oder Metadaten erzeugt werden. Dabei werden strukturelle Abhängigkeiten wie Primär- und Fremdschlüsselbeziehungen ebenso berücksichtigt wie Datentypen, Wertebereiche oder statistische Verteilungen. Auf diese Weise entstehen realitätsnahe Datensätze, die produktive Systeme in Struktur und Verhalten widerspiegeln, ohne personenbezogene Informationen zu enthalten.

Technisch unterstützt Voracity eine breite Palette an Datenquellen und Zielformaten. Neben klassischen relationalen Datenbanksystemen lassen sich Flat Files, JSON- und XML-Strukturen, Office-Dokumente und spezialisierte Industriestandards einbinden und verarbeiten. Auch moderne Streaming- und Messaging-Szenarien können adressiert werden, sodass Testdaten nicht nur in Datenbanken, sondern ebenso in verteilten Architekturen bereitgestellt werden können. Diese Formatvielfalt ist insbesondere für hybride IT-Landschaften relevant, in denen Legacy-Systeme, Cloud-Plattformen und datengetriebene Microservices parallel existieren.

Darüber hinaus ist die Plattform konsequent auf Automatisierung und Integration ausgelegt. Alle Verarbeitungsschritte lassen sich über Skripte, APIs oder Kommandozeilenaufrufe steuern und damit nahtlos in CI/CD-Pipelines, Container-Umgebungen oder datengetriebene Testprozesse einbinden. Testdaten können so reproduzierbar erzeugt, versioniert und bei Bedarf vollständig neu bereitgestellt werden. Das ist ein wesentlicher Faktor für Continuous Testing, Compliance-Nachweise und schnelle Releasezyklen [3].

Realistische Datenmodellierung

Die synthetische Generierung realistischer Testdaten stellt in vielen Entwicklungs-, Test- und Analyseprozessen eine zentrale Voraussetzung dar, insbesondere wenn produktive Daten aus Datenschutz-, Sicherheits- oder Verfügbarkeitsgründen nicht verwendet werden dürfen. Ein wesentliches Merkmal von RowGen ist die konsequente Berücksichtigung struktureller und referenzieller Integrität. Metadaten aus relationalen Datenbanksystemen können übernommen werden, wodurch Primär- und Fremdschlüsselbeziehungen, NULL-Eigenschaften, Constraints oder Indizes automatisch in die Datengenerierung einfließen. Auf diese Weise entstehen zusammenhängende Datenbestände, beispielsweise etwa valide Kunde-Auftrag-Strukturen, bei denen Joins, Kardinalitäten und Abhängigkeiten exakt so funktionieren wie in produktiven Umgebungen. Gerade für Integrations-, Migrations- oder Lasttests ist diese Konsistenz entscheidend, da nur so realistische Systemreaktionen beobachtet werden können [4].

Über die reine Strukturtreue hinaus ermöglicht RowGen eine sehr feingranulare Steuerung der inhaltlichen Datenverteilung. Für einzelne Felder lassen sich Wertebereiche, statistische Verteilungen oder regelbasierte Ableitungen definieren. Numerische Attribute können beispielsweise durch Minimum- und Maximum-Grenzen sowie lineare, normalverteilte oder prozentual gewichtete Zufallsfunktionen beschrieben werden. Zeichenketten lassen sich mithilfe regulärer Ausdrücke, Formatdefinitionen oder externer Wertelisten erzeugen, wodurch typische Muster wie E-Mail-Adressen, Telefonnummern, Codes oder Identifikatoren realistisch nachgebildet werden können. Ebenso unterstützt das Werkzeug zusammengesetzte Datenwerte, bei denen mehrere Teilkomponenten schrittweise kombiniert werden, um komplexe Strukturen abzubilden. Diese Mechanismen erlauben nicht nur gleichverteilte Zufallsdaten, sondern auch bewusst gesteuerte Häufigkeiten, seltene Randfälle oder ungleichmäßige Verteilungen, wie sie in realen Geschäftsdaten häufig vorkommen.

Das Werkzeug bietet darüber hinaus vielfältige Möglichkeiten, Regeln feld- oder tabellenübergreifend anzuwenden und wiederzuverwenden. Daten können zufällig aus externen Mengendateien ausgewählt, als Literalwerte vorgegeben oder aus frei definierbaren numerischen Bereichen generiert werden. Dieselben Generierungsregeln lassen sich konsistent auf Datenbanktabellen, Flat-File-Strukturen oder benutzerdefinierte Berichtsausgaben übertragen. Die Definition solcher Regeln erfolgt entweder komfortabel über grafische Assistenten innerhalb der IRI Workbench oder skriptbasiert, was insbesondere für automatisierte Build-, Test- oder CI/CD-Prozesse von Bedeutung ist.

Ein weiterer Vorteil liegt in der breiten Unterstützung möglicher Zielsysteme und Ausgabeformate. Neben klassischen relationalen Datenbanken können Testdaten auch in strukturierte oder teilstrukturierte Dateien geschrieben werden, etwa CSV-, JSON-, XML- oder Fixed-Length-Formate. Ebenso werden Mainframe-nahe Strukturen wie COBOL- und branchenspezifische Formate beispielsweise aus dem Gesundheits- oder EDI-Umfeld unterstützt. Dadurch eignet sich RowGen nicht nur für moderne Cloud- oder Data-Warehouse-Architekturen, sondern ebenso für heterogene Systemlandschaften mit Legacy-Komponenten.

Gemeinsame Metadatenmodelle ermöglichen es, Datenprofiling, Maskierung, Subsetting und synthetische Generierung miteinander zu verbinden. So können sensible Produktionsdaten zunächst analysiert und geschützt werden, während parallel vollständig künstliche, aber dennoch realistische Datensätze für Entwicklung und Qualitätssicherung entstehen. Dieser Ansatz unterstützt sowohl regulatorische Anforderungen als auch reproduzierbare Testprozesse.

Praxisbeispiel: Erzeugung konsistenter Testdaten aus einem Datenmodell

Ein typischer Workflow zur Generierung synthetischer Testdaten mit RowGen beginnt mit einem vollständig definierten relationalen Datenmodell. Folgende Schritte zeigen, wie man aus diesen Metadaten automatisiert einen realitätsnahen und referenziell konsistenten Testdatensatz erzeugt:

Metadaten erstellen: Zunächst legt man alle Zieltabellen in der Datenbank an. In der IRI Workbench verbindet man sich mit dem Zielsystem (Datenbank). Fortfolgend kann man mit dem integrierten ER-Diagramm-Tool das Schema visualisieren und prüfen. Diese Metadaten – insbesondere die Struktur der Tabellen, Primär- und Fremdschlüssel sowie Datentypen – bilden die Grundlage für die Testdatengenerierung. RowGen liest die DDL-Beschreibungen und Constraints automatisch ein und übersetzt sie in seine Generierungslogik.

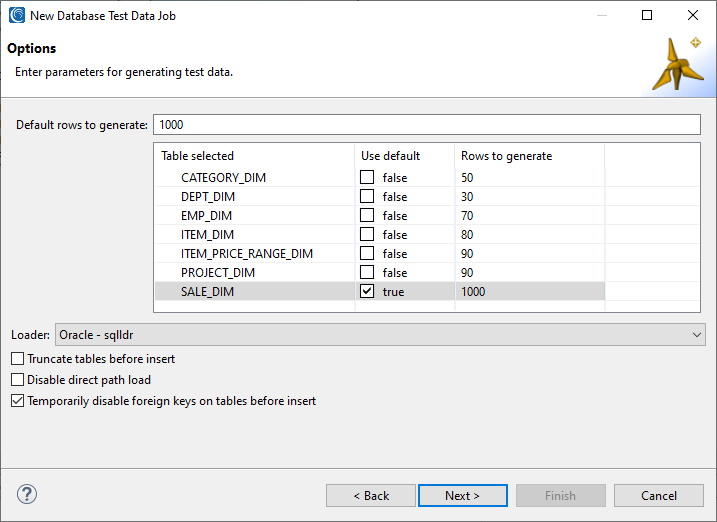

RowGen-Projekt und Wizard starten: Nun wählt man in der Workbench alle zu befüllenden Tabellen aus. Im Assistenten wählt man das Schema und die Tabellen aus, die befüllt werden sollen. Man definiert ebenso die gewünschte Anzahl von Datensätzen pro Tabelle, z.B. 1.000 Zeilen. Dieser Schritt generiert im Hintergrund ein neues RowGen-Projekt, das automatisch die erkannten Tabellenstrukturen und Integritätsbeziehungen verwendet.

Felder-Regeln konfigurieren: Im nächsten Schritt legt man die Generierungsregeln für jede Spalte fest. Dabei können Namensmuster verwendet werden, um Regeln auf mehrere Felder anzuwenden. Über solche Muster können Sie beispielsweise externe Set-Dateien zuordnen, die echte oder realistische Werte enthalten, beispielsweise Listen von Personen- oder Produktnamen. RowGen fügt dann für jede entsprechende Spalte zufällig einen Eintrag aus der passenden Liste ein, um die Datenqualität zu erhöhen. Neben der Zufallsauswahl aus Set-Dateien lassen sich auch numerische Verteilungen, konstante Werte oder mathematische Ausdrücke definieren, um etwa Beträge oder Datumsangaben zu generieren. Diese Regeln decken gezielt verschiedene Szenarien ab.

Daten generieren und laden: Nach Abschluss der Konfiguration erstellt RowGen automatisch sämtliche benötigten Skripte. Führt man diese aus, produziert RowGen zunächst flache Ausgabedateien mit den Testdaten und lädt diese anschließend in die Zieltabellen. Dabei werden die Tabellen in der richtigen Reihenfolge (Eltern- vor Kind-Tabellen) befüllt, sodass alle Fremdschlüsselbeziehungen gewahrt bleiben (Bild 4).

Nach nur kurzer Ausführungszeit liegen umfangreiche, konsistente Testdatensätze vor, die die Struktur und Verteilung des Produktionssystems widerspiegeln, jedoch keine echten personenbezogenen Informationen enthalten.

Fazit

Die Bereitstellung realistischer und zugleich datenschutzkonformer Testdaten entwickelt sich zu einem zentralen Erfolgsfaktor moderner Softwareentwicklung. Klassische Ansätze auf Basis produktiver Daten stoßen angesichts wachsender Datenmengen, heterogener Systemlandschaften und regulatorischer Anforderungen zunehmend an ihre Grenzen. Synthetische Datengenerierung eröffnet hier neue Möglichkeiten, indem sie reproduzierbare, skalierbare und strukturell konsistente Testumgebungen ohne Rückgriff auf reale Personen- oder Geschäftsdaten schafft. Gleichzeitig unterstützt sie agile Entwicklungsprozesse, automatisierte Tests sowie datengetriebene Analyse- und KI-Szenarien. Entscheidend ist dabei weniger die einzelne Methode als vielmehr ein ganzheitliches Test Data Management, das Datenschutz, Datenqualität und technische Realitätsnähe miteinander verbindet. Damit wird Testdatenstrategie zu einem integralen Bestandteil nachhaltiger Softwarequalität.

- Security-Insider-Redaktion. (2026, 9. Januar). Produktionsdaten wie „Kronjuwelen" schützen. Security-Insider. Vogel IT-Medien GmbH. https://www.security-insider.de/produktionsdaten-wie-kronjuwelen-schuetzen-a-3140d70a4fa5f18183cb2263f924a761/

- Innovative Routines International (IRI). (o. J.). Test data generation solutions. https://www.iri.com/solutions/test-data [Abgerufen: 1. April 2026]

- JET-Software GmbH. (o. J.). RowGen: Synthetische Testdaten für DBs, Dateien und Berichte. https://www.jet-software.com/rowgen/ [Abgerufen: 1. April 2026]

- Bartoletti, I. (2025, 17. Januar). Synthetische Daten – Datenschutz-Universallösung oder Governance-Herausforderung? [Kommentar]. BigData-Insider. Vogel IT-Medien GmbH. https://www.bigdata-insider.de/synthetische-daten-datenschutz-universalloesung-oder-governance-herausforderung-a-7808b3505ff588a71d23ea2a60eb2ee3/