Gedächtnis in Multi-Agent-Systemen: Wie evolutionäre Prinzipien die Kommunikation mit der nächsten KI- Generation prägen werden

1) Der Paradigmenwechsel: Vom reaktiven Chatbot zum erinnernden Partner

Stellen Sie sich vor, Sie betreten die Online-Filiale Ihrer Bank. Auf dem Bildschirm erscheint kein anonymer Chatbot, sondern ein digitaler Finanzberater, der Sie mit den Worten begrüßt: "Guten Tag, Herr Müller. Ich erinnere mich, dass wir im letzten Gespräch Ihre Sorgen wegen der Inflation diskutiert haben. Sie sagten, dass die Ausbildung Ihrer Tochter Lisa in fünf Jahren finanziert werden muss und dass Sie deshalb eher vorsichtig investieren möchten. Sollen wir unser Gespräch diesbezüglich wieder aufnehmen?"

Was auf den ersten Blick wie normaler Kundenservice wirkt, markiert in Wahrheit einen fundamentalen Paradigmenwechsel in der Entwicklung künstlicher Intelligenz. Dieser Satz zeigt, dass das System nicht bloß auf eine aktuelle Anfrage reagiert, sondern über etwas verfügt, was wir als echtes Gedächtnis bezeichnen können. Es erinnert sich an vergangene Gespräche, stellt Verbindungen zwischen verschiedenen Interaktionen her und schafft dadurch Kontinuität in der Beziehung zum Nutzer.

- Der Paradigmenwechsel: Vom reaktiven Chatbot zum erinnernden Partner

- Die Grenzen aktueller Systeme

- Die technischen Herausforderungen

- Kontrolle und Datenschutz

- Der Weg zu evolutionären Gedächtnislösungen

- Evolution als Entwicklungspartner: Millionen Jahre Forschung und Entwicklung

- Praktisches Beispiel: Der Banking Agent im Detail

- Technische Herausforderungen und biologisch inspirierte Lösungen

- Die Zukunft: Neuromorphe Hardware und emergente Gedächtnisstrategien

- Entwicklungsstufen für Multi-Agent-Memory-Systeme

- Fazit: Die biologische Blaupause für intelligente Systeme

1.1) Die Grenzen aktueller Systeme

Moderne Large Language Models wie GPT-5 oder Claude beeindrucken durch ihre Sprachfähigkeiten, doch ihr "Gedächtnis" ist stark eingeschränkt. Wenn Sie heute mit ChatGPT ein ausführliches Gespräch über Ihre beruflichen Ziele führen und morgen eine neue Unterhaltung beginnen, startet das System wieder bei null.

Diese Fragmentierung hat tiefgreifende Auswirkungen auf die Art der Beziehung, die zwischen einem Menschen und einer KI entstehen kann. Ohne Erinnerungsvermögen bleibt jeder Austausch oberflächlich und muss immer wieder von vorne beginnen. Echte Vertrauensbildung, das schrittweise Verstehen komplexer Bedürfnisse oder die Entwicklung personalisierter Lösungsansätze wird unter diesen Umständen praktisch unmöglich.

1.2) Der evolutionäre Vorteil des Gedächtnisses

Ein System mit echtem Gedächtnis hingegen kann aus jeder Interaktion lernen und dieses Wissen in zukünftige Gespräche einbringen. Es entwickelt ein immer vollständigeres Bild der Person, mit der es interagiert, versteht deren Präferenzen und kann proaktiv relevante Informationen anbieten. Aus der reaktiven Maschine wird ein agierender Partner, der nicht nur antwortet, sondern aktiv mitdenkt.

Dieses Prinzip bildet die Grundlage jeder intelligenten Interaktion in der realen Welt. Die Evolution hat über Millionen Jahre Gedächtnissysteme perfektioniert, die es Lebewesen ermöglichen, aus vergangenen Erfahrungen zu lernen. Bei höher entwickelten Lebewesen arbeitet das Gedächtnis selektiv, adaptiv und kontextabhängig – Eigenschaften, die wirklich intelligentes Verhalten erst ermöglichen.

2) Die technischen Herausforderungen

Der Sprung von aktuellen reaktiven Systemen zu echten gedächtnisfähigen Partnern erfordert nicht nur technische Verbesserungen, sondern eine grundlegend neue Herangehensweise an die Architektur künstlicher Intelligenz. Es geht darum, Systeme zu entwickeln, die nicht nur intelligent antworten, sondern sich auch intelligent "erinnern" können.

2.1) Kontextfenster als Flaschenhals: Die Token-Tyrannei

Das Kernproblem des Gedächtnisses moderner Sprachmodelle liegt in der Begrenzung des Kontextfensters – alles, was über diese Grenze hinausgeht, geht verloren. Für Multi-Agent-Systeme in Unternehmensanwendungen ist das eine erhebliche Limitierung. Sie benötigen eine persistente Gedächtnisarchitektur, die über einzelne Konversationen hinausgeht, zuverlässig skaliert und zugleich strenge regulatorische Anforderungen erfüllt.

2.2) Aktuelle Limits und ihre praktischen Auswirkungen

OpenAI GPT-5 Pro bietet in der API ein Kontextfenster von bis zu 400.000 Token (272k Input + 128k Output). Claude 3.5 Sonnet unterstützt 200.000 Token, Googles Gemini 1.5 Pro sogar bis zu 2 Mio. Token. In Chat-Frontends oder produktabhängigen Varianten liegen die effektiven Limits oft darunter, typischerweise im Bereich von 128.000 – 196.000 Token.

Für die Umrechnung gilt als Faustregel: 1 Token ≈ 0,75 Wörter (Englisch), bei Deutsch etwas weniger effizient (~1 Wort ≈ 1,8–2,0 Token). Damit entsprechen 128k Token etwa 60k–96k Wörtern (~200–350 Seiten) und 256k Token etwa 120k–192k Wörtern (~400–640 Seiten), jeweils bei ca. 300 Wörtern pro Seite. Die häufig zitierten Umfänge von 180k–200k Wörtern bei 128k Token sind also deutlich überschätzt.

Ein zusätzlicher Aspekt betrifft die neuen Reasoning-Modelle: Sie erzeugen interne Denk-Tokens (Chain of Thought), die nicht das Kontextfenster belegen, aber kostenpflichtig sind und die Antwortzeit verlängern. So kann eine scheinbar kompakte Antwort mit wenigen Tausend sichtbaren Token intern ein Vielfaches an Reasoning-Token verbrauchen. In Multi-Agent-Systemen verschärft sich dies weiter, da mehrere Agenten parallel arbeiten und ihre Kontexte synchronisieren.

2.3) Das technische Dilemma

Die Ursache liegt in der Architektur: Klassische Attention-Mechanismen skalieren quadratisch. Bei einem Kontextfenster von 400.000 Token entstehen über 160 Milliarden Berechnungen – eine Rechenlast, die selbst modernste GPU Cluster nur schwer bewältigen können. Verfahren wie Sparse Attention oder lokale Aufmerksamkeitsmuster verbessern zwar die Effizienz, aber das grundsätzliche Skalierungsproblem bleibt. Das Kontextfenster ist damit der Flaschenhals – und eine zentrale Barriere für ein wirklich langlebiges und persistentes Gedächtnis in KI-Systemen.

3) Kontrolle und Datenschutz

Noch gravierender als die Limitierung durch das Kontextfenster ist die sogenannte Session-Amnesie – also das bewusste Trennen einzelner Konversationen voneinander. Zwar speichern viele Anbieter Gesprächsverläufe und stellen diese zugänglich bereit, dennoch beginnt jede neue Sitzung stets mit einem leeren Kontext. Diese Architekturentscheidung ist keineswegs zufällig, sondern beruht auf mehreren Gründen.

3.1) Session-Amnesie: Das Vergessen zwischen den Gesprächen

Die strikte Trennung von Sitzungen ermöglicht eine bessere Kontrolle und Verwaltbarkeit der Daten. Nutzer können gezielt einzelne Konversationen löschen oder fortführen, ohne dass dies Auswirkungen auf andere Interaktionen hat. Auch die Einhaltung von Datenschutzbestimmungen wird dadurch erleichtert: Löschanfragen lassen sich präzise und nachvollziehbar umsetzen.

3.2) Ökonomische Überlegungen

Die Ökonomie spielt eine weitere Rolle. Aktuell kostet die Verarbeitung in großen Sprachmodellen zwischen 0,03 und 0,06 US-Dollar pro 1.000 Token – also umgerechnet ca. 0,028 bis 0,055 Euro. Eine kontinuierliche Einbeziehung aller vergangenen Konversationen würde nicht nur zusätzlichen Speicherplatz und Rechenkapazität beanspruchen, sondern auch erhebliche Abruf- und Verwaltungskosten verursachen.

3.3) Technische Risiken

Hinzu kommt ein technisches Risiko: Langlebige, konversationsübergreifende Speicher erhöhen die Gefahr fehlerhafter oder inkonsistenter "Erinnerungen". Ohne robuste Mechanismen zur Validierung und Korrektur könnten Modelle falsche Informationen langfristig festschreiben und so systematisch fehlerhaftes Wissen aufbauen.

Insgesamt führt dies dazu, dass aktuelle Systeme ihr Gedächtnis strikt auf die jeweilige Sitzung beschränken. Diese Entscheidung ist zwar ökonomisch wie regulatorisch nachvollziehbar, stellt für den praktischen Einsatz von Multi-Agent-Systemen jedoch eine der größten Hürden dar.

3.4) Retrieval-Augmented Generation: Ein erster Lösungsansatz

Als Antwort auf diese Limitierungen hat sich Retrieval-Augmented Generation (RAG) als pragmatischer Ansatz etabliert. Anstatt alle Informationen im Modell selbst zu speichern, greift RAG auf externe Wissensdatenbanken zu. Dies ermöglicht es, relevante Informationen bei Bedarf abzurufen und in den aktuellen Kontext einzuspeisen.

Dennoch bleibt RAG eine Krücke – es fehlen die nahtlose Integration von episodischen Erinnerungen und die Fähigkeit zur dynamischen Reorganisation von Wissen, wie sie in der Natur vorzufinden sind.

3.5) Die fehlende episodisch-semantische Trennung

Um die Bedeutung dieser Trennung zu verstehen, müssen wir zunächst die beiden Gedächtnistypen definieren:

- Episodisches Gedächtnis speichert konkrete Ereignisse mit ihrem zeitlichen und räumlichen Kontext ("Was ist wann und wo mit wem passiert?"), während

- semantisches Gedächtnis allgemeines Weltwissen und Konzepte umfasst ("Was ist die Hauptstadt von Frankreich?").

Moderne Large Language Models verarbeiten sämtliche Informationen nach demselben Prinzip – sie unterscheiden aber nicht zwischen diesen beiden fundamentalen Gedächtnistypen. Diese fehlende Trennung bringt erhebliche Probleme mit sich: Das Modell kann nicht zuverlässig differenzieren, ob eine Information aus dem laufenden Gespräch, aus den Trainingsdaten oder aus einer früheren Sitzung stammt.

Außerdem werden episodische Details wie persönliche Präferenzen oder einmalige Ereignisse mit der gleichen Priorität behandelt wie allgemeines Weltwissen. Das führt zu einer ineffizienten Ressourcennutzung, weil flüchtiges Wissen genauso viel "Speicherplatz" beansprucht wie dauerhaft relevantes.

Vor allem aber verhindert dieser Mangel an episodischem Gedächtnis den Aufbau echter Kontinuität: Ohne die Fähigkeit, Erfahrungen individuell und über Zeiträume hinweg zu verankern, bleiben Modelle in ihren Interaktionen oberflächlich, wodurch wirkliche Beziehungen zu Nutzern nicht entstehen können.

3.6) Auswirkungen auf Multi-Agent-Systeme

In Multi-Agent-Umgebungen verstärken sich diese Limitationen sogar exponentiell. Wenn mehrere Agenten zusammenarbeiten, treten zusätzliche Herausforderungen auf: Sie können sich nicht zuverlässig an gemeinsame Entscheidungen oder abgestimmte Arbeitsaufteilungen erinnern, was zu redundanten oder gar widersprüchlichen Aktionen führt. Jeder Agent entwickelt isolierte Kontexte, ohne von den Erfahrungen der anderen zu profitieren.

Der Versuch, Kontext zwischen Agenten zu synchronisieren, erzeugt zudem eine exponentiell wachsende Kommunikationslast, die rasch die Grenzen der verfügbaren Kontextfenster sprengt. Damit wird die Skalierbarkeit ausgerechnet dort eingeschränkt, wo Multi-Agent-Systeme ihren größten Nutzen entfalten sollen.

4) Der Weg zu evolutionären Gedächtnislösungen

Die genannten Limitationen sind keine unveränderlichen Naturgesetze, sondern das Resultat bewusster Architekturentscheidungen im Rahmen aktueller technischer und ökonomischer Bedingungen.

Interessanterweise finden wir ähnliche Hierarchien in der Computerarchitektur: Cache für ultraschnellen Zugriff, RAM für Arbeitsdaten und Festplatten für persistente Speicherung. Dieses etablierte Modell verdeutlicht, dass hierarchische Speicherstrukturen ein universelles Prinzip effizienter Informationsverarbeitung darstellen.

Die Natur hat jedoch über Millionen von Jahren hinweg noch elegantere Lösungen für genau diese Probleme entwickelt – von der selektiven Aufmerksamkeit über plastische Gedächtnisprozesse bis hin zur Arbeitsteilung im Modell der Complementary Learning Systems. Anstatt Gedächtnis als starres Zusatzmodul zu begreifen, zeigt die Biologie, wie dynamische, hierarchisch organisierte Speicherstrukturen Intelligenz überhaupt erst möglich machen.

Die folgende Betrachtung verdeutlicht, wie diese Prinzipien in technische Architekturen übertragen werden können und müssen, die nicht nur die Gedächtnislimitationen heutiger Large Language Models überwinden, sondern zugleich die besonderen Anforderungen moderner Multi-Agent-Systeme erfüllen.

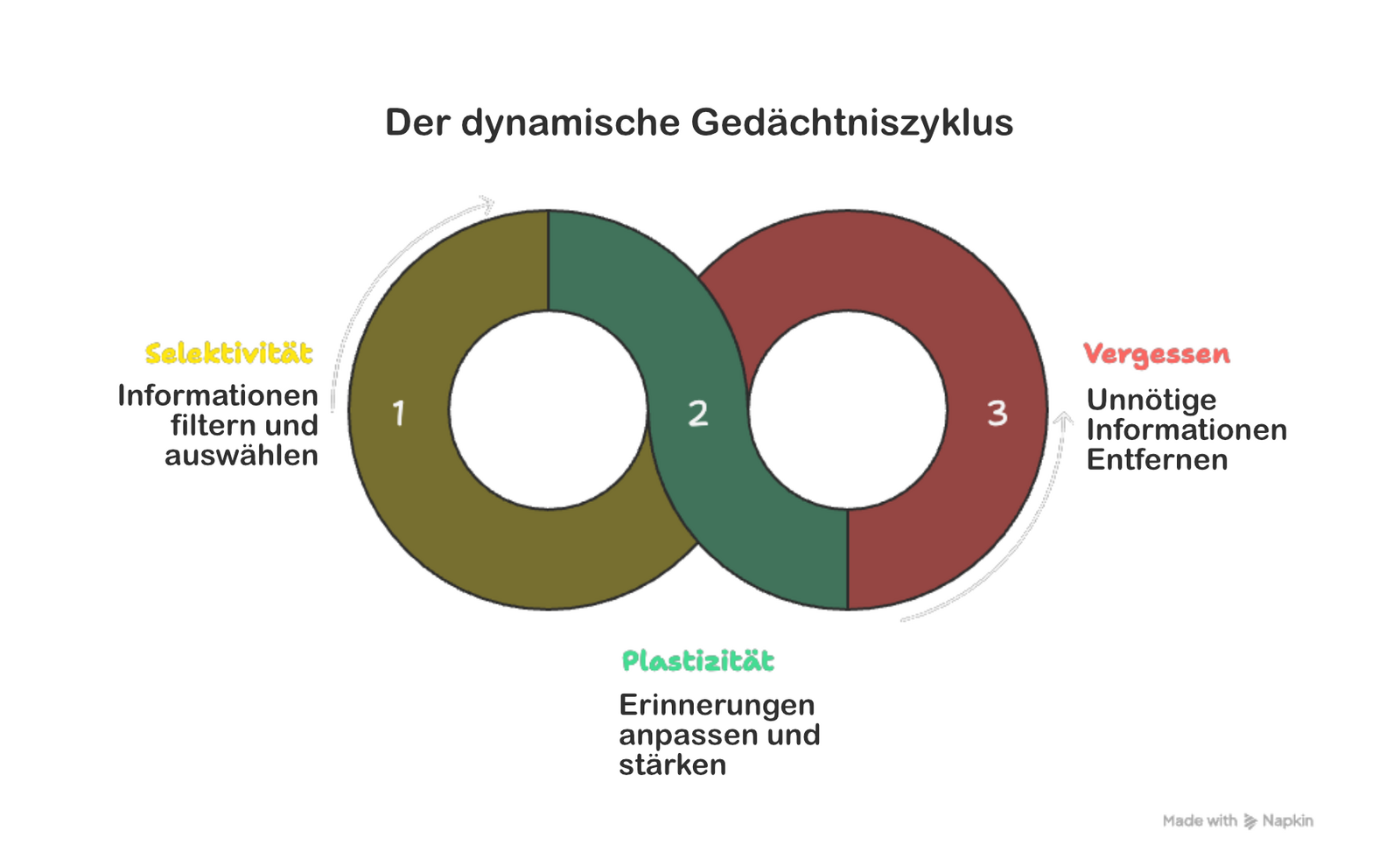

4.1) Gedächtnis als dynamischer Prozess: Die drei fundamentalen Prinzipien

Das Gedächtnis bildet die Grundlage jeder Form von Intelligenz. Es ist weder in der Biologie noch in der Technik ein bloßes Archiv, das Daten unverändert speichert, sondern ein dynamischer, gestaltender Prozess. Neurologische Fallstudien an Menschen ohne funktionierendes Erinnerungsvermögen zeigen eindrücklich: Ohne Gedächtnis bleibt das Individuum im Augenblick gefangen – fähig zu reagieren, aber unfähig zu planen, zu lernen, zu handeln oder sich weiterzuentwickeln.

Die kognitive Neurowissenschaft hat in den letzten Jahrzehnten gezeigt, dass Erinnerungen keine festen Dateien sind, die irgendwo im Gehirn lagern. Sie werden jedes Mal beim Abruf neu konstruiert, reorganisiert, verknüpft und bewertet.

Dabei stehen drei Prinzipien im Zentrum, die direkt in technische Architekturen übersetzt werden können:

4.2) Selektivität: Der kritische Filter

Selektivität bedeutet, dass nur ein winziger Bruchteil der permanent auf uns einströmenden Sinneseindrücke tatsächlich ins Bewusstsein gelangt und überhaupt eine Chance hat, gespeichert zu werden. Unser Gehirn verarbeitet etwa 11 Millionen Bits pro Sekunde an sensorischen Informationen, aber nur etwa 50 Bits schaffen es ins Bewusstsein. Diese massive Filterung verhindert, dass wir im Datenmeer untergehen.

Biologische Systeme haben dafür ausgeklügelte Mechanismen entwickelt: Der Thalamus fungiert als Torwächter, der entscheidet, welche sensorischen Informationen das Bewusstsein erreichen. Die Amygdala verstärkt emotional bedeutsame Ereignisse durch den "Negativity Bias" – einen evolutionären Vorteil, der bedrohliche Stimuli bevorzugt verarbeitet. Der präfrontale Kortex bewertet kontextuelle Relevanz durch episodische Bindung.

Für Multi-Agent-Systeme übersetzt sich dieses Prinzip in intelligente Filterarchitekturen:

https://github.com/Keiko-Evolutio/keiko-memoria-viva/tree/main/selective_memory_filtering

Diese Systeme müssen in Echtzeit entscheiden, welche Informationen gespeichert, welche verarbeitet und welche verworfen werden – eine Herausforderung, die mit steigender Datenmenge exponentiell wächst.

4.3) Plastizität: Die Kunst der Anpassung

Plastizität bedeutet, dass Erinnerungen veränderbar sind: Sie passen sich neuen Erfahrungen an, wachsen mit, verblassen oder verschmelzen. Diese Eigenschaft ermöglicht biologischen Systemen, aus Erfahrungen zu lernen und sich an veränderte Umgebungen anzupassen.

Die neurobiologischen Grundlagen der Plastizität wurden durch Donald Hebb in seinem berühmten Postulat formuliert: "Cells that fire together, wire together." Dieses Hebbian Learning manifestiert sich in zwei komplementären Prozessen: Langzeitpotenzierung (LTP) verstärkt häufig genutzte synaptische Verbindungen, während Langzeitdepression (LTD) ungenutzte Verbindungen schwächt – das "Use it or lose it"-Prinzip.

Diese Erkenntnisse haben direkten Einfluss auf die Entwicklung künstlicher neuronaler Netze. Die wiederholte Präsentation von Trainingsdaten während mehrerer Epochen entspricht der synaptischen Verstärkung durch wiederholte Aktivierung. Je öfter ein neuronales Netz bestimmte Muster sieht, desto stärker werden die entsprechenden Verbindungen – ein direktes technisches Analogon zur biologischen Plastizität.

In Multi-Agent-Systemen implementieren wir Plastizität durch adaptive Gedächtnisstrukturen, die sich kontinuierlich reorganisieren und dabei sowohl strukturelle Plastizität (neue Verbindungsbildung) als auch funktionale Plastizität (Gewichtsanpassung) umfassen:

https://github.com/Keiko-Evolutio/keiko-memoria-viva/tree/main/plastic_memory

4.4) Vergessen: Die unterschätzte Superkraft

Vergessen ist kein Mangel, sondern eine Voraussetzung für Handlungsfähigkeit, weil es Raum für Neues schafft und Überlastung verhindert. Hermann Ebbinghaus entdeckte in seinen bahnbrechenden Experimenten die mathematische Struktur des Vergessens: die exponentiell abfallende Vergessenskurve:

R = e^(-t/S)

Moderne Forschung erweiterte diese Erkenntnisse um den Spacing Effect – die Beobachtung, dass wiederholte Abrufe die Stabilität S exponentiell erhöhen. Das Gehirn behält bevorzugt Informationen, die statistisch wahrscheinlich wieder benötigt werden. Neue Erinnerungen verdrängen ähnliche alte durch retroaktive Interferenz – ein Mechanismus, der Redundanz reduziert und Speichereffizienz maximiert.

Für künstliche Systeme ist diese Einsicht entscheidend. Ein KI-Agent, der jedes Gespräch, jedes

Datenfragment und jede Zwischennotiz ohne Selektion ablegt, würde ein chaotisches, überfrachtetes System schaffen, das keine Prioritäten kennt und im entscheidenden Moment mit irrelevanten Details überlastet ist.

Die technische Implementierung adaptiven Vergessens folgt mehreren biologisch inspirierten Strategien: zeitbasiertes Decay, Relevanz-basierte Konsolidierung und interferenzgesteuertes Überschreiben.

https://github.com/Keiko-Evolutio/keiko-memoria-viva/tree/main/adaptive_forgetting

5) Evolution als Entwicklungspartner: Millionen Jahre Forschung und Entwicklung

Dass das Gedächtnis weit mehr ist als eine technische Herausforderung, zeigt der Blick in die Evolution.

Erinnern ist kein exklusiv menschliches Privileg, sondern das Ergebnis von Millionen Jahren natürlicher Selektion. Die Natur hat das Problem der Speicherung und des Abrufs von Information nicht einmal, sondern unzählige Male und auf ganz unterschiedlichen Komplexitätsstufen gelöst.

5.1) Von Bakterien zu Neuronen: Die molekulare Basis

Schon die einfachsten Lebensformen verfügen über elementare Formen von Erinnerung. Selbst Bakterien können sich an chemische Reize "erinnern" und ihr Verhalten entsprechend anpassen – sie bewegen sich in Richtung von Nahrungsquellen oder meiden toxische Substanzen. Ohne diese Fähigkeit könnten sie nicht überleben. Diese rudimentären Gedächtnisleistungen beruhen nicht auf Nervenzellen, sondern auf molekularen Mechanismen wie Proteinveränderungen, Signalwegen und Genregulation.

Die technische Entsprechung zeigt sich in Event-Processing-Systemen moderner Multi-Agent-Architekturen. So wie Bakterien auf chemische Gradienten reagieren, analysieren Event-Driven-Architekturen kontinuierliche Datenströme und passen ihr Verhalten dynamisch an erkannte Muster an.

Die biologische Persistenz von Zuständen über Proteinmodifikationen lässt sich dabei mit dem State Management verteilter Systeme vergleichen.

5.2) Der Sprung zu neuronalen Systemen: Aplysia als Vorbild

Mit der Entstehung einfacher Nervensysteme bei Tieren, wie Nesseltieren oder Würmern, entstanden erstmals spezialisierte Strukturen zur Verarbeitung und Speicherung von Erfahrungen. Besonders die Meeresschnecke Aplysia Californica wurde zu einem Schlüsselorganismus der modernen Neurowissenschaft. Eric Kandel konnte an ihr zeigen, dass wiederholte Reize synaptische Verbindungen dauerhaft verstärken – ein Mechanismus, der bis heute als Fundament des Lernens gilt.

Diese biologischen Erkenntnisse prägen direkt die Entwicklung künstlicher neuronaler Netze. Wie bei Aplysia führt auch in KI-Systemen die wiederholte Exposition gegenüber Trainingsmustern zur Verstärkung spezifischer Verbindungen. Backpropagation übernimmt dabei die Rolle der synaptischen Modulation: In beiden Fällen werden Verbindungsstärken auf Basis von Erfahrungen angepasst und optimiert – im biologischen Nervensystem chemisch, im künstlichen Netz mathematisch.

5.3) Der Hippocampus als Blaupause: Räumliche Navigation wird zu episodischem Gedächtnis

Mit dem Aufkommen des Wirbeltiergehirns entstanden hochkomplexe Gedächtnisarchitekturen. Eine Schlüsselrolle spielte dabei der Hippocampus, der sich zunächst als System zur räumlichen Orientierung entwickelte. Aus dieser Fähigkeit zur Navigation erwuchs ein Gedächtnissystem, das weit über die Ortskenntnis hinausgeht und bis heute eng mit episodischen Erinnerungen verknüpft ist.

Die Funktionsweise des Hippocampus beruht auf dem Zusammenspiel spezialisierter Regionen. John

O’Keefe entdeckte die sogenannten Place Cells, die spezifische Orte kodieren. Später identifizierten May-Britt und Edvard Moser im entorhinalen Kortex die Grid Cells, die in hexagonalen Mustern feuern und eine interne metrische Karte des Raums erzeugen – ein "inneres GPS". Für diese bahnbrechenden Entdeckungen erhielten sie 2014 gemeinsam den Nobelpreis für Physiologie oder Medizin.

Innerhalb des hippocampalen Schaltkreises übernimmt der entorhinale Kortex die Kodierung räumlich-zeitlicher Kontexte. Der Dentate Gyrus sorgt für eine klare Trennung ähnlicher Muster, während die Region CA3 als autoassoziatives Netzwerk für deren Vervollständigung fungiert. Schließlich integriert CA1 die verarbeiteten Informationen und leitet sie an den Kortex weiter. Auf diese Weise gelingt es dem Hippocampus, aus fragmentarischen Hinweisen vollständige episodische Erinnerungen zu rekonstruieren – ein Prinzip, das in modernen Retrieval-Systemen und assoziativen Speichern seine technische Entsprechung findet.

5.4) Complementary Learning Systems: Das Geheimnis stabilen Lernens

Die moderne Neurowissenschaft hat mit der Entdeckung der Langzeitpotenzierung gezeigt, dass sich Synapsen dauerhaft verändern, wenn sie wiederholt aktiviert werden. Noch entscheidender für das Verständnis des Gedächtnisses ist jedoch der Prozess der Konsolidierung. Neue Erinnerungen sind zunächst fragil und stark vom Hippocampus abhängig. Erst nach und nach werden sie in den Neokortex übertragen, wo sie langfristig verankert und stabilisiert werden.

Eine Schlüsselrolle spielt dabei der Schlaf. In dieser Phase laufen die Erlebnisse des Tages in beschleunigter Form erneut ab – ein sogenanntes "Replay", das wie eine interne Wiederholungsschleife wirkt und die dauerhafte Festigung des Gelernten ermöglicht. Auf diese Weise etabliert das Gehirn eine funktionale Arbeitsteilung: Der Hippocampus dient als schneller Speicher für flexible Anpassungen und kurzfristiges Lernen, während der Kortex als robustes Langzeitarchiv fungiert.

Die Theorie der Complementary Learning Systems (CLS) liefert damit ein zentrales Designprinzip für moderne Multi-Agent-Memory-Systeme. Indem schnelle, flexible Lernprozesse mit langsamen, stabilen Speichermechanismen kombiniert werden, entsteht ein Gleichgewicht zwischen Adaptivität und Konsistenz – eine Voraussetzung für zuverlässige und zugleich anpassungsfähige Intelligenz.

5.5) Multi-Agent Memory Mesh: Verteilte Intelligenz durch geteiltes Gedächtnis

In Multi-Agent-Systemen erweitert sich die Herausforderung erheblich. Es reicht nicht aus, dass jeder einzelne Agent über ein funktionierendes Gedächtnis verfügt – entscheidend ist die Fähigkeit, Erinnerungen im Verbund zu koordinieren, Wissen zu teilen, Informationen zu synchronisieren und dabei zugleich Konsistenz zu wahren.

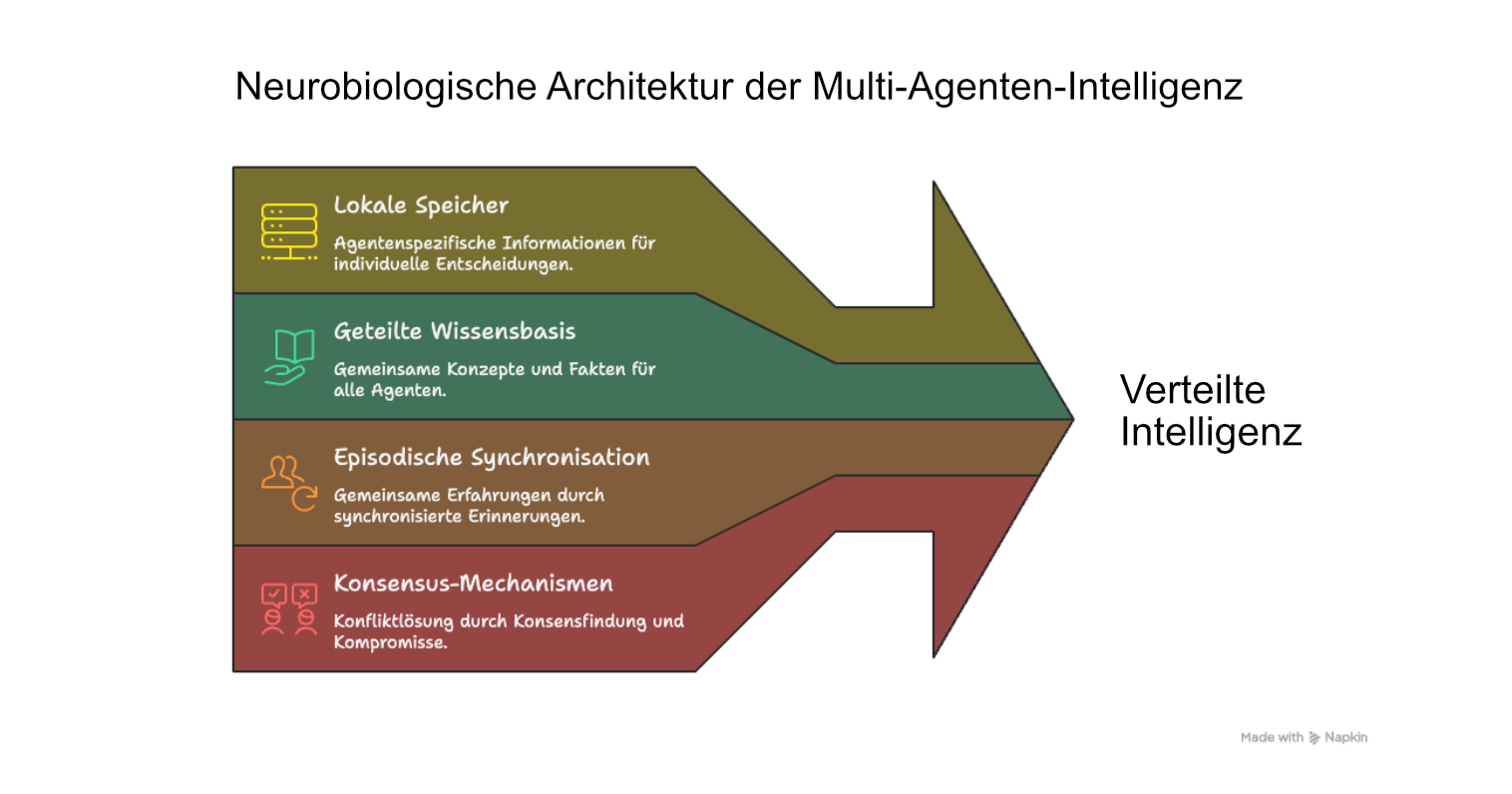

Die Architektur eines Memory Mesh für Multi-Agent-Systeme orientiert sich an neurobiologischen Prinzipien verteilter Verarbeitung. Lokale Speicher halten agentenspezifische Informationen bereit, während eine gemeinsame Wissensbasis übergreifende Konzepte und Fakten verankert. Episodische Synchronisationsprozesse erlauben es, Erfahrungen zwischen Agenten abzugleichen, und Konsensus-Mechanismen sorgen dafür, dass widersprüchliche Informationen in ein konsistentes Gesamtbild überführt werden. Auf diese Weise entsteht ein dynamisches Netzwerk kollektiver Erinnerung, das individuelle Stärken bewahrt und zugleich die kollektive Intelligenz des Systems trägt.

6) Praktisches Beispiel: Der Banking Agent im Detail

Betrachten wir erneut unseren Kunden Herrn Müller und seinen digitalen Finanzberater. In der ersten Beratungssitzung erfasst der Agent nicht nur Zahlen und Fakten, sondern baut ein reichhaltiges Profil auf: Herr Müller, 42 Jahre alt, verheiratet, eine Tochter (Lisa, 13 Jahre), arbeitet als Projektleiter in der Automobilindustrie. Seine größte Sorge: die Finanzierung von Lisas Studium bei gleichzeitiger Inflationsangst.

Diese Informationen werden zunächst im Arbeitsgedächtnis des Agenten abgelegt – gemeinsam mit den Zahlen, Fakten und Kontextdaten, die während des Gesprächs verarbeitet werden. Nach dem Gespräch beginnt der Konsolidierungsprozess: Wichtige Fakten wie Familiensituation und finanzielle Ziele wandern ins Langzeitgedächtnis, während Gesprächsdetails ("Herr Müller erwähnte nebenbei seinen Urlaub") nach Relevanz gefiltert werden.

Beim nächsten Kontakt, drei Wochen später, kann der Agent nicht nur die Fakten abrufen, sondern auch den emotionalen Kontext rekonstruieren:

Herr Müller, ich habe über Ihre Situation nachgedacht. Angesichts Ihrer Bedenken bezüglich der Inflation und des Zeithorizonts bis zu Lisas Studium habe ich einen Vorschlag für eine ausgewogene Anlagestrategie vorbereitet. Darf ich sie Ihnen vorstellen?

Die beispielhafte Implementierung eines solchen Banking-Agenten zeigt, wie biologische Prinzipien in produktive Systeme übersetzt werden können:

https://github.com/Keiko-Evolutio/keiko-memoriaviva/tree/main/banking_agent_detailed_example

7) Technische Herausforderungen und biologisch inspirierte Lösungen

7.1) Katastrophales Vergessen verhindern

Katastrophales Vergessen – die Gefahr, dass neu erworbenes Wissen zuvor Gelerntes vollständig überschreibt – ist ein zentrales Problem neuronaler Netze. In biologischen Systemen wird dieses Risiko durch die Arbeitsteilung zwischen Hippocampus und Kortex abgefedert.

In technischen Systemen begegnet man diesem Phänomen mit verschiedenen Strategien:

- Replay-Mechanismen: Ähnlich wie das Gehirn im Schlaf Erfahrungen wiederholt, speisen Experience Replay Buffer in Reinforcement-Learning-Systemen alte Erfahrungen periodisch wieder ein. Dies verhindert, dass neue Erfahrungen alte vollständig überschreiben.

- Elastic Weight Consolidation (EWC): Diese Technik identifiziert wichtige Parameter für bereits gelernte Aufgaben und "schützt" sie vor zu starken Veränderungen – ähnlich wie synaptische Konsolidierung im Gehirn.

- Hybride Architekturen: Die Kombination von parametrischen Modellen (neuronalen Netzen) mit nicht-parametrischen Speichern (Vektordatenbanken) ermöglicht es, flexibles Lernen mit stabilem Wissen zu verbinden. Das parametrische Modell lernt Muster und Abstraktionen, während der externe Speicher konkrete Fakten und Episoden bewahrt.

Auf diese Weise wird versucht, die Balance zwischen Anpassungsfähigkeit und Gedächtnisstabilität auch in künstlichen Architekturen zu gewährleisten.

7.2) Skalierung auf Millionen von Agenten

Die Übertragung biologisch inspirierter Gedächtnissysteme auf Unternehmensebene erfordert besonders sorgfältige Architekturentscheidungen. Das menschliche Gehirn demonstriert hierfür seit

Millionen Jahren eine hocheffiziente Lösung: Es organisiert sich in sogenannten Small-World-Netzwerken, die eine optimale Balance aus lokaler Spezialisierung und globaler Vernetzung schaffen.

Für technische Systeme bedeutet dies:

- hierarchische Organisation mit lokalen Clustern und globalen Hubs

- asynchrone Kommunikation zur Vermeidung von Bottlenecks

- Eventual Consistency statt strikter Synchronisation

- föderierte Lernansätze für verteiltes Training

7.3) Governance und Compliance im Banking-Kontext

Kehren wir zu Herrn Müller zurück. Sein digitaler Finanzberater muss nicht nur intelligent, sondern auch compliant sein. Jede gespeicherte Information über Herrn Müller unterliegt der DSGVO.

Der Agent muss:

- Transparenz gewährleisten: Herr Müller kann jederzeit einsehen, welche Daten gespeichert sind.

- Löschrechte umsetzen: Auf Wunsch müssen alle persönlichen Daten entfernt werden können.

- Zweckbindung einhalten: Daten dürfen nur für vereinbarte Zwecke verwendet werden.

- Audit-Trails führen: Jede Beratung muss nachvollziehbar dokumentiert sein.

Im Finanzsektor kommen zusätzliche Regularien hinzu: MiFID II verlangt die Dokumentation von Geeignetheitsprüfungen, das Wertpapierhandelsgesetz (WpHG) fordert Aufzeichnungen über Anlageberatungen und Basel III/CRD IV setzen strenge Anforderungen an Risikobewertungen.

Der Agent muss also nicht nur "sich erinnern", sondern auch "vergessen können" – und zwar selektiv, nachvollziehbar und rechtskonform.

8) Die Zukunft: Neuromorphe Hardware und emergente Gedächtnisstrategien

8.1) Neuromorphe Computing-Architekturen

Die kommende Generation von Hardware überträgt neuronale Prinzipien direkt in Silizium. Neuromorphe Chips wie Intels Loihi 2 oder IBMs TrueNorth orientieren sich an der Funktionsweise biologischer Nervenzellen. Statt Informationen seriell zu verarbeiten, arbeiten sie ereignisbasiert und massiv parallel – so wie das Gehirn.

Memristor-Technologien ermöglichen dabei die direkte physische Nachbildung synaptischer Plastizität. Diese Bauelemente "erinnern" sich an den durch sie geflossenen Strom und verändern entsprechend ihren Widerstand – eine perfekte technische Analogie zur synaptischen Verstärkung. Damit wird der klassische Unterschied zwischen "Speicher" und "Verarbeitung" aufgehoben: Rechnen und Erinnern verschmelzen zu einer Einheit.

8.2) Evolutionäre Gedächtnisarchitekturen

Evolutionäre Gedächtnisarchitekturen eröffnen eine völlig neue Perspektive auf den Entwurf intelligenter Systeme. Basierend auf evolutionären Prinzipien könnten künftige Systeme ihre Gedächtnisstrategien selbst entwickeln.

Die Grundprinzipien der Evolution werden dabei technisch umgesetzt:

- Variation: Verschiedene Gedächtnisstrategien werden parallel erprobt.

- Selektion: Erfolgreiche Strategien setzen sich durch.

- Vererbung: Bewährte Mechanismen werden an neue Agenten weitergegeben.

- Adaptation: kontinuierliche Anpassung an veränderte Anforderungen

Dabei nutzen moderne Systeme verschiedene Selektionsmechanismen:

- Turnier-Selektion: Mehrere Strategien treten im direkten Vergleich an, der Gewinner wird bevorzugt.

- Roulette-Wheel-Selektion: Die Wahrscheinlichkeit der Auswahl ist proportional zur Fitness.

Der entscheidende Punkt: Nicht ein zentraler Architekt entwirft das optimale Gedächtnissystem, sondern es entsteht durch evolutionären Druck aus der Interaktion mit der Umgebung. Agenten mit besseren Gedächtnisstrategien sind erfolgreicher und geben ihre "Gene" – in Form von Architekturparametern und Lernstrategien – an die nächste Generation weiter.

9) Entwicklungsstufen für Multi-Agent-Memory-Systeme

Für Unternehmen, die Gedächtnisfunktionen in Multi-Agent-Systeme integrieren möchten, ergeben sich verschiedene Entwicklungsstufen:

Stufe 1: Basis-Gedächtnis

Charakteristika: Einfache Session-Persistenz, grundlegende Kontextverwaltung

Technologien:

- Conversation Summary Buffers (LangChain, LlamaIndex)

- Redis-basierte Session-Speicher

- einfache RAG-Implementierungen

Anwendungsfall bei Herrn Müller: Der Agent erinnert sich während einer Beratungssitzung an alle besprochenen Themen und kann innerhalb des Gesprächs darauf zurückgreifen.

Stufe 2: Episodisches Gedächtnis

Charakteristika: Langfristige Speicherung individueller Interaktionen, Personalisierung

Technologien:

- Vektordatenbanken (Pinecone, Weaviate, Qdrant)

- Embedding-basierte Ähnlichkeitssuche

- Experience-Replay-Mechanismen

Anwendungsfall bei Herrn Müller: Der Agent erinnert sich über Monate hinweg an vergangene Gespräche und kann Herrn Müllers Anlagepräferenzen über lange Zeit nachvollziehen.

Stufe 3: Semantische Integration

Charakteristika: Wissenskonsolidierung, Mustererkennung, Cross Customer Insights

Technologien:

- Knowledge Graphs (Neo4j, Amazon Neptune)

- automatisierte Ontologie-Extraktion

- föderiertes Lernen

Anwendungsfall bei Herrn Müller: Der Agent erkennt, dass Kunden mit ähnlichem Profil wie Herr Müller oft von bestimmten Anlagestrategien profitieren und kann proaktiv Vorschläge machen.

Stufe 4: Multi-Agent-Orchestrierung

Charakteristika: Verteilte Memory-Systeme, Teamarbeit zwischen Agenten

Technologien:

- Distributed Memory Meshes

- Consensus-Algorithmen (Raft, Paxos)

- Event-Sourcing-Architekturen

Anwendungsfall bei Herrn Müller: Ein Spezialist-Agent für Steueroptimierung arbeitet mit dem Anlageberater-Agent zusammen, beide greifen auf gemeinsame Erinnerungen zu und koordinieren ihre Empfehlungen.

Stufe 5: Autonome Evolution

Charakteristika: Selbstoptimierende Gedächtnisstrategien, emergente Architekturen

Technologien:

- genetische Algorithmen für Architekturoptimierung

- Meta-Learning-Frameworks

- neuromorphe Hardware

Anwendungsfall bei Herrn Müller: Das System entwickelt selbstständig optimale Strategien, um relevante Informationen über Kunden wie Herrn Müller zu speichern, zu vergessen und abzurufen – angepasst an regulatorische Anforderungen und Geschäftsziele.

10) Fazit: Die biologische Blaupause für intelligente Systeme

Die Biologie liefert nicht bloß inspirierende Metaphern, sondern konkrete Konstruktionsprinzipien für Memory-Systeme in der Künstlichen Intelligenz. Das Modell der Complementary Learning Systems zeigt, wie schnelles episodisches und langsames semantisches Lernen zusammenwirken. Mechanismen wie Mustertrennung gewährleisten den zuverlässigen Abruf, während Konsolidierung für die asynchrone Pflege und Verdichtung von Wissen sorgt.

Multi-Agent-Systeme mit Gedächtnis werden nicht nur auf Anfragen reagieren, sondern kontinuierlich Erfahrungen integrieren, Kontexte bewahren und vertrauensvolle Beziehungen aufbauen. Für Herrn Müller bedeutet das: Sein digitaler Finanzberater wird zu einem verlässlichen Partner, der seine Geschichte kennt, seine Ziele versteht und ihm hilft, Lisas Ausbildung zu finanzieren – trotz Inflation und Marktunsicherheiten.

Die technische Umsetzung dieser biologischen Prinzipien – von molekularer Habituation über hippocampale Episodenspeicherung bis zur kortikalen Konsolidierung – ermöglicht Systeme, die nicht nur reagieren, sondern erinnern, lernen und antizipieren. In hochregulierten Umgebungen wie dem Finanzsektor wird genau dies über Vertrauen, Effizienz und Wettbewerbsfähigkeit entscheiden.

Die zentrale Herausforderung für Entwickler und Architekten besteht darin, die richtige Balance zwischen biologischer Inspiration und technischer Machbarkeit zu finden. Nicht jedes Prinzip lässt sich eins zu eins übertragen, doch das Verständnis evolutionär bewährter Lösungen liefert eine unschätzbare Roadmap für die Entwicklung robuster, skalierbarer und vertrauenswürdiger agentenbasierter KI-Systeme.

Die Zukunft gehört Multi-Agent-Systemen, die wie biologische Organismen aus Erfahrungen lernen, sich flexibel an neue Situationen anpassen und dabei ihre eigene Geschichte nicht vergessen, sondern intelligent nutzen. Die Evolution hat den Bauplan geliefert – nun liegt es an uns, ihn in Code zu übersetzen.