KI in Software integrieren – Umsetzung und Herausforderungen

Künstliche Intelligenz (KI) hält Einzug in alle Arten von Applikationen. Die Integration verspricht viele Vorteile: Prozesse lassen sich automatisieren, Benutzer erhalten intelligentere Unterstützung, und neue Funktionen werden möglich. Der Weg zur KI-gestützten Anwendung ist jedoch komplex.

77 % der technischen Führungskräfte betrachten die Einbindung von KI in Anwendungen als Herausforderung [1]. Dem stehen technische Hürden bei der Umsetzung gegenüber. Ein zentrales Kennzeichen moderner KI-Systeme ist die Nutzung von Cloud-basierten Diensten über Web APIs. Anbieter wie OpenAI, Google (Gemini), Anthropic (Claude) stellen leistungsfähige Modelle bereit, die per REST Service ansprechbar sind. Prinzipiell folgt die Interaktion mit solchen Large Language Models (LLMs) dem Muster: Man sendet einen Eingabetext (Prompt) an den Dienst und erhält vom Modell einen generierten Antworttext (Completion). Dieser Ablauf täuscht jedoch über die Umsetzung hinweg. Entwickler müssen sich mit unterschiedlichen API-Spezifikationen, Authentifizierungsverfahren, Datenformaten und Modellparametern der KI-Anbieter auseinandersetzen. Zudem gilt es, anwendungsspezifische Daten in die KI-Abfragen einzubinden, Ergebnisse aufzubereiten und die Kontrolle zu behalten, was die KI tun darf und was nicht.

Anwendungsfälle

KI-gestützte Funktionen können die Möglichkeiten von Software erheblich erweitern:

- Intelligentere Assistenzfunktionen: Chatbots können in Apps integriert werden, um Nutzeranfragen in natürlicher Sprache zu beantworten oder durch komplexe Prozesse zu führen.

- Bildverarbeitung und Objekterkennung: In vielen Branchen ist die Verarbeitung von Bildern/Videos gefragt.

- Personalisierung und Prognosen: Durch Machine-Learning-Modelle (ML) können Anwendungen Nutzerverhalten vorhersagen und personalisierte Empfehlungen geben.

Entscheidend ist jedoch, dass die KI-Funktion reibungslos mit der Anwendung zusammenarbeitet, d.h., die KI darf nicht "danebenstehen", sondern muss in den Workflow und die Benutzeroberfläche eingebettet sein.

Technologische Herausforderungen

Die Einbindung von KI in Applikationen bringt technische Herausforderungen mit sich:

- Datenhandling und Kontext: Anwendungen verfügen über vielfältige Daten, die für KI-Funktionen relevant sind. Die Herausforderung besteht darin, nur die relevanten Informationen in geeigneter Form bereitzustellen, da das Eingabefenster eines Modells begrenzt ist. Zu viel Kontext erhöht die Kosten und kann die Qualität verschlechtern, zu wenig liefert unbrauchbare Ergebnisse. Häufig sind Vorverarbeitungsschritte nötig, z.B. Konvertierung, Bereinigung und Übersetzung. Auch die Weiterverarbeitung der Ausgabe spielt eine Rolle, d.h., wenn Ergebnisse strukturiert gespeichert oder validiert werden müssen.

- API-Komplexität und Provider-Vielfalt: Man hat die Wahl zwischen zahlreichen Cloud-Anbietern und Modellen. Jeder Dienst erfordert eigene APIs, Parameter und Authentifizierungsmethoden. Die Softwarearchitektur muss flexibel sein, um einen Wechsel des KI-Anbieters oder den Einsatz eines spezialisierten Modells, z.B. für Bild- oder Spracherkennung, zu ermöglichen, ohne dass große Teile der Anwendung geändert werden müssen.

- Kontextsteuerung und Geschäftslogik: Anwendungen benötigen gezielte, kontrollierte KI-Aktionen statt unvorhersehbarer Antworten. Daher muss der Handlungsspielraum der KI eingeschränkt werden. LLMs erzeugen Text, die Software benötigt jedoch ein vorhersehbares Verhalten. Techniken wie Prompt Engineering (Systemnachrichten, Rollen, Beispiele) helfen. Die Herausforderung besteht jedoch darin, KI-Ausgaben zuverlässig in die Anwendungslogik einzubinden. Ideal ist, wenn die KI definierte Funktionen der Software aufrufen kann, statt nur Hinweise zu geben. Dafür braucht es Schnittstellen zwischen KI und Programmfunktionen; moderne KI-APIs mit Function Calling unterstützen das, müssen aber implementiert und gemanagt werden.

- Sicherheit und Datenschutz: Häufig müssen vertrauliche Informationen an Cloud-Dienste gesendet werden, was datenschutzrechtliche Anforderungen mit sich bringt. Entwickler müssen daher Daten ggf. anonymisieren oder filtern. Zudem sind Zugriffsrechte und API-Kontingente zu steuern, um Missbrauch und Überlastung zu vermeiden. KI-Anfragen verursachen Kosten und Latenzen, weshalb Anwendungen nicht blockieren dürfen und mit Verzögerungen oder Ausfällen externer Dienste ist umzugehen.

Lösungsansätze

In der Praxis haben sich mehrere Strategien etabliert:

- Datenvorbereitung und -reduzierung: Um relevante Informationen zum KI-Modell zu bringen, werden Techniken wie Retrieval Augmented Generation (RAG) eingesetzt. Dabei durchsucht die Anwendung vor einer KI-Anfrage die Datenquellen nach den passendsten Inhalten und reicht nur diese als Kontext an das Modell weiter. Eine Datenpipeline – von den Rohdaten über Konvertierungen bis hin zur Prompt-Erstellung – ist entscheidend. Ebenso wichtig ist es, die KI-Antwort kontrolliert zurückzuführen: So können z.B. generierte Texte vor der Weiterverarbeitung in strukturierte Daten umgewandelt oder mittels Geschäftsregeln validiert werden.

- Abstraktionsschichten für KI-Provider: Anstatt jede KI-API separat anzusteuern, empfiehlt sich der Einsatz einer Abstraktionsschicht. Bibliotheken fungieren als Unified API, die die Unterschiede der Anbieter verdeckt. Entwickler definieren ihr Anliegen einmal und die Bibliothek übernimmt die Details. Ob der Aufruf an einen Cloud-Dienst oder ein lokales Modell erfolgt, ist für den Anwendungscode nachrangig. Eine solche Kapselung erleichtert auch zukünftige Änderungen, d.h., möchte man einen neuen KI-Service nutzen, passt man nur die Konfiguration an, nicht jedoch die Business-Logik der Anwendung.

- Function Calling und Tool-Einbindung: Die Anwendung registriert Funktionen oder Tools, die das KI-Modell aufrufen darf. Die KI liefert in ihrem Antwortformat dann nicht bloß Text, sondern kann auch den Befehl zurückgeben, eine dieser Funktionen mit Parametern auszuführen. Die Anwendung führt den angeforderten Funktionsaufruf aus und reicht der KI gegebenenfalls das Ergebnis zurück. Auf diese Weise entstehen mehrstufige Dialoge, in denen die KI erkennt, dass sie z.B. zunächst eine Datenbankabfrage durchführen muss, diese via Function Call initiiert und anschließend mit den echten Daten antwortet. Dieses Konzept verbindet das KI-Modell eng mit der bestehenden Geschäftslogik und verhindert Halluzinationen, da die KI nur vordefinierte Funktionen nutzen kann und nichts "erfinden" muss. Gleichzeitig erhöht es die Zuverlässigkeit der Ergebnisse.

- Architektur: Eine grundlegende Designentscheidung ist, ob die KI-Integration direkt im Client erfolgt oder ob man einen zentralen KI-Service im Backend aufsetzt. Ein zentraler Dienst, z.B. in Form eines Model Context Protocol (MCP)-Servers, bringt Vorteile: Alle KI-Anfragen laufen über diesen Server, der die Modelle verwaltet, Kontexte zentral vorhält und von verschiedenen Anwendungen genutzt werden kann. Über ein einheitliches Protokoll lassen sich KI-Funktionen als definierte Services kapseln, die versioniert, erweiterbar und selbstbeschreibend sind. So kann ein MCP-Server Metadaten zu verfügbaren KI-Tools bereitstellen, neue Funktionen aufnehmen, ohne bestehende Clients zu beeinträchtigen.

Beispiel: KI-Integration mit TMS AI Studio

TMS AI Studio besteht aus mehreren Bausteinen, die zusammen ein KI-Framework für Delphi/C++Builder-Anwendungen bilden:

- Die Integration von LLM-Diensten (AI Provider) über eine vereinheitlichte API

- Darauf aufbauende Komponenten (Tabelle 1) für KI-Funktionen wie Function Calling und MCP für Tool-Integrationen

Komponente | Typ / Rolle | Beschreibung |

TTMSMCPServer | Server-Komponente | stellt Funktionen und Dienste bereit, auf die Clients zugreifen können |

TTMSMCPClient | Client-Komponente | clientseitige Zugriffsklasse zum Verbinden mit einem MCP-Server |

TTMSMCPCloudAI | Cloud-Service-Abstraktion | zentrale Zugriffsschicht auf Cloud-basierte KI-Dienste, z.B. LLMs; kapselt Authentifizierung, Requests und Antwortverarbeitung |

TTMSMCPCloudAIToolSet | Tool-Sammlung | Sammlung von KI-Werkzeugen, die von Cloud-AI-Modellen verwendet oder aufgerufen werden können |

TTMSMCPCloudAIFileSystem | Cloud-Service | Abstraktion für Datei-Operationen im Kontext von Cloud AI, z.B. Upload/Download von Prompt- oder Ergebnisdateien |

TTMSMCPCloudAIDataSet | Datenverwaltung | verwaltet strukturierte Daten, die von Cloud-AI-Modellen genutzt oder erzeugt werden können |

Tabelle 1: Wichtige Komponenten für die Integration von KI in die App.

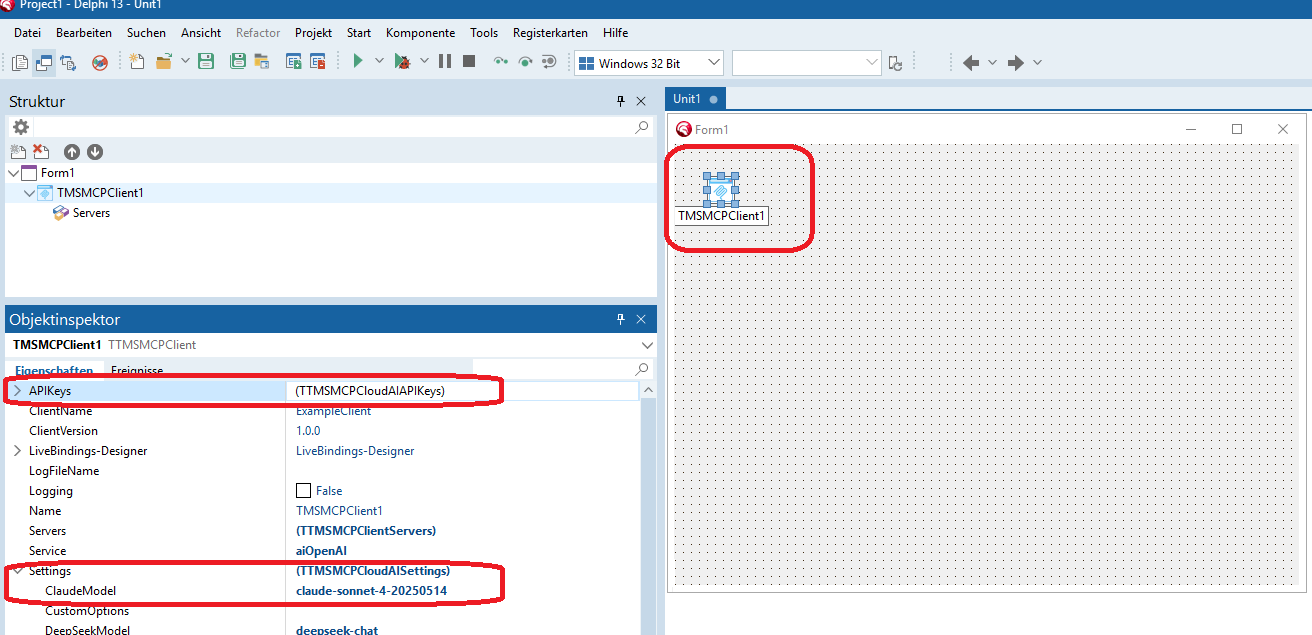

TMS AI Studio verfolgt das Prinzip, KI-Dienste austauschbar anzubinden. Anwendungen kommunizieren mit KI-Services über Schnittstellen, was Kompatibilität und Zukunftssicherheit gewährleistet. Durch den RAD-Ansatz (Rapid Application Development) bietet sich für Entwickler ein hoher Komfort. Die Komponenten werden in der integrierten Entwicklungsumgebung auf das Formular gezogen und können dort einfach konfiguriert werden (Bild 1).

Dabei ist zu beachten, dass alle TMS AI Studio-Komponenten plattformübergreifend sind und sowohl in VLC-Windows-Anwendungen als auch in plattformübergreifenden FMX-Anwendungen für Windows, macOS, iOS, Android und Linux verwendet werden können. Die MCP-Server können beispielsweise unter Linux eingesetzt werden. Das eröffnet einen flexiblen Einsatz.

LLM-Integration

Das Fundament bildet die Komponente TTMSMCPClient. Diese Komponente abstrahiert die Verbindung zu verschiedenen KI-Anbietern und stellt eine identische API zur Verfügung. Unterstützt werden alle gängigen Dienste, u.a. OpenAI, Google Gemini, Anthropic Claude, Perplexity AI, Mistral AI, Grok and DeepSeek sowie Ollama für lokale Modelle. Gerade die Möglichkeit, ein lokales KI-Modell zu nutzen, wird oft als wertvoll eingestuft, weil man dadurch von netzbasierten und durch Drittanbieter bereitgestellten KI-Services unabhängig ist. Man arbeitet stets mit der Komponente und konfiguriert lediglich den gewünschten Service, d.h., die Unterschiede der einzelnen Provider (API-URL, Authentifizierung, JSON-Struktur der Anfragen/Antworten etc.) werden vom Toolkit gehandhabt. Entwickler setzen Parameter wie Modellauswahl, API-Schlüssel und Eingabetext (Prompt) und führen dann die Anfrage aus. Ein typischer Ablauf sieht so aus:

- Zuerst wählt man den Dienst und das Modell, z.B. aiOpenAI mit Modell GPT-4.

- Dann wird der Prompt-Text gesetzt und schließlich die Anfrage via Execute an den Dienst geschickt.

- Die Antwort des Modells (Completion) wird von der Komponente empfangen und als Text bereitgestellt.

// Beispiel: OpenAI GPT-4 in Delphi aufrufen

TMSMCPCloudAI1.Service := aiOpenAI;

TMSMCPCloudAI1.APIKeys.OpenAI := '<Ihr OpenAI API-Key>'; // API-Schlüssel einfügen

TMSMCPCloudAI1.Settings.OpenAIModel := 'gpt-4'; // Modellwahl (z.B. GPT-4)

TMSMCPCloudAI1.SystemRole.Text := 'Du bist ein IT-Experte.'; // optionale Systemrolle

TMSMCPCloudAI1.Context.Text := 'Wie kann ich KI in meiner Delphi-App nutzen?';

TMSMCPCloudAI1.Execute;

// Ergebnis kommt asynchron im Ereignis-Handler OnExecute zurück und kann verarbeitet werden.TTMSMCPCloudAI führt Anfragen in der Regel nicht blockierend aus, d.h., das Ergebnis kommt im OnExecute-Ereignis oder via Callback zurück, sodass die Anwendung währenddessen weiter bedienbar bleibt. Das Austauschen des Modells ist leicht: Möchte man z.B. statt OpenAI einmal Anthropic Claude testen, ändert man Service := aiClaude, setzt den API Key und wählt eines der unterstützten Claude-Modelle. Alles andere bleibt im Code identisch.

Function Calling

Neben der Frage-Antwort-Interaktion mit LLMs ermöglicht TMS AI Studio auch die Anbindung eigener Programmfunktionen an die KI. Das KI-Modell kann während der Verarbeitung erkennen, dass es für eine Anfrage auf externe Informationen oder Aktionen angewiesen ist und definierte Tools ansteuern. TMS AI Studio macht die Einbindung solcher Tools sehr einfach. In der TTMSMCPCloudAI-Komponente gibt es eine Tools Collection, in der man Tools mit Namen, Beschreibung und Parameterdefinition registrieren kann.

Das folgende Listing illustriert dies an einem Beispiel. Es wird ein Tool getweather mit einem Parameter city angelegt. Die Idee ist, dass die KI damit das Wetter für eine angegebene Stadt abfragen kann.

// Beispiel: Eigenes Tool "getweather" mit Parameter definieren

var

tool: TTMSMCPCloudAITool;

param: TTMSMCPCloudAIParameter;

begin

tool := TMSMCPCloudAI1.Tools.Add;

tool.Name := 'getweather';

tool.Description := 'Gibt das aktuelle Wetter für eine Stadt zurück';

param := tool.Parameters.Add;

param.Name := 'city';

param.Description := 'Name der Stadt';

param.&Type := ptString; // Parameter-Typ (String)

param.Required := True; // Parameter ist erforderlich

end;

Die obige Registrierung eines Tools teilt dem KI-Modell mit, dass es eine Funktion getweather(city: string) gibt. Wenn beispielsweise eine Benutzeranfrage wie "Brauche ich morgen in Berlin einen Regenschirm?" eingeht, könnte das LLM beschließen, das getweather-Tool aufzurufen, um aktuelle Wetterdaten für Berlin zu holen, anstatt eine wahrscheinlich ungenaue Antwort aus seinem Textwissen zu raten. TMS AI Studio fängt diesen Aufruf intern ab und gibt dem Entwickler die Kontrolle: Es wird ein Ereignis OnExecuteTool ausgelöst, in dem die gewünschten Parameter übergeben werden. In unserem Beispiel erhielte man den String "Berlin" als Parameter und könnte daraufhin eine Wetter-API ansprechen. Nachfolgend ein vereinfachter Ausschnitt, wie die Ausführung in Delphi aussehen kann:

// Beispiel: Ausführung des Tools in OnExecuteTool-Ereignis

procedure TForm1.AIStudioExecuteTool(Sender: TObject; Args: TJSONObject; var Result: string);

var

city: string;

begin

city := Args.GetValue<string>('city');

// Eigene Wetter-API aufrufen (Pseudo-Code):

Result := HoleAktuellesWetter(city);

end;

Sobald im obigen Code Result gesetzt wird, erhält das KI-Modell die Antwort (z.B. "In Berlin sind es 25°C.") und kann diese in seine vollständige Antwort an den Benutzer einbauen. Für den Endnutzer wirkt es so, als hätte das KI-Modell selbst die Information gewusst, tatsächlich hat es aber eine Backend-Funktion aufgerufen. Auf diese Weise lassen sich KIs mit Unternehmensdaten und Funktionen koppeln, z.B. mit Datenbankabfragen, Geschäftslogik oder externen APIs. TMS AI Studio nimmt die komplizierte Verkettung ab: Man definiert nur Tools und implementiert, was bei Aufruf passieren soll. Die Orchestrierung mit dem LLM übernimmt die Komponente im Hintergrund.

Multimodale KI, Dateianalyse und Retrieval Augmented Generation

Moderne KI-Modelle verarbeiten nicht nur Text. Sie sind multimodal, d.h., sie können auch Bilder, PDFs oder Audiodaten analysieren und generieren. Die TMS AI-Komponente kann eine Datei-Liste verwalten. Darüber können Dateien an das KI-Modell geschickt werden. Ein typisches Beispiel ist die Bildanalyse. Die Komponente sorgt dafür, dass Modelle wie GPT oder Google Gemini das Bild erhalten und eine entsprechende Beschreibung liefern. Ähnliche Anwendungen sind z.B., Text aus PDF-Rechnungen auszulesen oder Tabellen in einem Spreadsheet zusammenzufassen. TMS AI Studio unterstützt OCR (Optical Character Recognition) für Bilder/Scans sowie Speech-to-Text und Text-to-Speech für Audio. Damit ist es möglich, Sprache in Text umzuwandeln und umgekehrt Antworten vorlesen zu lassen. Das ist nützlich für Sprachassistenten.

Ein weiterer Anwendungsfall der Multimodalität ist RAG (Retrieval Augmented Generation). Dabei kombiniert man ein LLM mit unternehmensspezifischem Wissen, indem man Dokumente oder Datenbankinhalte als Kontext mitgibt. Es gibt zwei Ansätze: Entweder man hängt den Text direkt an den Prompt an oder man übergibt die Dateien und referenziert sie im Prompt. So könnte man z.B. eine firmeninterne Wissensbasis (PDFs, Handbücher) der KI zugänglich machen, ohne dass diese Daten öffentlich ins Modelltraining geflossen sind. Die Komponente erlaubt das Hochladen, Abrufen und Löschen der Kontext-Daten.

MCP – Model Context Protocol und AI Agents

Model Context Protocol (MCP) ist eine Generalisierung des Function Calling, welches Werkzeugsammlungen und Dienste standardisiert verfügbar macht. TMS AI Studio implementiert MCP für Delphi in Form der Klassen TTMSMCPServer und TTMSMCPClient. Mit TTMSMCPServer kann man einen MCP-Server bauen, der beliebige Tools bereitstellt. Beispielsweise lässt sich ein MCP-Server mit Namen, Version und verfügbaren Tools in wenigen Zeilen konfigurieren und starten. Intern übernimmt TTMSMCPServer die Logik. Der Entwickler definiert wie bei Function Calling die Tools und deren Implementierung (z.B. Datenbankabfragen, Sensorwerte auslesen, Dateien durchsuchen usw.). Ein Vorteil von MCP ist die Offenheit: Tools können zur Laufzeit abgefragt werden, es gibt eine Versionierung und ein KI-System kann mehrere MCP-Server gleichzeitig verwenden. So könnte man einen Server für Datenbankzugriff, einen zweiten für Dateisystem-Suche und einen dritten für externe APIs parallel anbinden. Das LLM kann je nach Bedarf Befehle an den jeweils passenden Server senden. Die Bereitstellung der Businesslogik durch die MCP-Server-Komponente ist dabei einfach zu realisieren. Dazu können bestehende Klassen durch Attributdekoration annotiert und auf diese Weise für den MCP-Server zugänglich werden. Die vorhandene Geschäftslogik kann im neuen Kontext wiederverwendet und muss nicht neu codiert werden.

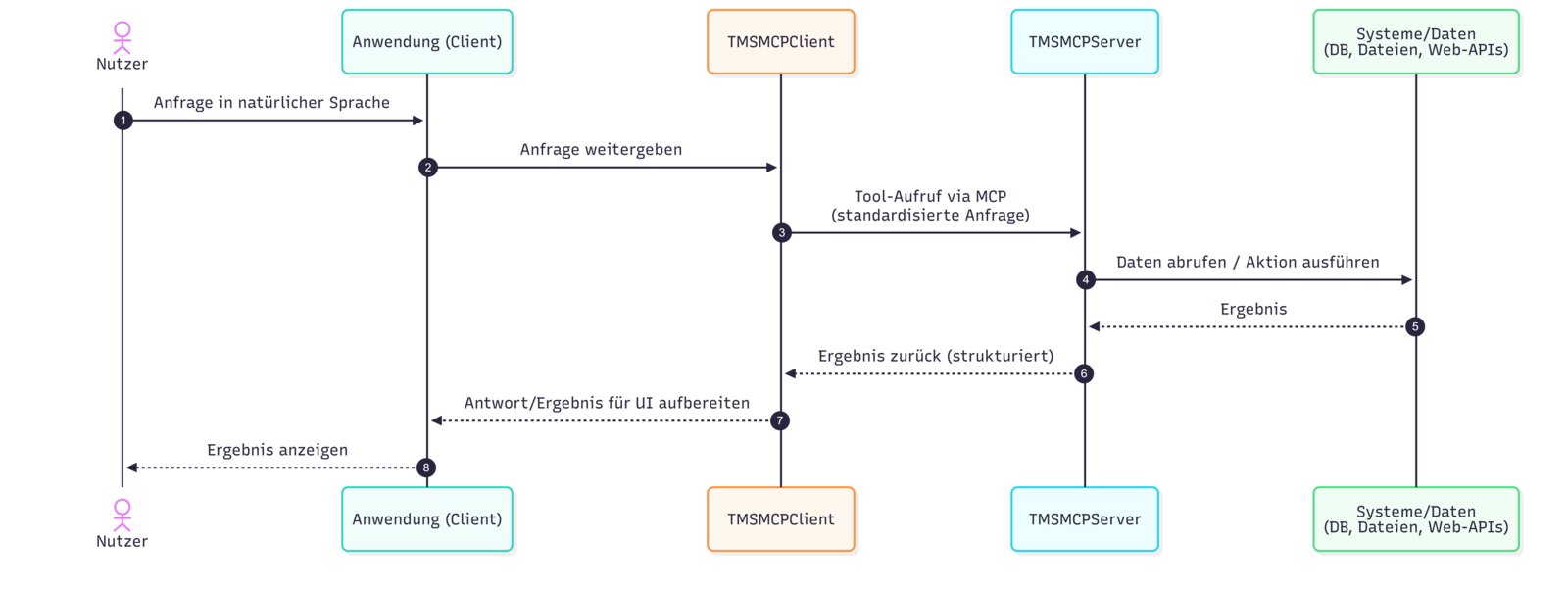

Der TTMSMCPClient dient dazu, aus der Anwendung eine KI mit MCP-Servern zu verbinden. Man kann einen KI-Host erstellen, der bestimmte Server kennt und bei Bedarf entsprechende Kommandos auslöst, wenn das LLM danach verlangt. In TMS AI Studio kann der MCP-Client mehrere Serververbindungen verwalten, um die Anfragen weiterzureichen. Das erlaubt komplexe Agenten-Szenarien: Stellen wir uns z.B. einen KI-gesteuerten Assistenten vor, der Kundenfragen beantwortet. Mit MCP könnte dieser Assistent einerseits in der firmeneigenen Wissensdatenbank suchen, andererseits aktuelle Daten via Web API abrufen oder Transaktionen in einem internen System ausführen. Für Unternehmen bedeutet das, dass bestehende Systeme in KI-Workflows eingebunden werden können, ohne dem KI-Modell selbst direkt Zugang zu kritischen Ressourcen zu geben. Der Daten- und Informationsfluss ist in Bild 2 skizziert.

Anwendungsfälle

Im Folgenden betrachten wir einige Use Cases:

- Intelligente Dokumentenverarbeitung: Zum Beispiel lassen sich mit der Kombination aus LLM und OCR Rechnungen (PDFs) auslesen und die relevanten Felder (Rechnungsnummer, Datum, Betrag, Lieferant etc.) extrahieren. Die KI übernimmt die Interpretation des unstrukturierten Dokuments und liefert strukturierte Daten zurück (JSON), die weiterverarbeitet werden können. Durch die Lernfähigkeit der Modelle funktioniert dies auch bei Dokumenten, die nicht pixelgenau gleich formatiert sind. Es ist ein Vorteil gegenüber "fest" programmierten OCR-Parsern. Ein Beispielprojekt zur Analyse von Rechnungsdaten ist unter [5] zu finden. Eine Skizze des User Interfaces zur Kernfunktion zeigt Bild 3.

- Natürliche Sprache zu SQL: Die Interaktion mit Datenbanken erfordert Fachwissen in SQL. LLMs eröffnen hier einen neuen Ansatz: Benutzer geben Abfragen in natürlicher Sprache ein und eine KI übersetzt diese in SQL-Statements. Ein MCP-Server kann diese Vermittlung übernehmen: Er empfängt z.B. das Kommando "Gib mir alle Kunden, die im letzten Jahr mehr als 10.000 € Umsatz hatten!" und formt daraus eine SQL Query auf die Kundendatenbank, z.B.:

SELECT * FROM Kunden WHERE Umsatz_Jahr > 10000 AND Jahr = 2024;

Der Anwender muss keine SQL Syntax kennen. Solche Szenarien sind attraktiv für Business User, die ad hoc Auswertungen oder Änderungen an Daten vornehmen wollen, ohne die IT einzubinden. Gleichzeitig bleibt die Kontrolle gewahrt: Der Entwickler des MCP-Servers kann definieren, welche Aktionen erlaubt sind, z.B. nur Lesezugriff oder eingeschränkte Schreiboperationen und gefährliche Befehle filtern.

- Visuelle Analyse und Berichterstellung: Dank multimodaler Fähigkeiten kann die KI Bilder, Diagramme oder Grafiken beschreiben und interpretieren. So lässt sich beispielsweise eine Anwendung realisieren, die Fotos von Bauteilen analysiert und Auffälligkeiten erkennt ("Kratzer in der linken oberen Ecke“). Diese Beschreibung kann anschließend automatisiert weiterverarbeitet werden, etwa zur Benachrichtigung von Entscheidern oder zur Einleitung von Folgeprozessen. Ebenso können Grafiken oder Fotos – etwa von Flipcharts – in Text zusammengefasst werden. Umgekehrt lassen sich aus strukturierten Daten automatisch Berichte oder Diagramme erzeugen. Ein Anwender könnte z.B. in natürlicher Sprache anfordern: "Erstelle mir ein Umsatzdiagramm der letzten 12 Monate!", worauf die Anwendung ein fertiges interaktives Chart generiert. Für Entwickler bedeutet das eine deutliche Reduktion manuellen Aufwands, da viele bislang aufwändige Schritte durch KI automatisiert werden können.

- Chatbots und virtuelle Assistenten: Entwickler können einen Chatbot in eine Delphi-Anwendung integrieren, z.B. als Support-Chat für Kunden. Dank der Multi-Provider-Unterstützung kann man je nach Anforderung das passende Modell auswählen. Durch Function Calling und MCP lässt sich der Chatbot mit Unternehmenswissen und Fähigkeiten anreichern. So können Kunden im Chatbot nicht nur Fragen stellen, sondern der Bot kann auch Vorgänge ausführen, z.B. "Bestell mir Ersatzteile nach!" – woraufhin der Bot über ein MCP Tool die Bestellung im ERP-System anlegt.

Fazit & Ausblick

Die Integration von KI in Softwareanwendungen entwickelt sich rasant und eröffnet zunehmend neue Möglichkeiten. Künftige Modelle werden leistungsfähiger, effizienter und können größere Kontextmengen verarbeiten, wodurch umfangreiche Dokumente, Datenbanken oder komplexe Informationsbestände analysiert werden können. Neben Text, Bild und Audio werden zusätzlich Video- und Sensordaten relevant. Parallel dazu gewinnen autonome KI-Agenten an Bedeutung, die mehrschrittige Aufgaben nahezu eigenständig bewältigen, Entscheidungen treffen, Prozesse steuern und dennoch durch integrierbare Kontrollmechanismen menschlich überwachbar bleiben.

- Gartner, Inc. (2025). Gartner survey finds 77 percent of engineering leaders identify AI integration in apps as a major challenge. Abgerufen am 13. März 2026, von https://www.gartner.com/en/newsroom/press-releases/2025-05-22-gartner-survey-finds-77-percent-of-engineering-leaders-identify-ai-integration-in-apps-as-a-major-challenge

- TMS Software. (2026). TMS AI Studio. Abgerufen am 13. März 2026, von https://www.tmssoftware.com/site/tmsaistudio.asp

- Barnsten. (2025). AI superpower booklet. Abgerufen am 13. März 2026, von https://www.barnsten.com/wp-content/uploads/2025/07/ai_superpower_booklet.pdf

- TMS Software. (2024). AI integration in modern software development. Abgerufen am 13. März 2026, von https://www.tmssoftware.com/site/blog.asp?post=1348

- TMS Software. (2025). Building AI-powered applications with TMS AI Studio. Abgerufen am 13. März 2026, von https://www.tmssoftware.com/site/blog.asp?post=2373

![Abb. 3: KI-gestützte Dokumentenanalyse – hier Rechnungen [5]. Abb. 3: KI-gestützte Dokumentenanalyse – hier Rechnungen [5].](/fileadmin/templates/wr/pics/Artikel/03_Betrieb/KI/Abb3-Example_Rechnungen.png)