KI und Nachhaltigkeit im Betrieb

1. Warum KI und Nachhaltigkeit zusammengedacht werden müssen

Künstliche Intelligenz ist im Alltag angekommen, oft leise und beinahe unbemerkt. Empfehlungssysteme entscheiden, welche Inhalte wir sehen. Algorithmen priorisieren Bewerbungen, optimieren Lieferketten oder unterstützen Entwickler beim Schreiben von Code. In Unternehmen ist KI längst keine Spielerei mehr, sondern ein Werkzeug, das Prozesse beschleunigt, Kosten senkt und neue Geschäftsmodelle ermöglicht. Gerade weil ihr Einsatz so selbstverständlich geworden ist, gerät eine zentrale Frage zunehmend aus dem Blick: Welche ökologischen Folgen hat diese Form digitaler Intelligenz eigentlich?

1. Warum KI und Nachhaltigkeit zusammengedacht werden müssen

3. Der unsichtbare Preis der Künstlichen Intelligenz

4. Der Lebenszyklus eines KI-Systems

6. Wie lässt sich der CO2-Fußabdruck von KI messen

Künstliche Intelligenz ist im Alltag angekommen, oft leise und beinahe unbemerkt. Empfehlungssysteme entscheiden, welche Inhalte wir sehen. Algorithmen priorisieren Bewerbungen, optimieren Lieferketten oder unterstützen Entwickler beim Schreiben von Code. In Unternehmen ist KI längst keine Spielerei mehr, sondern ein Werkzeug, das Prozesse beschleunigt, Kosten senkt und neue Geschäftsmodelle ermöglicht. Gerade weil ihr Einsatz so selbstverständlich geworden ist, gerät eine zentrale Frage zunehmend aus dem Blick: Welche ökologischen Folgen hat diese Form digitaler Intelligenz eigentlich?

Lange Zeit wurde Nachhaltigkeit in der IT vor allem mit Hardware, Rechenzentren und Stromverbrauch assoziiert. Effizientere Server, bessere Kühlung, der Umstieg auf erneuerbare Energien. Diese Perspektive greift heute zu kurz. Moderne IT besteht nicht mehr nur aus Infrastruktur, sondern aus komplexen Software-Systemen, datengetriebenen Architekturen und lernenden Modellen. Algorithmen sind zu einem eigenständigen Produktionsfaktor geworden. Damit tragen sie auch eine eigene ökologische Verantwortung.

KI verspricht Effizienz und genau hier entsteht ein Spannungsfeld. Auf der einen Seite stehen erhebliche Produktivitätsgewinne. Automatisierung ersetzt manuelle Arbeit, Vorhersagemodelle reduzieren Ausschuss, intelligente Steuerung spart Ressourcen. Auf der anderen Seite wächst der Ressourcenverbrauch der digitalen Systeme selbst. Große Modelle benötigen enorme Rechenleistung. Trainingsläufe dauern Tage oder Wochen. Der Energiebedarf steigt, ebenso der Bedarf an spezialisierten Chips, Kühlung und Wasser. Effizienz auf Prozessebene kann somit zu Mehrverbrauch auf Systemebene führen.

Diese Ambivalenz ist kein Randthema, sondern strukturell. Denn KI skaliert besonders gut: Was einmal trainiert ist, lässt sich millionenfach anwenden. Genau diese Skalierbarkeit sorgt dafür, dass selbst kleine Energieverbräuche pro Anfrage in der Summe relevant werden. Milliarden täglicher Interaktionen erzeugen einen ökologischen Fußabdruck, der sich nicht mehr ignorieren lässt. Nachhaltigkeit in der KI ist deshalb keine moralische Zusatzfrage, sondern eine betriebswirtschaftliche und gesellschaftliche Notwendigkeit.

In diesem Kontext hat sich der Begriff Green AI etabliert. Er beschreibt das Bestreben, ökologische Auswirkungen von KI-Systemen systematisch zu berücksichtigen und zu reduzieren. Dabei geht es nicht um Verzicht auf Innovation, sondern um bewusste Gestaltung. Green AI fragt, wie Modelle effizienter trainiert werden können, wie sich der Energieverbrauch messen lässt und wie Entscheidungen über Architektur, Standort und Nutzung ökologische Folgen beeinflussen.

Der tatsächliche ökologische Fußabdruck von KI ist allerdings sehr komplex. Er entsteht nicht nur während des Trainings eines Modells, sondern über dessen gesamten Lebenszyklus hinweg. Daten müssen gesammelt, gespeichert und verarbeitet werden.

Modelle werden iterativ verbessert, neu trainiert und angepasst. Im Betrieb verbrauchen sie kontinuierlich Energie. Hinzu kommen indirekte Effekte wie die Hardwareproduktion und deren Entsorgung. Diese Vielschichtigkeit erschwert einfache Antworten auf die Frage der Nachhaltigkeit der KI, ermöglicht aber eine gezielte Steuerung.

Messbarkeit spielt dabei eine zentrale Rolle. Energieverbräuche, Emissionsfaktoren des Strommixes, Auslastung der Hardware und Laufzeiten lassen sich heute technisch erfassen. Auch wenn die Messungen nie perfekt sind, ermöglichen sie eine Vergleichbarkeit und damit Transparenz. Erst auf dieser Basis können Unternehmen entscheiden, welche KI-Anwendungen einen echten Mehrwert liefern und wo Optimierung sinnvoll oder sogar notwendig ist.

2. KI als Effizienztreiber

Der Einsatz von KI wird häufig mit dem Versprechen verbunden, bestehende Prozesse grundlegend effizienter zu machen. Dieses Versprechen ist nicht aus der Luft gegriffen. In vielen Organisationen markiert KI tatsächlich den Übergang von klassischer Automatisierung hin zu Systemen, die aus Daten lernen und sich an neue Situationen anpassen können. Während regelbasierte Software klar definierte Abläufe abarbeitet, analysieren lernende Modelle Muster, Wahrscheinlichkeiten und Zusammenhänge. Genau diese Fähigkeit macht sie für Unternehmen so attraktiv.

Historisch betrachtet ist dieser Wandel relativ jung. Lange Zeit bestand Automatisierung vor allem darin, menschliche Entscheidungen durch feste Regeln zu ersetzen. Das funktionierte gut, solange Prozesse stabil und vorhersehbar waren. Mit wachsender Komplexität stießen derartige Ansätze jedoch an Grenzen. Datenmengen wuchsen schneller, als Regelwerke gepflegt werden konnten. KI schließt diese Lücke, indem sie nicht jede Ausnahme explizit modellieren muss, sondern aus Beispielen generalisiert. Effizienz entsteht hier nicht nur durch Geschwindigkeit, sondern durch bessere Entscheidungen unter Unsicherheit.

Vor diesem Hintergrund gilt KI heute als Schlüsseltechnologie für Wettbewerbsfähigkeit. Unternehmen erwarten, schneller auf Marktveränderungen reagieren zu können, Ressourcen gezielter einzusetzen und neue Angebote zu entwickeln. In der Softwareentwicklung unterstützen KI-Systeme beim Schreiben, Testen und Refaktorisieren von Code. Entwicklungszeiten verkürzen sich, Fehler werden früher erkannt. Im Kundenservice übernehmen Chatbots und Assistenzsysteme einen Teil der Anfragen, entlasten Mitarbeitende und ermöglichen durchgängige Erreichbarkeit.

Auch in Industrie und Logistik zeigen sich Effizienzgewinne. Prognosemodelle optimieren Wartungsintervalle, reduzieren Stillstände und verlängern die Lebensdauer von Maschinen. Routenplanung und Lagersteuerung werden dynamischer, reagieren auf aktuelle Nachfrage und Verkehrsbedingungen. In der Wissensarbeit unterstützen KI-Systeme bei Recherche, Analyse und Zusammenfassung komplexer Inhalte. Sie ersetzen nicht das Fachwissen, erhöhen aber die Geschwindigkeit, mit der Informationen verarbeitet werden können.

Diese mikroökonomischen Effekte spiegeln sich auch in makroökonomischen Erwartungen wider. Studien prognostizieren signifikante Produktivitätssteigerungen durch den breiten Einsatz von KI. Eine Analyse von McKinsey Global Institute schätzt, dass generative KI weltweit jährlich 2,6 bis 4,4 Billionen US-Dollar zusätzliche Wirtschaftsleistung erzeugen könnte [1]. Ein großer Teil dieses Potenzials entsteht durch Effizienzgewinne in Wissensarbeit, Softwareentwicklung und Kundenservice.

Genau hier ist eine erste kritische Einordnung notwendig. Effizienz ist kein absoluter Wert. Sie ist immer relativ zu einem Ziel, einer Perspektive und einem Zeitraum. Wenn KI Prozesse beschleunigt, stellt sich die Frage, wer davon profitiert. Werden Ressourcen tatsächlich eingespart oder lediglich anders verteilt? Verkürzte Entwicklungszeiten können zu mehr Projekten führen. Automatisierte Analysen können die Anzahl der Entscheidungen erhöhen, aber nicht unbedingt deren Qualität.

Hinzu kommt die Frage nach dem Preis dieser Effizienz. KI-Systeme benötigen Daten, Rechenleistung und kontinuierliche Pflege. Der Aufwand verlagert sich häufig von der operativen Nutzung in die Entwicklungs- und Betriebsphase. Ein Modell, das menschliche Arbeit einspart, verursacht möglicherweise hohe laufende Energiekosten. Effizienzgewinne auf Organisationsebene können mit steigenden Emissionen auf Systemebene einhergehen.

Diese Effekte sind nicht zwangsläufig negativ, sie müssen jedoch bewusst gemacht werden. Effizienz darf nicht ausschließlich als betriebswirtschaftliche Kennzahl verstanden werden. In einer Zeit begrenzter Ressourcen gewinnt die ökologische Dimension an Bedeutung. Die entscheidende Frage lautet daher nicht, ob KI effizient ist, sondern unter welchen Bedingungen sie es ist und welche Kosten dabei entstehen.

KI als Effizienztreiber ist Realität. Gleichzeitig ist sie ein Verstärker bestehender Dynamiken. Sie skaliert Erfolge ebenso wie Fehlanreize. Ohne klare Zieldefinition und ohne Einbettung in eine nachhaltige Strategie besteht die Gefahr, dass Effizienzgewinne kurzfristig beeindruckend wirken, langfristig jedoch neue Probleme schaffen. Wer KI verantwortungsvoll einsetzen will, muss Effizienz deshalb ganzheitlich betrachten und über klassische Produktivitätsmetriken hinausdenken.

3. Der unsichtbare Preis der Künstlichen Intelligenz

![Abb. 1: Gestiegene Rechenleistung pro Jahr. Abb. 1: Gestiegene Rechenleistung pro Jahr <a href="#c48018">[2]</a>. © Rewion](/fileadmin/templates/wr/pics/Artikel/03_Betrieb/KI/Abb1-Gestiegene-Rechenleistung-pro-Jahr-_c_-Epoch-AI-cc-by.png)

Die Leistungsfähigkeit moderner KI-Systeme beruht auf einer Ressource, die lange als nahezu unbegrenzt wahrgenommen wurde: Rechenleistung. Je komplexer ein Modell, je größer die Datenbasis und je höher die gewünschte Genauigkeit, desto mehr Rechenzeit wird benötigt. Dieser Zusammenhang ist technisch gut verstanden, wird in der öffentlichen Debatte jedoch häufig unterschätzt. Der ökologische Preis der Künstlichen Intelligenz bleibt oft unsichtbar, weil er nicht unmittelbar dort anfällt, wo der Nutzen entsteht.

3.1 Steigende Rechenleistung als Grundlage moderner KI

In den vergangenen Jahren haben sich die Größenordnungen von KI-Modellen drastisch verändert. Während frühe Machine Learning-Ansätze mit vergleichsweise wenigen Parametern auskamen, arbeiten heutige Modelle mit Milliarden oder sogar Billionen von Parametern. Diese Entwicklung folgt nicht nur dem Wunsch nach höherer Genauigkeit, sondern auch empirischen Skalierungsgesetzen. Größere Modelle, trainiert auf mehr Daten, liefern in vielen Anwendungsfällen bessere Ergebnisse.

Der Preis dieser Skalierung ist ein exponentiell wachsender Bedarf an Rechenleistung. Training bedeutet, ein Modell über viele Iterationen hinweg anzupassen. Jede dieser Iterationen erfordert umfangreiche Matrixoperationen, die auf spezialisierten Prozessoren ausgeführt werden. Die Trainingsdauer steigt nicht linear mit der Modellgröße, sondern oft überproportional. Hinzu kommt, dass Modelle selten nur einmal trainiert werden. Hyperparameter Optimierung, Architekturvarianten und Fine Tuning führen zu einer Vielzahl von Trainingsläufen.

Der Zusammenhang zwischen Modellgröße, Trainingsdauer und Energiebedarf ist damit eng. Mehr Parameter bedeuten mehr Rechenoperationen. Längere Trainings bedeuten längere Laufzeiten der Hardware. Selbst bei steigender Effizienz der Prozessoren führt diese Dynamik zu einem absoluten Anstieg des Energieverbrauchs. Effizienzgewinne auf Hardwareebene werden durch den Wunsch nach leistungsfähigeren Modellen häufig überkompensiert.

3.2 Rechenzentren als kritische Infrastruktur

Diese Entwicklung wirkt sich unmittelbar auf Rechenzentren aus. Sie sind die physische Basis der digitalen Welt und werden zunehmend zur kritischen Infrastruktur. Der globale Stromverbrauch von Rechenzentren ist in den letzten Jahren deutlich gestiegen. Nach Angaben der International Energy Agency (IEA) lag der Stromverbrauch von Rechenzentren im Jahr 2024 bei rund 415 TWh, was etwa 1,5 % des weltweiten Stromverbrauchs entspricht [3].

KI-Workloads spielen dabei eine besondere Rolle. Im Vergleich zu klassischer IT zeichnen sie sich durch hohe Leistungsdichten und kontinuierliche Auslastung aus. GPUs und ähnliche Beschleuniger verbrauchen pro Zeiteinheit deutlich mehr Energie als herkömmliche Serverprozessoren.

Gleichzeitig stoßen klassische Effizienzsteigerungen an Grenzen. In der Vergangenheit konnten Verbesserungen in der Chiparchitektur den steigenden Bedarf teilweise ausgleichen. Miniaturisierung, geringere Strukturbreiten und optimierte Kühlung führten zu sinkendem Energieverbrauch pro Rechenoperation. Diese Fortschritte verlangsamen sich. Physikalische Grenzen machen weitere Effizienzsprünge schwieriger und teurer. Der absolute Strombedarf steigt daher weiter an.

Hinzu kommen indirekte Effekte, denn höhere Leistungsdichten erfordern aufwendigere Kühlsysteme. In vielen Regionen spielt auch der Wasserverbrauch eine Rolle. Rechenzentren konkurrieren dort mit anderen Nutzern um knappe Ressourcen. Der ökologische Fußabdruck beschränkt sich somit nicht auf den Stromverbrauch allein, sondern umfasst ein komplexes Zusammenspiel verschiedener Faktoren.

3.3 Konkrete Zahlen und Relationen

Um die Dimensionen greifbar zu machen, lohnt ein Blick auf konkrete Zahlen. Das Training großer Sprachmodelle verursacht CO2-Emissionen in einer Größenordnung, die mit bekannten Emissionsquellen vergleichbar ist. Einzelne Trainingsläufe können Emissionen verursachen, die denen von Langstreckenflügen entsprechen. (Modelling-Tool zur Berechnung des CO2-Fußabdrucks von Prompts [4]).

Auch im laufenden Betrieb entstehen relevante Effekte. Eine einzelne KI-Anfrage verursacht nur wenige Gramm CO2. In Isolation betrachtet ist dieser Wert gering. Die Skalierung macht den Unterschied. Milliarden täglicher Anfragen summieren sich zu tausenden Tonnen CO2, erheblichem Energieverbrauch und relevantem Wasserbedarf. Der ökologische Fußabdruck entsteht hier nicht durch eine einzelne Entscheidung, sondern durch die Menge.

Diese Relationen verdeutlichen ein zentrales Problem. KI-Systeme sind hochgradig skalierbar, sowohl im Nutzen als auch im Verbrauch. Der unsichtbare Preis der Intelligenz liegt nicht in spektakulären Einzelereignissen, sondern im kontinuierlichen Betrieb. Genau deshalb ist Transparenz so wichtig. Nur wer diese Größenordnungen kennt, kann fundierte Entscheidungen treffen und Prioritäten setzen.

4. Der Lebenszyklus eines KI-Systems

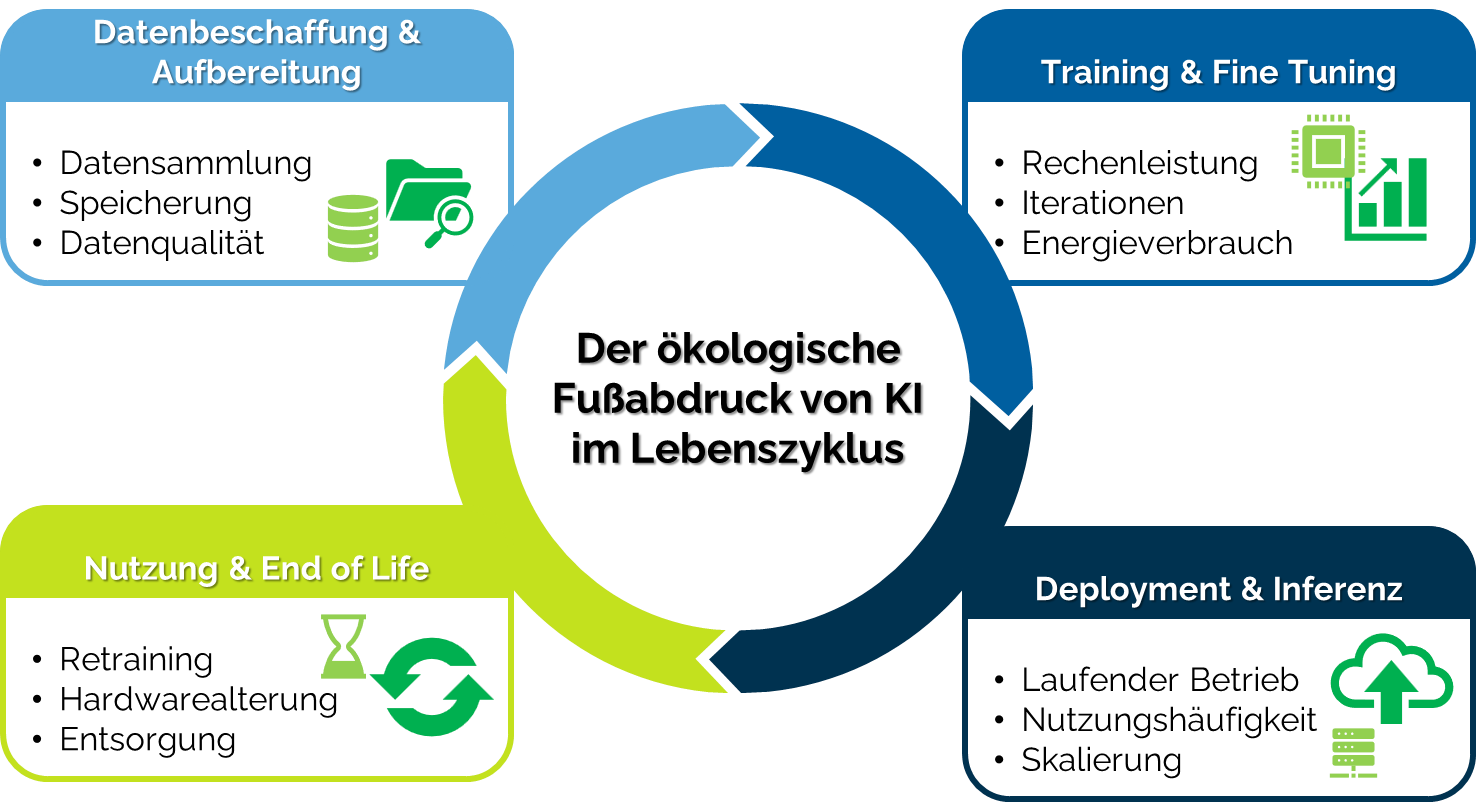

Der ökologische Fußabdruck eines KI-Systems lässt sich nicht auf einen einzelnen Moment reduzieren. Er entsteht über einen langen Zeitraum hinweg und verteilt sich auf verschiedene Phasen, die jeweils eigene Herausforderungen mit sich bringen. Wer Nachhaltigkeit ernst nimmt, muss diesen gesamten Lebenszyklus betrachten. Genau hier liegt eine der größten Schwächen vieler aktueller Diskussionen. Häufig wird der Fokus auf das Training gelegt, weil es sichtbar ist. Der eigentliche Ressourcenverbrauch verteilt sich jedoch oft viel breiter.

4.1 Datenbeschaffung und Aufbereitung

Am Anfang jedes KI-Systems stehen Daten. Sie müssen gesammelt, bereinigt, strukturiert und gespeichert werden. Dieser Prozess ist selten trivial. Daten stammen aus unterschiedlichen Quellen, liegen in verschiedenen Formaten vor und variieren stark in ihrer Qualität. Allein die Erhebung kann energieintensiv sein, etwa wenn Sensoren kontinuierlich Daten liefern oder große Mengen an Texten und Bildern aus bestehenden Systemen extrahiert werden.

Die Speicherung dieser Daten verursacht ebenfalls einen laufenden Energieverbrauch. Große Datensätze werden redundant vorgehalten, gesichert und regelmäßig verarbeitet. Hinzu kommen Datenpipelines, die Informationen transformieren und anreichern. In vielen Projekten wächst die Datenmenge über Jahre hinweg, ohne dass regelmäßig hinterfragt wird, welche Daten tatsächlich noch benötigt werden. Quantität wird dabei oft höher bewertet als Qualität, obwohl gerade schlecht kuratierte Daten zu ineffizientem Training und damit zu einem höherem Ressourcenverbrauch führen.

4.2 Training und Fine Tuning

Das Training eines Modells ist die sichtbarste Phase im Lebenszyklus. Hier wird Rechenleistung in konzentrierter Form eingesetzt. Hardware läuft über lange Zeiträume unter hoher Auslastung. In der Praxis besteht das Training selten aus einem einzigen Lauf.

Modelle werden iterativ verbessert, angepasst und erneut trainiert. Hyperparameter werden variiert, Architekturen verglichen, Ergebnisse evaluiert.

Das Fine Tuning verstärkt diesen Effekt. In diesem Schritt werden vorgefertigte Modelle auf spezifische Anwendungsfälle angepasst. Auch wenn diese Anpassungen weniger ressourcenintensiv sind als ein vollständiges Training von Grund auf, summieren sie sich über viele Iterationen. Besonders in agilen Entwicklungsprozessen entsteht ein kontinuierlicher Strom an Trainingsjobs, deren Energieverbrauch oft nicht transparent erfasst wird.

4.3 Deployment und Inferenz

Nach dem Training folgt der Betrieb. Modelle werden in Anwendungen integriert, skaliert und dauerhaft genutzt. Diese Phase wird häufig unterschätzt, obwohl sie in vielen Fällen den größten Anteil am Gesamtenergieverbrauch ausmacht. Jede Inferenz, also jede Anwendung des Modells auf neue Daten (ausgelöst durch einen Prompt des Nutzers), benötigt Rechenleistung. Je höher die Nutzung, desto größer der Verbrauch.

Die Art des Deployments spielt dabei eine wichtige Rolle. On-Premise-Lösungen bieten Kontrolle, erfordern aber eine eigene Infrastruktur. Cloudbasierte Ansätze ermöglichen flexible Skalierung, verlagern den Energieverbrauch jedoch in externe Rechenzentren. Entscheidend ist nicht nur der Ort, sondern auch die Nutzungsintensität. Ein hochperformantes Modell, das selten genutzt wird, kann ökologisch sinnvoller sein als ein weniger effizientes Modell mit extrem hoher Anfragezahl.

4.4 Nutzung und End of Life

Der Lebenszyklus endet nicht mit dem Betrieb, da auch KI-Modelle altern. Die Daten verändern sich und Anforderungen wachsen. Regelmäßige Updates und Retraining sind notwendig, um die Leistungsfähigkeit zu erhalten. Jede dieser Maßnahmen verursacht erneut Energieverbräuche. Parallel dazu altert die eingesetzte Hardware. Beschleuniger und Server werden ersetzt, oft bevor ihre technische Lebensdauer vollständig ausgeschöpft ist.

Die Entsorgung und Wiederverwertung dieser Hardware bringt weitere ökologische Fragen und Herausforderungen mit sich. Seltene Rohstoffe, energieintensive Produktionsprozesse und globale Lieferketten sind Teil der Bilanz. Nachhaltige KI bedeutet daher auch, die Lebensdauer von Systemen zu verlängern und bewusste Entscheidungen über deren Erneuerung und Austausch zu treffen.

Der Blick auf den gesamten Lebenszyklus macht deutlich, dass Nachhaltigkeit kein einmaliges Optimierungsprojekt ist. Sie ist ein kontinuierlicher Prozess, der technische, organisatorische und kulturelle Aspekte verbindet. Nur wer alle Phasen berücksichtigt, kann den tatsächlichen Einfluss von KI-Systemen realistisch bewerten und gezielt reduzieren.

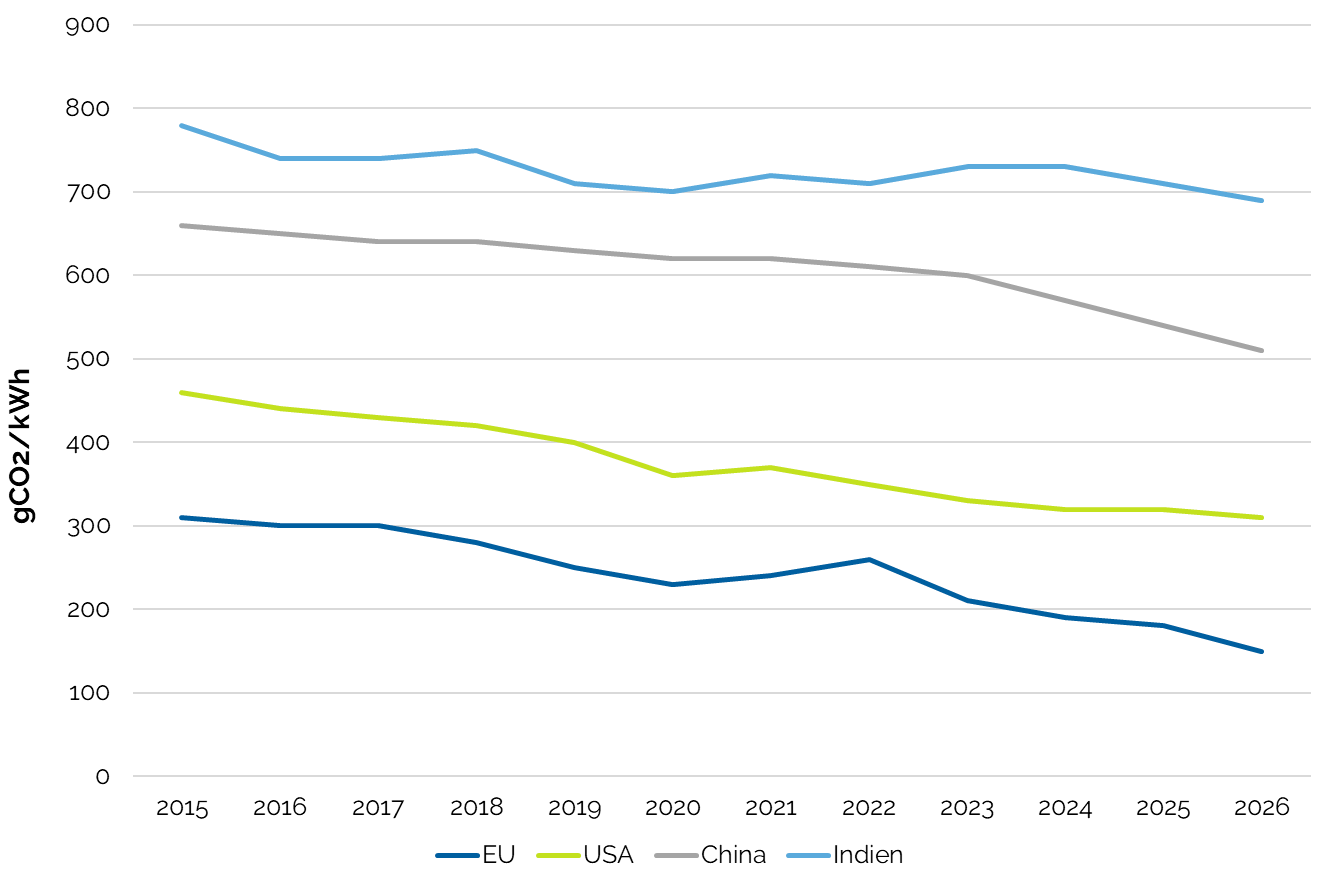

5. Region, Strommix und Zeit

Der ökologische Fußabdruck eines KI-Systems hängt, wie oben erwähnt, nicht allein davon ab, wie viel Rechenleistung eingesetzt wird. Ebenso entscheidend ist, wo und wann diese Rechenleistung erbracht wird. Denn Strom ist nicht gleich Strom: Die CO2-Intensität einer Kilowattstunde unterscheidet sich weltweit erheblich. Während sie in der Europäischen Union bei etwa 150–200 g CO2/kWh liegt, beträgt sie in Indien über 700 g CO2/kWh. Damit wird die geografische und zeitliche Dimension zu einem oft unterschätzten Nachhaltigkeitsfaktor in der KI-Nutzung.

Zwischen einzelnen Ländern, aber auch zwischen Regionen innerhalb eines Landes bestehen große Unterschiede im Strommix. Während beispielsweise in der Europäischen Union ein vergleichsweise hoher Anteil erneuerbarer Energien genutzt wird, dominieren in Ländern wie China und Indien weiterhin fossile Energieträger (IEA, 2025) [5]. Ein identischer Trainingslauf kann je nach Standort ein Vielfaches an Emissionen verursachen. Für Unternehmen, die KI-Systeme in der Cloud betreiben, ist diese Tatsache besonders relevant. Die Wahl der Cloud-Region ist nicht nur eine Frage von Latenz oder Kosten, sondern auch eine ökologische Entscheidung.

Hinzu kommt die zeitliche Komponente. Der Anteil erneuerbarer Energien im Stromnetz schwankt im Tagesverlauf und je nach Wetterlage. Solarstrom steht tagsüber zur Verfügung, Windenergie ist wetterabhängig. In vielen Netzen variiert die CO2-Intensität stündlich. Ein Rechenjob, der nachts in einer Region mit hohem Kohlestromanteil läuft, kann deutlich höhere Emissionen verursachen als derselbe Job zu einem Zeitpunkt mit hoher Einspeisung erneuerbarer Energien.

Aus dieser Erkenntnis heraus hat sich das Konzept des Carbon Aware Computing entwickelt. Die Grundidee ist einfach, die Umsetzung jedoch anspruchsvoll. Rechenlasten sollen möglichst dann und dort ausgeführt werden, wo der Strom besonders klimafreundlich ist. Für nicht zeitkritische Trainingsläufe oder Batch-Prozesse eröffnet dies erhebliches Potenzial. Aufgaben können verschoben, priorisiert oder regional verteilt werden, ohne die fachliche Qualität zu beeinträchtigen.

In der Praxis stößt dieser Ansatz jedoch auch an Grenzen. Nicht alle Workloads sind flexibel. Echtzeitanwendungen im Kundenservice oder sicherheitskritische Systeme lassen sich nicht beliebig verschieben. Auch regulatorische Anforderungen an Datenhaltung und Datenschutz schränken die freie Wahl des Standorts ein. Zudem sind Informationen zur aktuellen CO2-Intensität nicht überall in gleicher Qualität verfügbar.

Trotz dieser Einschränkungen zeigt sich, dass Ort und Zeitpunkt einen messbaren Unterschied machen. Schon einfache Entscheidungen, wie die bewusste Auswahl einer Cloud-Region mit hohem Anteil erneuerbarer Energien, können den Fußabdruck eines KI-Systems deutlich reduzieren. In Kombination mit der zeitlichen Steuerung entsteht ein zusätzlicher Hebel, der unabhängig von Modellarchitektur oder Hardware greift.

Nachhaltige KI erfordert daher ein erweitertes Denken. Rechenleistung ist nicht nur eine technische Ressource, sondern auch eine ökologische Variable. Wer diese Dimension ignoriert, verschenkt Potenzial. Wer sie berücksichtigt, kann Effizienzgewinne erzielen, ohne neue Systeme entwickeln zu müssen. Region und Zeit werden damit zu strategischen Parametern verantwortungsvoller KI-Nutzung.

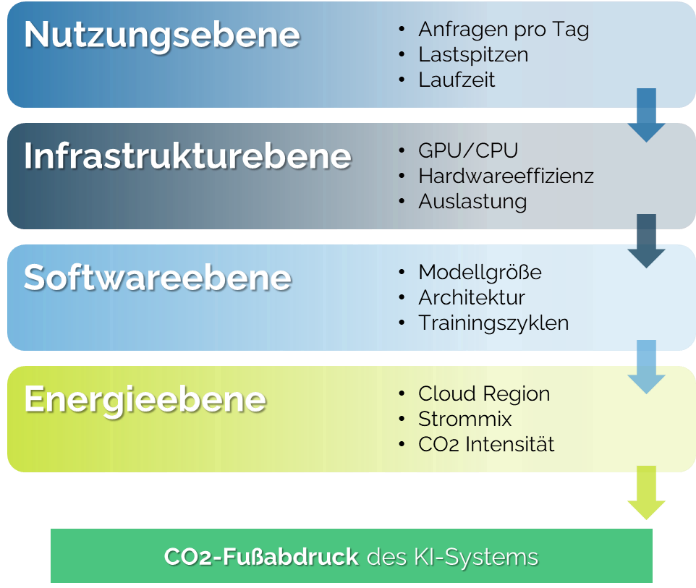

6. Wie lässt sich der CO2-Fußabdruck von KI messen

Nachhaltigkeit bleibt abstrakt, solange sie nicht messbar ist. Gerade im Kontext von KI ist diese Einsicht zentral. Viele Diskussionen über ökologische Auswirkungen scheitern nicht am fehlenden Willen, sondern an mangelnder Transparenz. Wer den CO2-Fußabdruck eines KI-Systems reduzieren möchte, muss ihn zunächst verstehen. Die Messung ist dabei kein Selbstzweck, sondern Voraussetzung für Steuerung und Priorisierung.

6.1 Grundformel und Einflussfaktoren

Im Kern basiert die Berechnung des CO2-Fußabdrucks von KI auf einer vergleichsweise einfachen Beziehung. Der Energieverbrauch eines Systems wird mit dem Emissionsfaktor des genutzten Stroms multipliziert. Diese scheinbar triviale Formel verdeckt jedoch eine Vielzahl technischer Details, die das Ergebnis maßgeblich beeinflussen.

Der Energieverbrauch ergibt sich aus der tatsächlichen Leistungsaufnahme der eingesetzten Hardware und der Laufzeit der jeweiligen Prozesse. TPUs und CPUs unterscheiden sich erheblich in ihrer Effizienz für bestimmte Aufgaben. Auch innerhalb einer Hardwareklasse gibt es große Unterschiede zwischen Generationen. Hinzu kommt die Auslastung. Eine schlecht ausgelastete GPU verbraucht nahezu ebenso viel Energie wie eine voll ausgelastete, liefert jedoch deutlich weniger Rechenleistung.

Die Laufzeit wird wiederum durch die Modellarchitektur, die Größe der Trainingsdaten und die Anzahl der Trainingszyklen bestimmt. Tiefe Netze mit vielen Parametern benötigen mehr Rechenoperationen pro Schritt. Iterative Optimierung erhöht die Gesamtdauer. Auch scheinbar kleine Entscheidungen, etwa die Wahl der Batchgröße oder der Lernrate, können indirekt Einfluss auf den Energieverbrauch haben.

Der Emissionsfaktor des Strommixes bildet die zweite zentrale Variable. Er gibt an, wie viel CO2 pro verbrauchter Kilowattstunde entsteht. Dieser Wert variiert regional und zeitlich. In der Praxis wird häufig mit Durchschnittswerten gearbeitet, obwohl diese keine kurzfristigen Schwankungen abbilden. Für grobe Vergleiche ist dies ausreichend, für präzise Optimierung jedoch nur bedingt geeignet.

6.2 Tools und Standards

Um diese Faktoren praktisch erfassbar zu machen, sind in den vergangenen Jahren verschiedene Werkzeuge und Standards entstanden. Open Source-Ansätze ermöglichen es, den Energieverbrauch von Trainingsläufen direkt während der Ausführung zu messen und daraus Emissionen abzuleiten. Solche Tools liefern keine perfekten Werte, schaffen jedoch Transparenz und Vergleichbarkeit.

Ein wichtiger Schritt in Richtung Standardisierung ist z. B. der Ansatz der Software Carbon Intensity. Er versucht, Emissionen nicht nur absolut zu messen, sondern ins Verhältnis zum erbrachten Nutzen zu setzen. Dadurch lassen sich unterschiedliche Systeme oder Versionen vergleichen, ohne allein auf absolute Emissionszahlen zu schauen. Für Unternehmen ist dies besonders relevant, da Effizienz nicht isoliert vom Geschäftswert betrachtet werden kann.

Auch Cloud-Anbieter stellen zunehmend Werkzeuge zur Verfügung, mit denen sich Emissionen von Workloads abschätzen lassen. Diese lassen sich in bestehende FinOps- und Monitoring-Prozesse integrieren. So entsteht eine Verbindung zwischen Kosten, Performance und Nachhaltigkeit. Allerdings stoßen auch diese Ansätze an Grenzen. Die zugrunde liegenden Annahmen sind nicht immer transparent, regionale Unterschiede werden teilweise vereinfacht dargestellt und indirekte Effekte bleiben oft unberücksichtigt.

Trotz dieser Einschränkungen ist klar, dass Messungen möglich, sinnvoll und auch notwendig sind. Perfekte Genauigkeit ist dabei zunächst nicht erforderlich, um bessere Entscheidungen zu treffen. Der Fokus liegt auf der Konsistenz. Wer mit denselben Methoden misst, kann Entwicklungen erkennen, Optimierungen bewerten und Prioritäten setzen.

7. Von Green AI zur Praxis

Die Erkenntnis über den ökologischen Fußabdruck von KI ist nur der erste Schritt. Entscheidend ist, wie dieses Wissen in konkrete Maßnahmen übersetzt wird. Green AI bleibt wirkungslos, wenn sie auf Leitbilder und Absichtserklärungen beschränkt bleibt. In der Praxis zeigt sich, dass viele Hebel bereits heute verfügbar sind, ohne dass grundlegende technologische Durchbrüche notwendig wären.

7.1 Effiziente Modellierung und Training

Ein zentraler Ansatzpunkt liegt in der Modellwahl. In vielen Projekten wird implizit angenommen, dass größere Modelle zwangsläufig bessere Ergebnisse liefern. Diese Annahme hält einer genaueren Betrachtung oft nicht stand. Für spezifische Anwendungsfälle können kleinere, spezialisierte Modelle ähnliche oder sogar bessere Leistungen erbringen, insbesondere wenn die Datenqualität hoch ist.

Die Reduktion von Parametern senkt nicht nur den Energiebedarf beim Training, sondern auch im späteren Betrieb. Transfer Learning bietet hier einen wirkungsvollen Hebel. Anstatt Modelle von Grund auf neu zu trainieren, werden vortrainierte Modelle gezielt angepasst. Dadurch lassen sich erheblich Ressourcen einsparen. Voraussetzung ist jedoch ein klares Verständnis des Use Cases und der relevanten Daten.

Auch die Qualität der Trainingsdaten spielt eine entscheidende Rolle. Saubere, gut kuratierte Datensätze ermöglichen schnelleres Konvergieren und reduzieren die Anzahl notwendiger Trainingsläufe. In der Praxis wird dieser Aspekt häufig unterschätzt, obwohl er vergleichsweise kostengünstig umzusetzen ist.

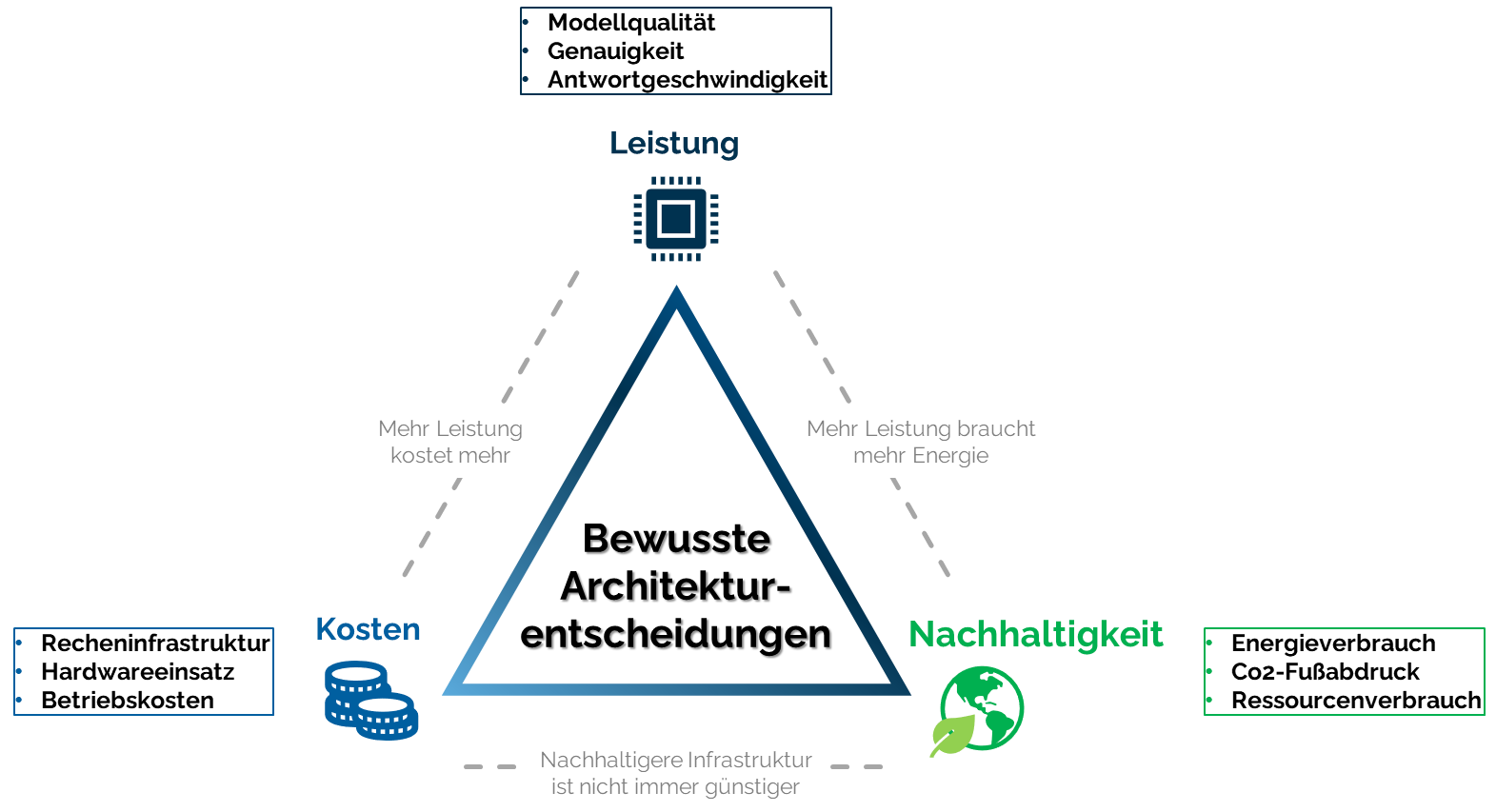

7.2 Infrastruktur und Architektur

Neben der Modellierung beeinflusst die zugrunde liegende Infrastruktur den ökologischen Fußabdruck erheblich. Moderne Architekturen setzen zunehmend auf Containerisierung und serverlose Ansätze, um Ressourcen bedarfsgerecht bereitzustellen. Unnötige Leerlaufzeiten lassen sich so vermeiden.

Ein weiterer Hebel ist die Verlängerung der Hardware-Lebensdauer. Nicht jede Leistungssteigerung rechtfertigt den Austausch bestehender Systeme. Gerade im KI-Umfeld besteht die Tendenz, schnell auf neue Hardwaregenerationen zu wechseln. Eine bewusste Abwägung zwischen Leistungsgewinn und zusätzlichem Ressourcenverbrauch ist hier notwendig.

Die Auswahl der Cloud-Region und der bevorzugten Energiequellen wirkt ebenfalls direkt auf die Emissionsbilanz. Viele Anbieter ermöglichen heute gezielte Entscheidungen, werden jedoch aus Bequemlichkeit oder mangelnder Transparenz nicht genutzt. Nachhaltige KI erfordert hier bewusstes Architekturdesign.

7.3 Monitoring und Transparenz

Keine dieser Maßnahmen entfaltet Wirkung ohne ein begleitendes Monitoring. Was nicht gemessen wird, lässt sich nicht steuern. Green KPIs schaffen eine gemeinsame Sprache zwischen Technik, Management und Nachhaltigkeitsverantwortlichen. Sie machen Fortschritte sichtbar und ermöglichen Vergleichbarkeit.

Das Reporting wird so zum Steuerungsinstrument und zeigt, welche Optimierungen tatsächlich Wirkung entfalten und wo Zielkonflikte entstehen. Transparenz schafft zudem Vertrauen, sowohl intern als auch extern. Green AI in der Praxis bedeutet, ökologische Verantwortung systematisch in den Entwicklungs- und Betriebsalltag zu integrieren.

8. Governance und Suffizienz

So wichtig technische Optimierungen auch sind, sie stoßen ohne geeignete organisatorische Rahmenbedingungen schnell an ihre Grenzen. Nachhaltige KI ist nicht allein eine Frage besserer Modelle oder effizienterer Hardware. Sie ist ebenso eine Frage von Entscheidungen, Prioritäten und kulturellen Leitplanken. Governance und Suffizienz rücken damit in den Mittelpunkt.

Governance beschreibt den Ordnungsrahmen, in dem KI entwickelt und eingesetzt wird. Dazu gehören Richtlinien, Prozesse und Verantwortlichkeiten. In vielen Unternehmen existieren bereits Regelwerke zu Datenschutz, IT-Sicherheit oder Compliance.

Nachhaltigkeit wird darin jedoch häufig nur am Rande behandelt oder auf klassische Infrastrukturthemen reduziert. Für KI-Systeme reicht das nicht aus. Sie benötigen klare Leitlinien, wann ihr Einsatz sinnvoll ist, welche Anforderungen an Effizienz gestellt werden und wie ökologische Auswirkungen berücksichtigt werden.

Suffizienz geht noch einen Schritt weiter. Sie stellt nicht die Frage, wie etwas effizienter umgesetzt werden kann, sondern ob es überhaupt notwendig ist. In der IT ist dieses Prinzip ungewohnt. Innovation wird oft mit Wachstum und Skalierung gleichgesetzt. KI verstärkt diesen Trend, weil sie neue Möglichkeiten eröffnet und bestehende Prozesse scheinbar mühelos erweitert. Suffizienz fordert dazu auf, bewusster zu entscheiden, welche Anwendungsfälle echten Mehrwert schaffen und welche lediglich Machbarkeit demonstrieren.

Diese Perspektive ist unbequem, aber notwendig, wenn es darum geht, KI und IT nachhaltig zu gestalten. Nicht jeder Prozess muss und sollte automatisiert werden. Nicht jede Idee rechtfertigt ein komplexes Modell. Gerade weil KI leistungsfähig und energiehungrig ist, braucht sie klare Grenzen. Produktteams tragen hier eine besondere Verantwortung. Sie entscheiden, welche Funktionen entwickelt werden, welche Modelle eingesetzt werden und wie stark Systeme skaliert werden. Nachhaltigkeit wird damit zu einer Frage der Produktstrategie.

Auch das Management spielt eine zentrale Rolle. Zielvorgaben, Anreizsysteme und Erfolgskriterien beeinflussen das Verhalten von Teams. Wenn Time-to-Market und Leistungskennzahlen dominieren, geraten ökologische Aspekte schnell ins Hintertreffen. Governance bedeutet daher auch, Nachhaltigkeit explizit als Ziel zu verankern und in Entscheidungsprozesse einzubeziehen.

Suffizienz ist kein Verzicht auf Technologie, sondern ein bewusster Umgang mit ihr. Sie hilft, Rebound-Effekte zu vermeiden, bei denen Effizienzgewinne durch zusätzliche Nutzung wieder aufgezehrt werden. In Kombination mit technischer Optimierung entsteht so ein ganzheitlicher Ansatz, der nachhaltige KI erst möglich macht.

9. Regulatorischer Rahmen

Nachhaltige KI im Kontext von ESG und CSRD

Neben freiwilligen Initiativen gewinnt der regulatorische Rahmen zunehmend an Bedeutung. Mit der Einführung neuer Berichtspflichten rückt Nachhaltigkeit stärker in den Fokus der Unternehmenssteuerung. Die europäische Richtlinie zur Nachhaltigkeitsberichterstattung, die Corporate Sustainability Reporting Directive (CSRD), verpflichtet eine wachsende Zahl von Unternehmen, ökologische und soziale Aspekte systematisch zu erfassen und offenzulegen.

Ein zentrales Element ist das Prinzip der doppelten Wesentlichkeit. Unternehmen müssen sowohl darstellen, wie ihre Geschäftstätigkeit die Umwelt beeinflusst als auch, wie Nachhaltigkeitsaspekte ihre wirtschaftliche Lage betreffen. KI-Systeme sind in beiden Dimensionen relevant. Sie verursachen Emissionen und Ressourcenverbrauch, beeinflussen aber gleichzeitig Effizienz, Resilienz und Innovationsfähigkeit.

Die IT übernimmt in diesem Kontext eine Schlüsselrolle. Sie ist nicht nur selbst Gegenstand der Berichterstattung, sondern liefert auch die Datenbasis. Energieverbrauch, Emissionen und Nutzungsmuster müssen erfasst, konsolidiert und überprüfbar gemacht werden. KI-Anwendungen werden damit Teil der Nachhaltigkeitsberichterstattung, auch wenn dies in vielen Unternehmen noch nicht explizit reflektiert wird.

Gleichzeitig eröffnet die Regulierung mit Hilfe einer strukturierten Digitalisierung Chancen, welche die Datenerhebung und Analyse erleichtern. Transparenz schafft Vergleichbarkeit und kann als Ausgangspunkt für gezielte Optimierung dienen. Unternehmen, die frühzeitig nachhaltige IT- und KI-Strategien entwickeln, verschaffen sich einen Vorteil. Sie sind besser vorbereitet auf Prüfungen, reduzieren Risiken und stärken ihre Glaubwürdigkeit.

Regulierung allein wird jedoch keine nachhaltige KI erzwingen. Sie setzt Mindeststandards, ersetzt aber nicht die unternehmerische Verantwortung. Entscheidend ist, wie Unternehmen die neuen Anforderungen interpretieren und in ihre Strategien integrieren.

10. Zielkonflikte und Kontroversen

Der Weg zu nachhaltiger KI ist von Zielkonflikten geprägt. Diese offen zu benennen ist wichtiger, als sie zu beschönigen. Nur so lassen sich tragfähige Entscheidungen treffen.

10.1 Leistung versus Nachhaltigkeit

Ein offensichtlicher Konflikt besteht zwischen der Modellleistung und dem Energieverbrauch. Größere Modelle liefern häufig bessere Ergebnisse, verbrauchen jedoch deutlich mehr Ressourcen. Auch der Zeitdruck spielt eine Rolle. Schnelle Markteinführung lässt wenig Raum für Optimierung. Nachhaltige Ansätze erfordern hingegen zusätzliche Analyse und Abwägung. Hinzu kommt oft die Kostenfrage, denn klimafreundliche Cloud-Regionen oder zeitliche Steuerung von Rechenlasten sind nicht immer die günstigste Option.

10.2 Technische Grenzen

Technisch stößt nachhaltige KI ebenfalls an Grenzen. Effizienzsteigerungen können Rebound-Effekte auslösen, wenn geringere Kosten zu mehr Nutzung führen. Skalierungsparadoxien zeigen, dass lokale Optimierungen bei stark wachsender Gesamtnutzung kaum ins Gewicht fallen. Zudem sind physische Grenzen der Hardwareentwicklung absehbar. Auch effizientere Algorithmen benötigen letztlich Energie.

10.3 Ethische und gesellschaftliche Fragen

Neben technischen Fragen stellen sich ethische und gesellschaftliche Herausforderungen. Transparenz ist nicht selbstverständlich. Fehlende Offenlegung zu Energieverbrauch und Trainingsprozessen begünstigt Greenwashing. Emissionen werden oft in Regionen mit geringerer Regulierung verlagert. Gleichzeitig haben nicht alle Akteure Zugang zu nachhaltiger Infrastruktur. Nachhaltige KI darf nicht zum Privileg weniger werden.

11. Fazit und Ausblick

Nachhaltigkeit wird sich dauerhaft als Bestandteil von IT- und KI-Strategien etablieren. Der Druck durch Regulierung, steigende Energiekosten und gesellschaftliche Erwartungen nimmt zu. Gleichzeitig wächst das Bewusstsein für die Verantwortung, die mit leistungsfähigen Technologien einhergeht. Die Zusammenarbeit zwischen IT, Nachhaltigkeitsverantwortlichen und Management wird dabei entscheidend sein. Denn wie so oft verhindern Silos ganzheitliche Lösungen. Transparente Kommunikation über Energieverbrauch, Emissionen und Ressourceneinsatz wird damit zu einem wichtigen Bestandteil verantwortungsvoller KI-Strategien und kann langfristig auch zu einem Wettbewerbsvorteil für Unternehmen werden.

Die zentrale Erkenntnis dieses Artikels ist klar: KI bietet enorme Chancen, birgt jedoch auch erhebliche ökologische Risiken. Effizienzgewinne dürfen daher nicht isoliert betrachtet werden, weil der Ressourcenverbrauch intelligenter Systeme real und in gewisser Art und Weise auch messbar ist.

Nachhaltige KI ist aus diesem Grund keine Option, sondern eine Notwendigkeit. Sie erfordert technisches Know-how, organisatorische Klarheit und auch einen kulturellen Wandel. Unternehmen, die diese Herausforderung annehmen, gestalten nicht nur verantwortungsvoller, sondern auch zukunftsfähiger. Jetzt ist der Zeitpunkt, KI und Nachhaltigkeit konsequent zusammenzudenken.

- Chui, M., Hazan, E., Roberts, R., Singla, A., Smaje, K., Sukharevsky, A., Yee, L., & Zemmel, R. (2023, 14. Juni). The economic potential of generative AI: The next productivity frontier. McKinsey & Company. https://www.mckinsey.com/capabilities/tech-and-ai/our-insights/the-economic-potential-of-generative-ai-the-next-productivity-frontier [Abgerufen: 31. März 2026]

- Epoch AI. (2026). Trends in Artificial Intelligence – Training Runs [Interaktive Datenbank]. Epoch AI. Lizenz: CC BY 4.0. https://epoch.ai/trends#training-runs [Abgerufen: 31. März 2026]

- International Energy Agency (IEA). (2025, 10. April). Energy and AI – Energy demand from AI. World Energy Outlook Special Report. IEA, Paris. Lizenz: CC BY 4.0. https://www.iea.org/reports/energy-and-ai/energy-demand-from-ai

- Ruf, B. (o. J.). AI Emissions Scenario Generator [Interaktives Modellierungswerkzeug]. GitHub Pages. https://borisruf.github.io/carbon-footprint-modeling-tool/ai-scenarios.html [Abgerufen: 31. März 2026]

- International Energy Agency (IEA). (2026). CO₂ intensity of electricity generation in selected regions, 2015–2026 [Datengrafik]. IEA, Paris. Lizenz: CC BY 4.0. https://www.iea.org/data-and-statistics/charts/co2-intensity-of-electricity-generation-in-selected-regions-2015-2026 [Abgerufen: 31. März 2026]